NVIDIA“一強”を突き崩すか AMDのAIソフトウェア「ROCm」と次世代GPU「Instinct MI400」がもたらす新たな選択肢(2/2 ページ)

AMDが、同社の主要拠点の1つであるシンガポールにおいて報道関係者向けイベントを開催した。この記事では、GPUアクセラレーター「Instinct」シリーズと、同シリーズを含むAMD製プロセッサを機軸とするAIエコシステム「ROCm」に関する説明会の模様をお伝えする。

ROCmのオープン化は、CUDAの牙城を崩せるのか?

説明会の質疑応答では、オープンプラットフォームとして展開されるROCmに関する質問が多く寄せられた。とりわけ、「(ROCmの)オープン化がなぜイノベーションの促進につながるのか?」という質問に対する、AMDのラミン・ロアーヌ氏(AIソフトウェア担当)の回答は興味深いものだった。

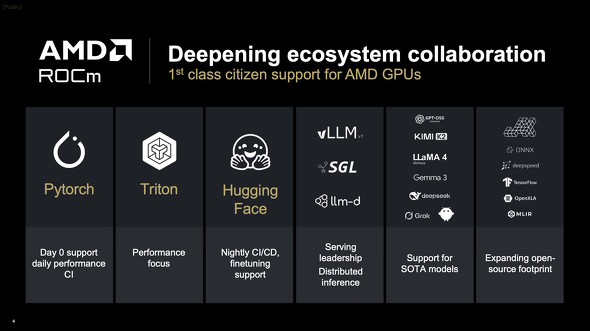

(ROCmが)オープンソースである最大の利点は、ハイパースケーラーのような大手顧客や、AI研究を行うラボが特定のニーズに合わせてコードを自在にカスタマイズできることにある。特に「Hugging Face」や「PyTorch」などの主要なコミュニティープロジェクトと密接に連携することで、コミュニティー側がAMDのハードウェア上で日々数千回にも及ぶテストを実施しており、スタックの安定化と最適化に寄与している。ユーザーは特定のベンダーにロックインされることなく、最新の研究成果を迅速に利用可能になる。

ROCmのオープン化は、例えば「Llama」や「Gemma」などの最新モデルがリリースと同時にAMDのハードウェア上で動作可能になったり、「Triton」や「Python」で記述された特定分野向けの「DSL(Domain Specific Language)」のサポートを可能にしたりと、最新AIへの迅速なキャッチアップにつながっている。

重要なのは、「オープンプラットフォーム」をキーワードに主要なプレイヤーを積極的に取り込むことで、コミュニティーの活動をAMDハードウェアにそのまま反映できることだ。長らくCUDAの“牙城”だったAIエコシステムにとらわれることなく、“既存のソフトウェア資産”をそのまま活用できる有力な“もう1つの選択肢”としてアピールできるようになったのだ。

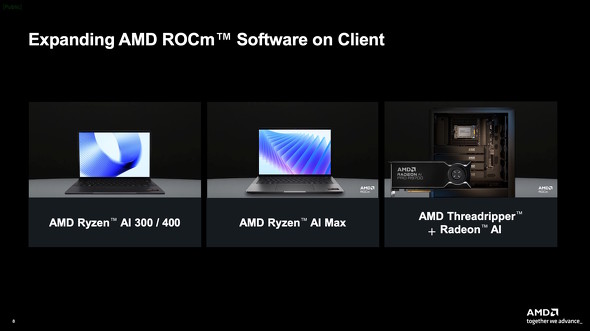

この他、最近ではノートPCやワークステーションといったクライアント環境でもROCmのサポートを強化している。以前と比較してもローカルでの作業環境が充実しており、開発者らは手元の環境でテストを繰り返しつつ、そのまま実稼働環境たるクラウドサーバへのスケールアップを実現できる点でメリットがある。

こうした動きを活性化するため、AMDでは「AMD AI Playbooks」を始めとするローカルAIの設定ガイドコンテンツを拡充している。対応のローカルOSはWindowsだけでなく、将来的なMac(macOS)のサポートも視野に入れている。

また、幅広くプラットフォームを横断して、ROCmのメリットを享受できる環境を整えつつある。

実際、ROCmの活動を介してAMD周辺のAIエコシステムを支えるベンダーもある。

2023年に稼働を開始したクラウドAIプロバイダー「TensorWave」は、AMD Instinct GPUを専門に扱う世界初の企業として知られる。

説明会にオンライン登壇したTensorWaveのピョートル・トマシク共同創業者兼COOは次のように説明している。

市場におけるNVIDIA製GPUの極端な不足と、提供における納期の長さ(リードタイム)は大きな課題だ。(TensorWaveは)AMDと密接に連携することで、大規模な計算資源を迅速かつ安定して提供することが可能になった。

NVIDIAプラットフォームと比較した場合の(AMDプラットフォーム)の優位点は潤沢なグラフィックスメモリ容量と、高速なメモリ帯域幅にある。特に、LLMの推論において非常に高いパフォーマンスが得られることは大きなメリットといえる。

以前は「AMD(プラットフォーム)でのAI開発は難しい」といった言説もあったが、ROCmの進化によりPyTorchやTensorFlowといった主要フレームワークは、コードの書き換えなくAMDプラットフォーム上でネイティブ動作可能になっており、NVIDIA CUDAへのロックインを嫌う顧客にとって魅力的な選択肢となっている。

AMD専業のTensorWaveのみならず、従来からNVIDIA製GPUを扱ってきたクラウドAIプロバイダーやソリューションプロバイダーの中にも、AMD製GPU向けのソリューションを提供するベンダーが出現し始めており、ニーズに応じてNVIDIA“以外”の選択肢としてAMDを積極的に採用可能な環境は整いつつある。

特に数カ月レベルで市場の情勢がガラリと変わるAIの世界において、投資が特定のベンダーにロックインされることなく、将来にわたって有効活用できることは重要だ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

オンプレミスAIを高速化する「AMD Instinct MI350P PCIe GPU」登場 グラボ形態で既存システムに容易に組み込める

オンプレミスAIを高速化する「AMD Instinct MI350P PCIe GPU」登場 グラボ形態で既存システムに容易に組み込める

AMDのエンタープライズ向けGPU「Instinct MI350」に、グラフィックスカード型の製品が登場した。Linuxで稼働するx86サーバに組み込んで利用できることが特徴で、システムの構成にもよるが最大8枚まで並列稼働が可能だ。 AMDの「Instinct MI350シリーズ」は競合NVIDIAよりもワッパに優れるAIドリブンなGPU 今後の展開にも注目

AMDの「Instinct MI350シリーズ」は競合NVIDIAよりもワッパに優れるAIドリブンなGPU 今後の展開にも注目

AMDが自社イベント「ADVANCING AI 2025」の基調講演において「Instinct MI350シリーズ」を発表した。この記事では、本GPUに使われている「CDNA 4アーキテクチャ」について解説しつつ、競合のNVIDIA製GPUとの差異、そして今後の展望についてまとめる。 AMDのGPUアクセラレーター「Instinct」のロードマップを公表 「Insinct MI350X」は2025年内に登場

AMDのGPUアクセラレーター「Instinct」のロードマップを公表 「Insinct MI350X」は2025年内に登場

AMDが、AI処理やハイパフォーマンスコンピューティング向けに発売しているGPU「AMD Instinct」のロードマップを発表した。2024年後半には現行アーキテクチャにおける改良版をリリースし、2025年には新アーキテクチャ、2026年にはさらなる新アーキテクチャの製品を投入する予定だという。 AMDのプロ向けGPU「Radeon PRO W7900」にコンパクトなデュアルスロットモデル登場 複数枚運用やコンテンツ制作に威力を発揮

AMDのプロ向けGPU「Radeon PRO W7900」にコンパクトなデュアルスロットモデル登場 複数枚運用やコンテンツ制作に威力を発揮

AMDのプロ向けGPUの最上位モデルに、スロット厚を抑えた新モデルが登場した。ボディースペースに余裕のないワークステーションにおける複数枚運用の他、プロフェッショナル/ハイアマチュアのコンテンツクリエイターの利用も想定しているという。 新GPU「NVIDIA Rubin」が量産体制に 2026年後半からプラットフォーム製品に実装

新GPU「NVIDIA Rubin」が量産体制に 2026年後半からプラットフォーム製品に実装

NVIDIAの新アーキテクチャGPU「Rubin」が量産に入った。2026年後半に、プラットフォーム製品へと搭載される見通しだ。