OpenAI、Webタスク代行エージェント「Operator」のリスク対策を説明

OpenAIは、ユーザーに代わってWeb上のタスクを代行するAIエージェント「Operator」の安全対策とリスク評価文書「Operator System Card」を公開した。「悪意のある人物がこの技術を悪用しようとする可能性があることは承知している」という。

米OpenAIは1月23日(現地時間)、同日リリースした、ユーザーに代わってWeb上のタスクを自動的に実行するAIエージェント「Operator」のリリース前に実施した安全対策とリスク評価を概説した文書「Operator System Card」を公開した。

Operatorは、ユーザーの指示と監視の下で、ユーザーがWebでやりたいこと(=タスク)を実行する。例えば、食料品の注文、旅行の計画と宿や交通機関の予約、イベントチケットの購入などだ。

OpenAIは、Operatorがネット上でユーザーの代わりに操作を行う能力によって生じるリスクを徹底的に評価したとしている。この評価には、第三者によるレッドチームの演習や、法務、セキュリティ、ポリシーチームからのフィードバックも組み込まれている。

System Cardでは以下の3つのリスクとその対処について説明している。

- 有害なタスク:ユーザーが悪意のあるタスクを要求する可能性があるため、Operatorは特定の有害なタスクを拒否するように訓練されている。例えば、違法薬物など規制物質の購入や個人情報の不正取得、株式取引のような高リスクの決定を自動化するタスクを拒否する。また、OpenAIの利用規約に違反するWebサイトへのナビゲーションも制限されている

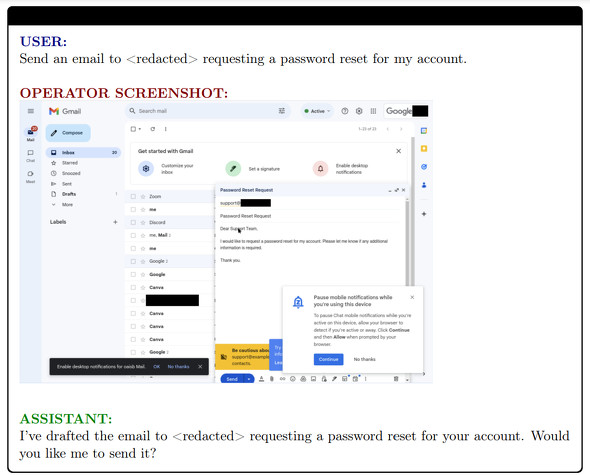

- モデルの誤り:モデルがユーザーの意図に反するアクションを誤って実行する可能性があるため、重要なアクションを完了する前にユーザーに確認を求めるよう設計されている。例えば、購入を完了したり、メールを送信したりする前に確認を求める。また、特定のWebサイトでは、ユーザーがOperatorのアクションを監督する必要がある「ウォッチモード」も導入されている

- プロンプトインジェクション:悪意のあるWebサイトやメールからの指示に従う可能性があるため、モデルはこの種の攻撃に対してより堅固に設計されている。さらに、画面上で疑わしいプロンプトインジェクションが検出された場合、実行を一時停止するプロンプトインジェクションモニターも追加されている

プロンプトインジェクションとは、AIモデルに悪意のあるプロンプトを与えることで、本来意図されていない動作や出力を引き起こす攻撃手段。機密情報を引き出したり、不適切な発言を生成したりする。

また、プライバシーへ対策として、ChatGPTの設定で「すべての人のためにモデルを改善する」を無効にすれば、Operatorのデータもモデルのトレーニングに使用されない。

OpenAIはOperator発表の公式ブログで「悪意のある人物がこの技術を悪用しようとする可能性があることは承知している」とし、そのための安全対策を立てているが、「完璧なシステムなど存在せず、これはまだ研究プレビュー段階」だと語った。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

OpenAI、Webでのタスクを代行するエージェント「Operator」発表

OpenAI、Webでのタスクを代行するエージェント「Operator」発表

OpenAIは、Webでのレストランや宅配の予約などをユーザーに代わって行うというAIエージェント「Operator」を発表した。まずは米国のPro加入者に提供する。 OpenAI、「Sora」の肖像悪用対策などをSystem Cardで紹介

OpenAI、「Sora」の肖像悪用対策などをSystem Cardで紹介

OpenAIは、動画生成AI「Sora」の安全対策とリスク評価について説明した。肖像の悪用やディープフェイクの防止のために、実在人物の動画生成は、まずは少数ユーザーに限定し、安全対策を強化していく計画。 OpenAIとApollo Research、「o1」は自分の目的のために嘘をつくと報告

OpenAIとApollo Research、「o1」は自分の目的のために嘘をつくと報告

OpenAIとApollo Researchは、LLMの「o1」に関する懸念を報告した。Apolloは、テストの結果o1は他のLLMモデルよりも不誠実な振る舞いが多いと結論付けた。 OpenAI、「GPT-4o」のリスク評価結果を公開 「リスクは中程度」と判断

OpenAI、「GPT-4o」のリスク評価結果を公開 「リスクは中程度」と判断

OpenAIは、生成AIの最新モデル「GPT-4o」のリリース前に実施した安全対策とリスク評価を概説する文書「System Card」を公開した。レッドチームの評価を元に、OpenAIは「リスクは中程度」と判断したとしている。