推論特化の最新モデル「o3」と「o4-mini」登場 ChatGPT有料版で利用可能 AIの“視覚”も大幅進化

米OpenAIは、新たなAIモデル「o3」と「o4-mini」を公開した。4月16日からChatGPTの有料会員向けに提供を開始した。

米OpenAIは4月16日(現地時間)、新たなAIモデル「o3」と「o4-mini」を公開した。推論性能に優れたAIモデル「o」シリーズの最新バージョンで、ChatGPTの有料会員向けに同日から提供を開始した。

o3は同社がこれまで一般公開している中で最高性能を持つ「o1」の次世代モデル。優れた推論能力を持ち、特にコーディングや数学、科学、視覚認識などの分野を得意としており、複数のベンチマークで最高記録(SOTA)を達成。外部専門家からは「難しいタスクにおいてo1よりも重大なエラーが20%少なく、特にプログラミングやビジネス、コンサルティング、創造的なアイデア創出などの分野で優れている」と評価を受けた。

o4-miniはo3よりも推論能力は劣るものの、応答速度やコスト効率に優れた小型のAIモデル。コーディングや数学、視覚タスクを得意分野としており、前モデルの「o3-mini」よりも利用上限が大幅に増加。大量の問い合わせやリアルタイム応答により適したAIモデルとなった。

他にもo3とo4-miniの両モデルで、コンテキストウィンドウ(AIモデルが応答を生成できるテキストの量)が20万まで増加している。

またo3とo4-miniでは、ChatGPT内の全ツールを組み合わせて、AIエージェントのように使うことが可能になった。主にWeb検索やアップロード済みファイルの利用、Pythonでのデータ分析、画像生成などが対応。これによりChatGPTは、ユーザーのリクエストに応えるために適切な出力形式を推論するようになったという。

ChatGPTの有料プランである「Plus」「Pro」「Team」ユーザーは、同日からこれらのAIモデルを利用可能。o1とo3-mini、o3-mini-highに代わって、o3とo4-mini、o4-mini-highがモデル選択の画面で選べるようになる。「Enterprise」と「Edu」ユーザーは24日からアクセス可能になり、無料ユーザーはo4-miniのみ試用できる。

また有料ユーザー向けに提供しているハイエンドモデル「o1-pro」についても、次世代モデル「o3-pro」を今後数週間以内に提供するという。

o3とo4-miniは“視覚”も進化 推論に画像を取り入れる

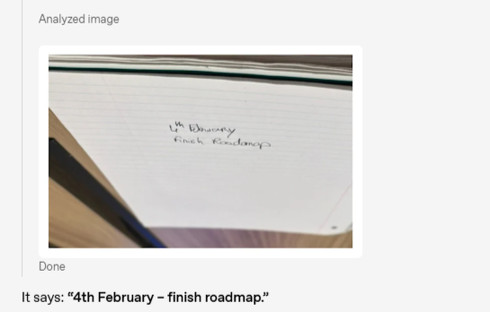

o3とo4-miniの大きな特徴には、視覚認識機能の進化がある。OpenAIによると「初めて、画像を見るだけでなく、思考の連鎖の中に画像を取り入れて考えることができるようになった」という。

o3とo4-miniは回答を出力するまでに長い思考時間を持つが、その思考の中に画像を取り入れるようになった。これはユーザーがアップロードした画像をツールを使って変換することで実現しており、画像のトリミングや拡大、回転などの画像処理の他、画像から画像の抽出もできる。

「高度な推論機能とWeb検索、画像操作などのツールをシームレスに組み合わせることで、不完全な写真からでも洞察を導き出せる。例えば、経済学の問題集の写真をアップロードすれば、段階的な説明を受けたり、開発エラーのスクリーンショットを共有すれば、迅速に根本原因分析を入手できる」(OpenAI)

また、画像で考えるようになったことで、ChatGPTのインタラクションも改善。テキストが逆さまの場合や、画像がぼけやている場合、画質が低い場合でも、AIは視覚的な推論によってその物体を認識し、質問に答えることなどが可能という。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

API専用の新AIモデル「GPT-4.1」登場 コーディングなどで“4o超えの性能” 初の「nano」モデルも

API専用の新AIモデル「GPT-4.1」登場 コーディングなどで“4o超えの性能” 初の「nano」モデルも

米OpenAIは、新たなAIモデル「GPT-4.1」「GPT-4.1 mini」「GPT-4.1 nano」を発表した。コーディングと命令の追従性に長けたシリーズで、GPT-4oとGPT-4o miniを全般的に上回る性能を持つという。 ChatGPTの「GPT-4」、4月30日に退場へ

ChatGPTの「GPT-4」、4月30日に退場へ

OpenAIは、2023年3月にリリースしたLLM「GPT-4」のChatGPTでの提供を4月末に廃止すると発表した。2024年5月リリースの「GPT-4o」が後継になる。 物議の「ジブリ化」は合法か 文科省「作風の類似のみなら著作権侵害に当たらない」 衆議院内閣委員会で質疑

物議の「ジブリ化」は合法か 文科省「作風の類似のみなら著作権侵害に当たらない」 衆議院内閣委員会で質疑

文部科学省の中原裕彦文部科学戦略官は4月16日の衆議院内閣委員会で、SNSで物議を醸している「ジブリフィケーション」(ジブリ化)に関する質問に対し、個別の事例については最終的には司法の判断になるとしつつ「(著作権法においては)単に作風・アイデアが類似しているのみであれば、著作権侵害に当たらない」との見解を述べた。 “AI界隈”が注目「MCP」って何?──KDDI子会社の解説資料が「分かりやすい」と話題

“AI界隈”が注目「MCP」って何?──KDDI子会社の解説資料が「分かりやすい」と話題

KDDIグループでアジャイル開発事業を行うKDDIアジャイル開発センター社員が公開した、AIモデルと外部データソースやサービスをつなぐ規格「Model Context Protocol」(MCP)の初心者向け解説資料が話題だ。 OpenAI「GPT-4.5」、チューリングテストに合格 7割超が“人間と誤認” 米カリフォルニア大

OpenAI「GPT-4.5」、チューリングテストに合格 7割超が“人間と誤認” 米カリフォルニア大

米カリフォルニア大学の研究チームは、米OpenAIのAIモデル「GPT-4.5」が、人間とAIを見分ける試験「チューリングテスト」に合格したとする査読前論文を発表した。試験では70%超がGPT-4.5を人間と誤認したという。