“複雑な思考ができるAI”、ELYZAが公開 性能は「o1-mini」に匹敵、商用利用も可能 「非リーズニングモデルから開発」

東大発のAIベンチャーELYZAは、新たなAIモデル「ELYZA-Thinking-1.0-Qwen-32B」を公開した。米OpenAIのAIモデル「o1」「o3」シリーズのような、推論性能に優れているのが特徴だ。

東大発のAIベンチャーELYZA(東京都文京区)は5月1日、新たなAIモデル「ELYZA-Thinking-1.0-Qwen-32B」を公開した。米OpenAIのAIモデル「o1」「o3」シリーズのような、推論性能に優れているのが特徴。Apache 2.0ライセンスで公開しており、研究や営利目的での利用が可能だ。

このAIモデルは、鎖のように少しずつ思考をつなげて推論する手法「CoT」(思考連鎖)を活用し、複雑な論理的思考を行う能力を強化した「リーズニングモデル」(Reasoning Model)だ。中国Alibabaが公開する非推論モデル「Qwen2.5-32B-Instruct」に対して、日本語追加事前学習と、SFT(教師ありファインチューニング)を実行し、日本語での論理的思考能力を高めた。

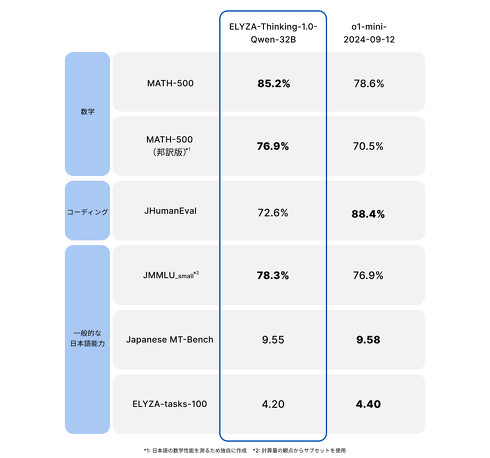

パラメータ数は320億で、OpenAIの「o1-mini」に匹敵する性能を達成。数学系のベンチマークでは、特に高い性能を示し、日英両方でo1-miniを上回るスコアを記録したという。

ELYZAは「この取り組みの特徴は、既に高度な論理的思考能力を備えたReasoning Modelに対して、日本語追加学習を行うのではなく“非Reasoning Model”に対して新たにその能力を付与した点にある」と説明。プロ棋士を破った囲碁AI「AlphaGo」でも使われる技術「モンテカルロ木探索」に着想を得たアルゴリズムを使い、模倣学習を行った。

また、この開発過程で得たAIモデル「ショートカットモデル」も併せて公開。こちらもApache 2.0ライセンスで、研究や営利目的で利用できる。ショートカットモデルでは、推論モデルが思考した回答を暗記しており、利用者からの質問に反射的に答えることが可能という。

ショートカットモデルは、パラメータ数が320億と70億の2種類を公開中。なお320億パラメータのモデルについては、OpenAIの「GPT-4o」に匹敵する性能を達成したと説明している。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

KDDI、野村総研と東大発AIベンチャーELYZA 法人向け生成AIで協業

KDDI、野村総研と東大発AIベンチャーELYZA 法人向け生成AIで協業

野村総合研究所とKDDI、KDDI子会社のAIベンチャーELYZAは、法人向けのセキュアなAIソリューション提供に向けて協業すると発表した。 KDDI、東大発AIベンチャー・ELYZAを連結子会社化 春以降、生成AI関連サービスを提供へ

KDDI、東大発AIベンチャー・ELYZAを連結子会社化 春以降、生成AI関連サービスを提供へ

KDDIは、東大発のAIスタートアップ企業であるELYZAを連結子会社にすると発表した。資本業務提携を結び、4月1日をめどにKDDIグループがELYZAの株式の過半数を保有する。これにより、同社らは「生成AIの社会実装を加速させる」としている。 江戸時代の言葉を話すAIチャット「からまる」 Sakana AIが公開 古文書の2500万文字を学習

江戸時代の言葉を話すAIチャット「からまる」 Sakana AIが公開 古文書の2500万文字を学習

AIベンチャーのSakana AIは、江戸時代の古文風テキストで会話できるAIチャットbot「からまる」を公開した。 リコー、“GPT-4o並み”の日本語性能持つLLMを開発 企業の「プライベートLLM」として導入へ

リコー、“GPT-4o並み”の日本語性能持つLLMを開発 企業の「プライベートLLM」として導入へ

リコーは、米OpenAIのAIモデル「GPT-4o」と同等の日本語性能を持つLLMを開発したと発表した。複数の学習済みのAIモデルを組み合わせ、より性能の高いモデルを作る手法「モデルマージ」で開発したという。 国内最大規模のコールセンター事業に生成AI 東大発AIベンチャー・ELYZAが協力 専用LLMを共同開発

国内最大規模のコールセンター事業に生成AI 東大発AIベンチャー・ELYZAが協力 専用LLMを共同開発

東大発のAIベンチャーELYZAとアルティウスリンクは、生成AI分野での協業を始めたと発表した。