LLMの“次に来るAI”? NVIDIAが推進する「フィジカルAI」とは何か、識者に聞いた(3/3 ページ)

米NVIDIAが推進する「フィジカルAI」。その仕組みや実現への課題、今、注目されている理由などを、AI開発企業Laboro.AI代表の椎橋徹夫氏に聞いた。

なぜ今、フィジカルAIなのか? NVIDIAの戦略

――そもそも、なぜ今フィジカルAIが注目されているのでしょうか

椎橋:自動運転技術の進化が一つの転換点になっています。これまで自動運転の開発がずっと進んできて、かなり実用化に近づいてきた。そして次は、ヒューマノイドロボットのような汎用的なロボットが大量に出てくる時代が来るといわれています。

しかし、こうしたモビリティやロボットを制御するためのAIは、先ほど話したようにLLMの延長では作れません。物理空間の中で瞬間的に意思決定をして、適切な行動を取る必要があるからです。

――NVIDIAはこの流れをどう見ているのでしょうか

椎橋:NVIDIAはもともと、自動運転用のAIを作るためのGPUやソフトウェアプラットフォームを提供してきました。Teslaも米Googleも、大量のGPUを使っています。自動運転の頭脳を作るために培った技術を、今度はロボットの脳みそを作るためのプラットフォームとして展開する――これがNVIDIAの戦略です。

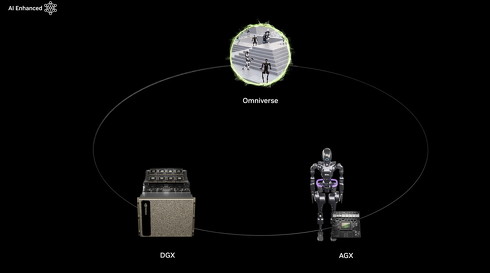

NVIDIAは、Omniverseの他にも、AIモデルのトレーニング用の「DGX」や、実行用の「Jetson」などのプラットフォームを提供しており、フィジカルAIの開発から実装まで全体をカバーするエコシステムを構築しています。

フィジカルAIは言語空間ではなく、物理空間のモデルを作るという壮大な挑戦です。自動運転やロボティクス、製造業のデジタルツイン――これら全てがGPUを大量に必要とするわけです。

日本企業の勝機は 「すり合わせ」のAI化?

――日本企業はLLMでもロボティクスでも出遅れています。勝機はあるのでしょうか

椎橋:今からLLMやロボットAIで勝負しても勝てません。しかし、フィジカルAIにはまだ誰も手をつけていない領域があります。今まで話してきた自動運転やロボットは、マクロな運動制御です。でも、もっとミクロなレベル――ナノレベルでの物理化学的な制御という領域があります。

例えば、日本が強みを持つ素材の代表例であるファインセラミックス製造。超高温の炉で焼くプロセスは、正確なシミュレーションもできないし、データも取れない。しかし、経験とノウハウで狙った性能のものが作れます。これが日本の「すり合わせ」(製品開発で、部門間で相互に情報を交換・調整しながら、製品の性能を高めていく手法)の強みです。

――なぜファインセラミックス製造がフィジカルAIと結び付くのでしょうか

椎橋:すり合わせ型の製造は、物理化学現象の複雑な相互作用を、経験的に最適化するプロセスです。温度や圧力、材料の配合、時間――これらの無数のパラメータの組み合わせで、製品の品質が決まる。これは、フィジカルAIが得意とする「複雑な物理現象の予測と制御」そのものです。

もしAIがこのプロセスを学習して、材料の配合や焼成条件を一発で出せたら革命になります。素材・材料だけでなく、そのファインセラミックスを使った精密部品である積層セラミックコンデンサーでも同じことが言えます。

何層もの薄いセラミックシートを積み重ねて圧縮する複雑なプロセスを、フィジカルAIの基盤モデルに落とし込む。24年にノーベル化学賞を受賞した「AlphaFold2」(遺伝子配列情報から、タンパク質の立体構造を解析できるAIモデル)の、製造業版の基盤モデルを作るんです。

――つまり日本勢にはまだチャンスがあると

椎橋:フィジカルAIの本質は、物理世界を理解し、予測し、制御することにあります。LLMが言語の世界を制覇したように、フィジカルAIは物理世界全体が対象です。日本には世界最高のロボット技術と精密な製造ノウハウがある。これとAI技術を組み合わせれば、新しい産業革命を起こせます。「デジタル敗戦」と言われた日本が、物理世界で逆転する最後のチャンスかもしれません。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

生成AIでGPUがいらなくなる? 業界を揺るがす「1ビットLLM」とは何か、識者に聞いた

生成AIでGPUがいらなくなる? 業界を揺るがす「1ビットLLM」とは何か、識者に聞いた

米Microsoftの研究チームが発表した「BitNet」、通称「1bit LLM」と呼ばれる論文が波紋を呼んでいる。これまで必須だと思われていたGPUが不要で、CPUでもLLMが動作することを示唆している。そもそも“1bit”とは何が1bitなのか、どうして1bitになるとGPUが不要になるのか、AIソリューションの開発・提供を行うLaboro.AIの椎橋徹夫CEOに聞いた。 「GPT-4o」は何がすごい? なぜLLMは画像や音声も扱えるの? “マルチモーダル”について識者に聞いた

「GPT-4o」は何がすごい? なぜLLMは画像や音声も扱えるの? “マルチモーダル”について識者に聞いた

米OpenAIが5月に発表した生成AIモデル「GPT-4o」。テキストだけでなく音声や画像も扱えるマルチモーダルモデルとして、その特徴が注目を集めている。GPT-4oは従来のLLMと何が違うのか、そもそもマルチモーダルとは何を意味するのか。AIの専門家に解説してもらった。 NVIDIA製GPUの数十倍速い? 次々に出てくる「AI専用チップ」とは何者か 識者に聞く高速化の仕組み

NVIDIA製GPUの数十倍速い? 次々に出てくる「AI専用チップ」とは何者か 識者に聞く高速化の仕組み

スタートアップ企業Etchedが発表した「Sohu」が、AI業界に新たな波紋を投げかけている。トランスフォーマーモデルに特化したこのAI専用チップは、NVIDIAのH100 GPUと比較して20倍高速かつ低コストで動作すると主張しているからだ。 DeepSeekで注目された「蒸留」って何だ? 識者が解説

DeepSeekで注目された「蒸留」って何だ? 識者が解説

中国のAI企業DeepSeekが、OpenAIの最新モデルに匹敵する性能を持つAIを、わずか10分の1以下のコストで開発したと発表し、AI業界に衝撃が走っている。NVIDIAの株価は一時17%下落。その背景には「蒸留」と呼ばれる技術の存在が取り沙汰されているが、その評価は専門家の間で分かれている。同社の快進撃の真相と、AI開発の新たなパラダイムとは何か。 ノーベル化学賞に「AlphaFold2」開発者ら選出 物理学賞に続き、AI関連技術が受賞

ノーベル化学賞に「AlphaFold2」開発者ら選出 物理学賞に続き、AI関連技術が受賞

スウェーデン王立科学アカデミーは、2024年のノーベル化学賞に、米ワシントン大学のデビッド・ベイカーさん、さらに米Google DeepMindのデミス・ハサビスさんとジョン・M・ジャンパーさんを合同で選出したと発表した。