ニュース

楽天、7000億パラメータの“日本語LLM”を開発 同社サービスに順次導入、26年春ごろオープンモデルに

楽天グループは、大規模言語モデル「Rakuten AI 3.0」を開発したと発表した。前モデル「Rakuten AI 2.0」の470億パラメータを大きく上回る7000億パラメータを持ち、日本語や日本文化の理解に優れるという。

楽天グループは12月18日、大規模言語モデル(LLM)「Rakuten AI 3.0」を開発したと発表した。前モデル「Rakuten AI 2.0」の470億パラメータを大きく上回る7000億パラメータを持ち、日本語や日本文化の理解に優れるという。経済産業省と新エネルギー・産業技術総合開発機構(NEDO)による国内企業向けのAI開発支援プロジェクト「GENIAC」の一環で開発した。

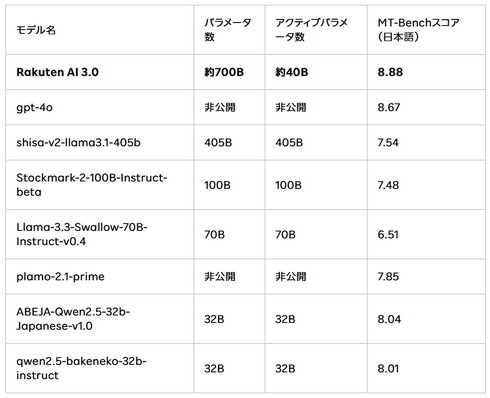

Rakuten AI 3.0は、複数のサブモデルを組み合わせ、タスクに応じた領域のみを稼働して計算効率を高める技術「Mixture of Experts」を採用し、処理の効率性を高めた。同社サービス「楽天エコシステム」内の試験では、他社の同規模モデルに比べ、最大90%処理コストを削減できたという。日本語性能を測るベンチマークでは、米OpenAIのAIモデル「GPT-4o」を超えるスコアだったとしている。

Rakuten AI 3.0は今後、楽天グループのAIサービス「Rakuten AI」を通じ、同社のサービスに順次導入予定。2026年春ごろには、オープンウェイトモデルとして公開する。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

楽天がAIエージェントで“勝てる”理由とは? 三木谷会長が語る「最強のAI」作るための戦略

楽天がAIエージェントで“勝てる”理由とは? 三木谷会長が語る「最強のAI」作るための戦略

楽天グループの三木谷浩史代表は、横浜市で開催中の同社のAIに関する取り組みを紹介するイベント「Rakuten AI Optimism」の基調講演に登壇し、同社のAI戦略を語った。 楽天、“エージェント型”チャットAI「Rakuten AI」提供開始 25年秋には「楽天市場」にも実装予定

楽天、“エージェント型”チャットAI「Rakuten AI」提供開始 25年秋には「楽天市場」にも実装予定

楽天は、“エージェント型”をうたうチャットAI「Rakuten AI」の提供を始めた。まずは、楽天モバイル契約者専用のメッセージアプリ「Rakuten Link」のiOS版と、専用Webサイトのβ版で利用できるようにする。 経産省、楽天の生成AI開発を支援 “長期記憶”で複雑な日本語文脈に対応するLLM構築へ

経産省、楽天の生成AI開発を支援 “長期記憶”で複雑な日本語文脈に対応するLLM構築へ

楽天グループは、経済産業省とNEDOによる国内の生成AI開発支援プロジェクト「GENIAC」の第3期公募に採択されたと発表した。8月から、日本語向けの大規模言語モデル(LLM)の開発を始める。 楽天、“AI三木谷会長”が決算会見に登場 AI生成の映像と音声を利用、淡々と業績を語る

楽天、“AI三木谷会長”が決算会見に登場 AI生成の映像と音声を利用、淡々と業績を語る

楽天が5月14日に実施した2025年度第1四半期(1月1日〜3月31日)決算の説明会に、同社の三木谷浩史会長をAIアバター化した「三木谷AI」が登場した。 楽天、AIモデル「Rakuten AI 2.0」シリーズを無料公開 大規模言語モデル&小規模言語モデルの2形態で

楽天、AIモデル「Rakuten AI 2.0」シリーズを無料公開 大規模言語モデル&小規模言語モデルの2形態で

楽天グループは、大規模言語モデル(LLM)「Rakuten AI 2.0」と小規模言語モデル(SLM)「Rakuten AI 2.0 mini」の提供を始めた。