Google、推論の深さを制御する「thinking levels」搭載の「Gemini 3.1 Flash-Lite」リリース

Googleは、Gemini 3シリーズ最速の「Gemini 3.1 Flash-Lite」をリリースした。「Gemini 2.5 Flash」と比較して出力が2.5倍高速化し、ベンチマークでもそれを上回る性能を達成。タスクに応じた推論の深さを制御できる「thinking levels」も搭載し、大量翻訳から高度なSaaSエージェントまで幅広い用途に対応するとしている。

米Googleは3月3日(現地時間)、「Gemini 3」シリーズ中で最も高速かつコストパフォーマンスに優れたAIモデルとして「Gemini 3.1 Flash-Lite」をリリースした。現在、プレビュー版として提供が開始されており、開発者は「Google AI Studio」の「Gemini API」を通じて、企業ユーザーは「Vertex AI」を通じてアクセス可能だ。

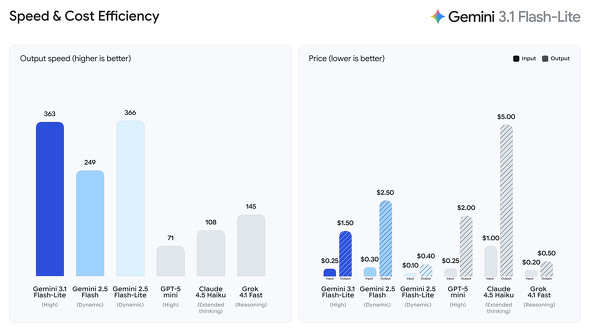

利用料金は入力100万トークン当たり0.25ドル、出力100万トークン当たり1.50ドルと、「Gemini 2.5 Flash-Lite」からは上がっているものの比較的安価に設定されており、大規模で高頻度な処理が求められる開発者のワークロード向けに構築されている。

性能面では、前世代からスピードアップし、品質の向上も図られている。昨年4月リリースの「Gemini 2.5 Flash」との比較では、最初の回答トークンが出力されるまでの時間が2.5倍高速化し、全体の出力速度も45%向上したという。同クラスの競合モデルと比較したベンチマークテストでも、推論とマルチモーダル理解能力で高い結果を示しており、「Arena.ai Leaderboard」で1432のEloスコアを獲得したほか、「GPQA Diamond」で86.9%、「MMMU Pro」で76.8%を記録し、旧世代のより大規模なモデルであるGemini 2.5 Flashを上回る性能を発揮している。

AI StudioおよびVertex AIでの利用時には、タスクに応じてモデルの推論の深さを制御できる「thinking levels」機能が標準で提供される。この低遅延と柔軟な制御能力により、大量の翻訳や画像等のコンテンツモデレーションのようなコスト重視のタスクから、動的なリアルタイムダッシュボードの生成、多様なステップをこなすSaaSエージェントの構築などの高度な推論が求められる複雑なタスクまで、スケールに合わせて幅広く対応できるとしている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Google、「Nano Banana 2」公開 「Gemini 3.1 Flash」ベース、無料版でも高機能利用可能に

Google、「Nano Banana 2」公開 「Gemini 3.1 Flash」ベース、無料版でも高機能利用可能に

Googleは最新の画像生成AI「Nano Banana 2」を発表した。「Gemini 3.1 Flash」の知能を活用し、Web検索と連動した正確な図解生成や高度なテキスト描画が可能。従来は有料版限定だった機能が無料ユーザーにも開放され、4K解像度や最大14のオブジェクト制御に対応する。 Google、「Gemini 3 Flash」を公開 高速性と推論能力を両立、アプリや検索、開発者向けに展開

Google、「Gemini 3 Flash」を公開 高速性と推論能力を両立、アプリや検索、開発者向けに展開

Googleは、高速性と低コストを両立させた最新AIモデル「Gemini 3 Flash」をリリースした。Geminiアプリの無料版デフォルトモデルとして展開されるほか、APIでも提供を開始。スピードと実用的な推論能力を両立した中核モデルとして位置づけられる。 「Gemini 2.5 Pro」が正式版に 開発者向けには「Gemini 2.5 Flash-Lite」(Preview)の提供も開始

「Gemini 2.5 Pro」が正式版に 開発者向けには「Gemini 2.5 Flash-Lite」(Preview)の提供も開始

Googleが「Gemini 2.5 Pro」を安定版として正式提供を開始した。開発者向けには価格改定された「2.5 Flash」に加え、より高速で安価な「2.5 Flash-Lite」をPreview版として新たに提供。Geminiアプリでも2.5 Proの安定版が利用可能になった。 最もコスト効率の高い思考モデル「Gemini 2.5 Flash」提供開始(無料版でも)

最もコスト効率の高い思考モデル「Gemini 2.5 Flash」提供開始(無料版でも)

Googleは、思考するAIの軽量版「Gemini 2.5 Flash」を無料ユーザーを含むすべてのGeminiユーザーへの提供を開始した。Google AI StudioとVertex AIのGemini APIでも利用可能だ。