AIの“舞台裏”に潜入 インフラの活用を学ぶハンズオンに参加してみた

オンプレミス環境でのAIインフラ構築にはITリソースと人材不足の壁が立ちはだかる。SB C&Sの「C&S AI INNOVATION FACTORY」は、「NVIDIA DGX H200」などを用いたハンズオントレーニングを展開。学習から推論、運用まで網羅するハンズオンの模様をレポートする。

機密データを扱う企業には安全かつ低遅延のAIインフラが求められる。選択肢になり得るのがオンプレミスでのAIインフラ構築だ。しかし難易度は高く、その実現には2つの壁がある。

1つ目はITリソースの問題だ。オンプレミスでのAIインフラの構築・運用には、膨大なデータを高速処理するGPUの演算能力が必要だ。特に大規模言語モデル(LLM)の運用は、最新のGPUリソースをいかに効率良く回すかがビジネスの競争力に直結する。しかし多額の初期投資が避けられず、おいそれと“お試し導入”するわけにはいかない。

ハードウェアの選定だけでなく、OS、ランタイム、機械学習フレームワーク、GPU連携ライブラリといった複雑なソフトウェアスタックの互換性を担保した管理も不可欠だ。

2つ目は、AI開発を担当する人材の問題だ。AI開発と一口に言っても、「AIモデルを作る(学習させる)」立場と、「AIモデルを使う(推論させる)」立場では、要求される知識やスキルが異なる。

SB C&Sの村上正弥氏(ICT事業本部 技術本部 技術統括部 第2技術部 1課)は、「AIモデルを使う側はUI設計やAPI連携、認証機能、ログ管理機能の組み込みといった従来のアプリ開発に近い作業が中心です。AIモデルを作る側はデータの準備から学習、AIモデルの最適化、デプロイまで、AI開発に特化した作業が求められます」と説明する。両者の役割分担を理解して、適切な開発サイクルを回すことがAI活用プロジェクトを成功させる鍵と言える。

こうしたハードルを解消するためにSB C&Sが2025年7月に立ち上げたのが、「C&S AI INNOVATION FACTORY」だ。GPUサーバ「NVIDIA DGX H200」を中心にネットワークスイッチや大容量ストレージなどをそろえ、AIインフラの構築から活用まで一貫して検証できる環境を整えている。

C&S AI INNOVATION FACTORYは、このアセットを使ってGPU環境を基本から学ぶ「Basic」、複数ノードのクラスタ構成を把握する「Advanced」、AIモデルの開発から活用までの手法についての理解をインフラの観点から深める「Master」のハンズオントレーニングを行っている。

ITmedia AI+編集部は、以前参加したBasicとAdvancedに続き、Masterを受講する機会を得た。本記事はその模様をレポートする。

AIインフラで展開される開発サイクル

ハンズオンは座学と演習で構成されている。座学はまず、「AIインフラで何が行われているか」というAI開発サイクル全体の説明から始まった。

AIインフラでは「学習」と「推論」の処理が行われる。学習はテキストや画像、音声など大量のデータからAIモデルを作成するプロセスで、GPUを使った高負荷な計算が前提になる。推論はサーバに配備した学習済みモデルをチャットbotや画像認識などのアプリから呼び出して、機能させる工程だ。

この基本を押さえた上で、説明は「AIの環境で必要なもの」に移った。

AIインフラは複雑だ。OSを筆頭にランタイム(Python)、機械学習フレームワーク(PyTorch)、GPU連携(CUDA)、開発IDE(JupyterLab)、AIモデルアーキテクチャ(Transformer)など数多くのモジュールが絡み合っており、バージョンや互換性を考慮する必要がある。

「これを解決する手段として、AIインフラを丸ごとまとめて準備して可搬性や再現性を確保できるコンテナ技術が欠かせません」

AIモデルの開発からデプロイ、実行基盤まで包括したスイート製品

座学は「AIモデルの種類と準備方法」に続いた。

AIモデルには画像認識や音声認識などの他、LLMなど多種多様なものが存在する。

「LLMは汎用(はんよう)性が高く、多様なユースケースに対応できます。ただし全ての処理をLLMに置き換えるのではなく、複数のAIモデルを組み合わせて利用するのが一般的です」

AIモデルの準備は「イチから学習する方法」「学習済みモデルをそのまま使う方法」「学習済みモデルに追加学習を行う方法」などがある。「追加学習の代わりにRAG(検索拡張生成)によって外部のデータソースを参照し、結果を回答に反映させる手法が多用されています」と村上氏は説明した。

AIモデルは、学習したままでは単なるファイルに過ぎない。AIモデルを業務で活用するためには、学習済みモデルを読み込んでさまざまなユースケースで実行する「推論エンジン」と、リクエストをやりとりする「API」といったコンポーネントが必須だ。これらを搭載して、推論する環境を構築した基盤が推論サーバだ。

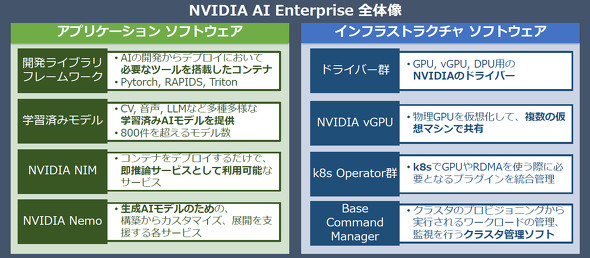

昨今のトレンドとして、AIモデルの開発からデプロイ、実行基盤で必要なソフトウェアまでまとめたスイート製品が登場している。その一つが「NVIDIA AI Enterprise」だ。

「NVIDIA AI Enterpriseのコンテナをはじめとしたソフトウェアは、NVIDIAのGPU基盤との互換性が担保されています。最適なライブラリやランタイムもあらかじめ含まれるため、高パフォーマンスな環境でAI開発を素早く始められます」

コンテナを起動すると推論サーバが完成する「NVIDIA NIM」、生成AI向けのフレームワークやマイクロサービスを提供する「NVIDIA NeMo」、AIに関連するソフトウェアを組み合わせて構成されたレファレンスアーキテクチャの「NVIDIA AI Blueprint」などもNVIDIA AI Enterpriseに用意されており、運用を見据えたAI開発を支援する。

コンテナの基本から始めてコマンド操作を体験

演習では、座学で学んだ内容を実際に操作することで理解を深めた。

PCのWebブラウザでハンズオン環境の「作業用デスクトップ」にログインして、C&S AI INNOVATION FACTORYのNVIDIA DGX H200にアクセスした。

まずはGPUサーバ上に用意されたコンテナの基本操作からスタートだ。

Docker HubからWebサーバ「nginx:1.29.0」のコンテナイメージを取得して、docker runコマンドで起動。起動中のコンテナ一覧を表示するdocker psコマンドやコンテナ内の標準出力などのログを確認するdocker logsコマンド、コンテナ内で任意のコマンドを実行するdocker execを確認した。

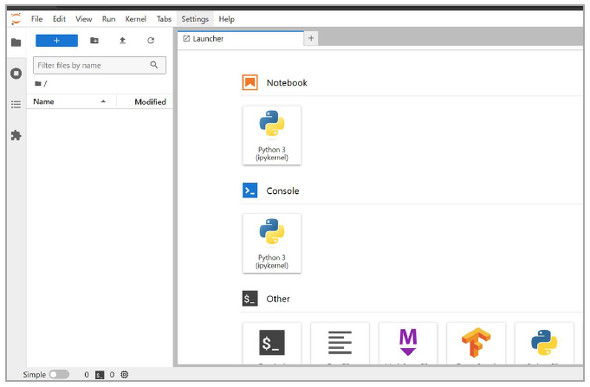

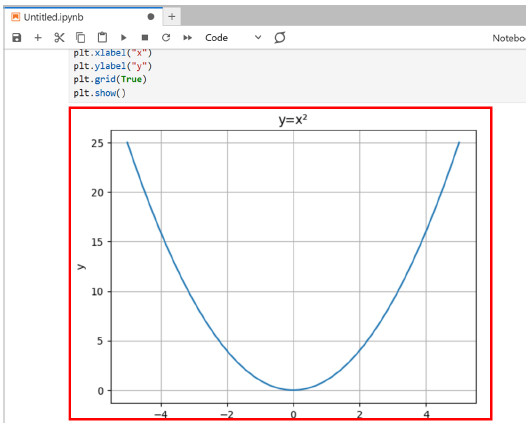

次に、AIやHPC向けのソフトウェアハブであるNGC(NVIDIA GPU Cloud)の「PyTorchコンテナ」を起動。以降の演習はJupyterLabでPyTorchコンテナを用いて進めた。JupyterLabは「Notebook」(ノートブック)という形式のファイルを使い、PythonのコードやMarkdown形式のテキスト、数式をセル単位で記述し、実行できる。

「プログラムの実行結果を確認しながら作業でき、データ分析や機械学習、実験記録のドキュメント化などに適しています。各セルの出力は自動的に記録され、グラフや画像などの結果もNotebookに表示されるので視覚的に分かりやすくコードを記録して共有できます」

Terminalからのコマンド実行、コンテナ上のアプリとの通信、コンテナへのファイル連携方法、コンテナ上でのGPU利用といった操作も確認し、効率的なAIインフラ構築をサポートするNVIDIA AI Enterpriseのメリットを感じることができた。

画像分類モデルを作成して推論

演習では画像分類モデルも作成した。NVIDIA AI Enterpriseのコンテナ上で画像分類のタスクを実行するAIモデルを作成し、推論サーバとして実行する手順を学んだ。

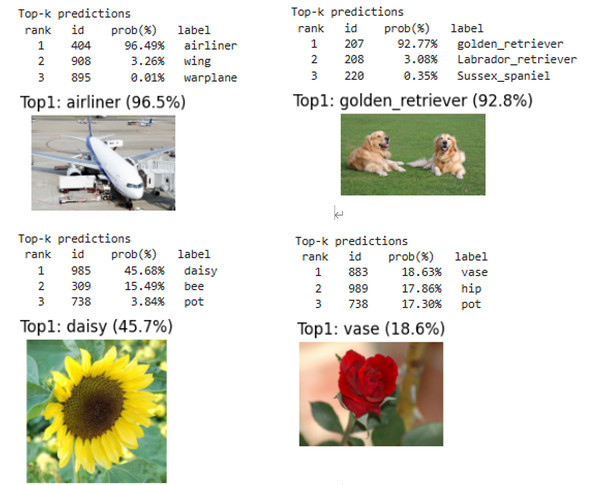

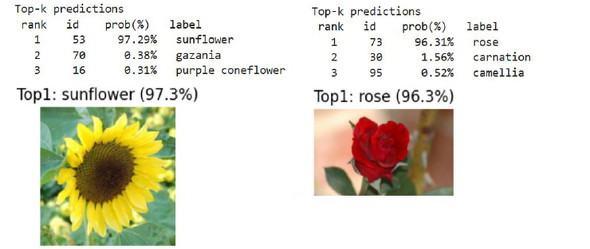

約1400万枚の画像(ImageNet)を学習済みのAIモデルを使って飛行機、ゴールデンレトリバー、ヒマワリ、バラの画像を使って推論したところ、飛行機は96.5%、ゴールデンレトリバーは92.8%の精度で認識した。

一方、ヒマワリとバラは間違った分類がされてしまった。花の画像の事前学習は不十分だったようだ。

そこでAIモデルに追加学習を実施した。オックスフォード大学の「Flower102」という102種類の花のデータセットを利用して学習させることで、正答率が上昇することを確認できた。追加学習を経たモデルで推論を実施したところ、ヒマワリとバラも正しく分類された。

学習後のモデルを保存して、NVIDIA AI Enterpriseに含まれる「Triton Inference Server」を推論サーバとして起動させた。座学で学んだ推論を実際の基盤で具現化させる。Triton Inference Serverは、学習済みのモデルと推論エンジンの指定などの設定ファイルを渡すと共通APIを提供する。演習ではPythonスクリプトからリクエストを送ると、正しい分類結果が即座に返された。

演習の最後には、NVIDIA NIMと「Dify」を組み合わせてチャットbotを作成した。本来ならパラメーター調整やサーバ構築などが必要なチャットbotの立ち上げが、ほぼGUIの操作で実現した。「AIインフラをいかに効率良く展開するか」という難題に対して、構築作業を少ないステップで完結させられるスピード感を肌で感じる演習だった。

半日のハンズオンだったが密度の濃い内容で、コンテナや各種ライブラリ、コンポーネントを的確に利用することでAIインフラを効率的に立ち上げられることを学べた。

他の参加者からは「GPUを操作できるハンズオンで貴重な体験だった」「文系・非エンジニアでも理解できるレベルまでかみ砕いた内容で、AIの学習から推論まで全体像を把握できた」「コマンドを一つずつ実行しながら進めるので、今何をしているのかが分かりやすい演習だった」「AI開発の上位レイヤーから体験でき、理解が深まった」といった感想が寄せられた。

AI時代において、インフラと開発の垣根を越えた知識の習得は欠かせない。ハンズオンに参加して、各社の強みを生かすAIインフラ構築に踏み出していただければ幸いだ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

AIインフラ構築のハンズオンに潜入取材 NVIDIAのGPUサーバに触ってみた

AIインフラ構築のハンズオンに潜入取材 NVIDIAのGPUサーバに触ってみた

「GPUを遊ばせない」が鉄則 AIインフラ構築のボトルネックをどう打破するか 記者がハンズオンを体験

「GPUを遊ばせない」が鉄則 AIインフラ構築のボトルネックをどう打破するか 記者がハンズオンを体験

GPUが宝の持ち腐れに? オンプレミスAIインフラ構築で陥るストレージの盲点

GPUが宝の持ち腐れに? オンプレミスAIインフラ構築で陥るストレージの盲点

ついに完成した「AI民主化の基地」 運営するソフトバンクのグループ企業が目指す世界

ついに完成した「AI民主化の基地」 運営するソフトバンクのグループ企業が目指す世界

電力、冷却問題もクリアする「C&S AI INNOVATION FACTORY」の全貌

電力、冷却問題もクリアする「C&S AI INNOVATION FACTORY」の全貌

関連リンク

提供:SB C&S株式会社

アイティメディア営業企画/制作:ITmedia AI+編集部/掲載内容有効期限:2026年3月25日