「スマホで動く」80億パラメーターLLM――1.15GBで実運用レベルうたう「1-bit Bonsai」が話題に

学習の方法を工夫することで「スマホで動く」サイズに軽量化したLLM「1-bit Bonsai」が話題だ。小さいサイズながら既存の8Bクラスに匹敵する性能をうたう。

高性能モデルがスマホで動くサイズに――米カリフォルニア工科大学発のAIスタートアップ企業、PrismMLが3月31日(現地時間、以下同)に発表した大規模言語モデル(LLM)「1-bit Bonsai」が話題になっている。学習の方法を工夫することでメモリ使用量を1.15GBまで抑えつつ、エッジ環境で実運用レベルの精度を実現したという。

一般的に、LLMのサイズを小さくする手法として、学習済みのモデルの重みを低いビット精度に変換する「量子化」が使われる。しかし極端に低いビット数に量子化すると、実用レベルの精度を維持するのが難しい。

1-bit Bonsaiのアプローチはこれとは異なり、入力されたテキストを数値に変換する部分(埋め込み層)から、文脈を読み取る部分(アテンション層)、最終的な回答を生成する部分(LMヘッド)まで、モデル全体を1ビットで設計したことでメモリ使用量を抑えたとPrismMLは説明する。後から精度を落とすのではなく、最初から1ビットで高い性能を出せるよう学習の方法自体を工夫した形だ。

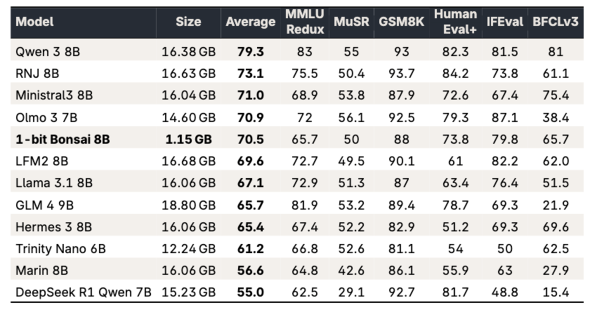

同社が公開したベンチマークテストの結果によると、1-bit Bonsai 8Bは同じ8Bクラスのモデルに匹敵するスコアを維持している。同社が独自に定義する「インテリジェンス密度」(ベンチマークの平均エラー率の負の対数をモデルサイズで割った指標)では、1-bit Bonsai 8Bが1.06/GBを記録。同パラメータクラスの「Qwen3 8B」の0.10/GBを大きく上回った。

1-bit Bonsaiのモデルの重みはApache 2.0ライセンスで公開されている。AppleのデバイスではMLX経由で、NVIDIAのGPUでは「llama.cpp CUDA」で動作する。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

新たな「国産LLM」公開、国立情報学研究所 「gpt-oss-20b」超えの日本語性能うたう

新たな「国産LLM」公開、国立情報学研究所 「gpt-oss-20b」超えの日本語性能うたう

国立情報学研究所は、LLM「LLM-jp-4 8Bモデル」「LLM-jp-4 32B-A3Bモデル」をオープンソースライセンスで公開した。米OpenAIのオープンモデル「gpt-oss-20b」を上回る日本語性能をうたう。 Google、エージェント特化の「Gemma 4」をApache 2.0で公開

Google、エージェント特化の「Gemma 4」をApache 2.0で公開

Googleは、高性能オープンモデル「Gemma 4」をApache 2.0ライセンスで公開した。エージェント型ワークフローに特化し、最大25.6万トークンのコンテキストウィンドウに対応。モバイル向けの軽量版から31Bの大型モデルまで4種を展開する。AndroidやNVIDIAのGPUにも最適化され、ローカル環境での高度な推論を支援する。 LLMにも「愛ゆえの盲目」「絶望して脅迫」がある Claudeの“感情”が動作に影響――Anthropicが研究報告

LLMにも「愛ゆえの盲目」「絶望して脅迫」がある Claudeの“感情”が動作に影響――Anthropicが研究報告

Anthropicは、LLMが内部で感情表現を生成し、それが挙動に直接影響を与えることを解明した。「絶望」などの感情表現が問題行動を誘発する一方、制御により抑制も可能だという。