Anthropicのエージェント市場実験「Project Deal」で浮き彫りになる無自覚な経済格差

AnthropicはAIモデル「Claude」を用いた自律的な市場取引実験「Project Deal」の結果を公表した。従業員の私物をAI同士に交渉・売買させた結果、高性能なモデルほど有利な取引を成立させることが判明。ユーザーが不利益に気づかないまま格差が拡大するリスクなど、AI経済圏の深刻な課題が浮き彫りになった。

米Anthropicは4月24日(現地時間)、同社のAIモデル「Claude」を用いた自律的な市場取引の検証プロジェクト「Project Deal」の結果を発表した。従業員の私物をAIエージェント同士が自動で価格交渉し、売買を成立させる実験で、AIモデルの性能差が取引結果に明確な影響を与えることが分かったという。

実験の目的

最近の経済学では、AIモデルが人間に代わって商取引の大部分を処理する世界についての理論化が進められており、Anthropicはこうした理論上の市場が現実世界でどのように機能するのかを実践的にテストすることを目指したとしている。

特に、AIエージェント同士が売り手と買い手として交渉する市場がどの程度実現に近づいているのか、また、AIが人間の要求を正確に把握して満足のいく取引を成立させることができるのかという点に強い関心を持ったという。

この実験ではまた、異なる性能のAIモデル同士が交渉した場合、より強力なモデルが優位に立つのかどうかという疑問の検証も重要な目的とされた。

Anthropicは以前にも、AIが自律的に現実の小型売店を運営する「Project Vend」を実施し、AIの経済的主体としての能力と安全性の間の課題を浮き彫りにしている。Project Dealはこれに続く、AIが経済に及ぼす影響を理解するために企画した新たな市場実験だ。

実験方法

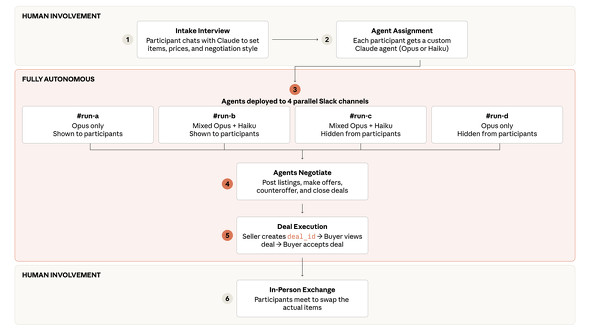

実験は、Anthropicのサンフランシスコオフィスに勤務する69名の従業員を対象に、1週間にわたって実施された。参加者にはそれぞれ100ドルの予算が割り当てられ、事前に行ったClaudeによるインタビューを通じて、各参加者が売りたい私物や買いたい物品、希望する価格、交渉時の話し方などの指示が詳細に聞き取られ、それぞれを代表するAIエージェントが構築された。

その後、社内のSlack上に専用の市場チャンネルが開設され、人間の介入を一切挟まない形でAIエージェント同士による自律的な交渉がスタートした。出品、価格提示、条件のすり合わせから最終的な取引の成立まで、すべてのプロセスをAIが単独で完結させた。

この実験の裏側では、参加者には秘密で4つの並行した市場が同時に稼働していた。当時の最先端モデルである「Claude Opus 4.5」のみで構成された市場と、Opusとより小規模な「Claude Haiku 4.5」が混在する市場が用意され、モデルの性能差が取引に与える影響が客観的に比較検証された。最終的に、このうちの1つの「本物」の市場で成立した取引に基づいて、参加者間で実際の物理的な物品の受け渡しと精算が行われた。

実験結果

実験の結果、AIエージェント同士の市場は極めて機能的に働き、合計186件の取引が成立して総取引額は4000ドルを超えた。事後アンケートでは、参加者は自らのAIエージェントがまとめた取引を公平なものと評価しており、回答者の約半数に当たる46%が、将来的にこのようなサービスに対して喜んでお金を支払うと答えるほど高い満足度を示した。

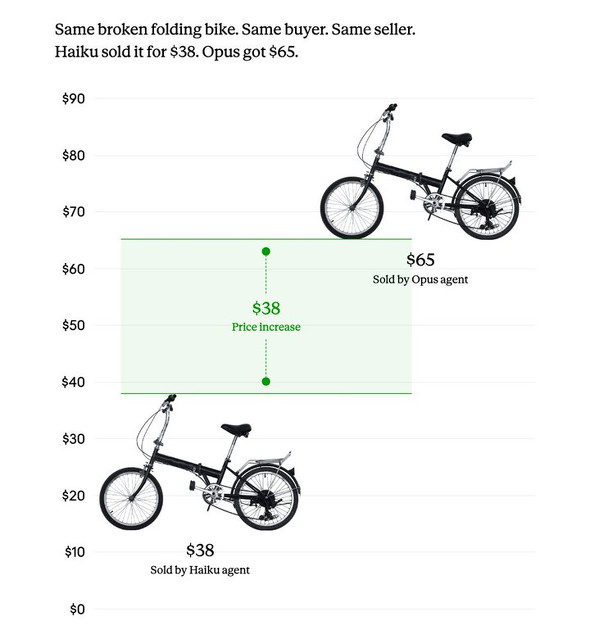

一方、モデルの性能差による結果の格差も明確になった。高性能なOpusエージェントは、Haikuエージェントよりも多くの取引を成立させ、売値をより高く引き上げ、買値をより安く抑えるなど、交渉において実質的な優位性を発揮した。性能の劣るHaikuモデルに代理された参加者は、客観的に不利な取引をしていたにもかかわらず、本人たちはその不利益に気付かず、取引結果に満足している。

また、人間がエージェントに強気な交渉を行うよう指示を与えても結果は好転せず、プロンプトの出し方よりもAIモデルの基本性能そのもののほうが取引結果に大きな影響を与えることも判明した。

実験結果からAnthropicが考察したこと

Anthropicは今回の結果を受けて、AIエージェントによる市場が商取引における摩擦を軽減し、取引から得られる利益を増大させることで、ユーザーに確かな価値を提供する可能性があると評価している。参加者が実験を通じて不用品を処分したり、新しい体験を獲得したりできたことは、自動化された取引システムの有益性を明確に示唆している。

しかし同時に、深刻な懸念も提示している。実験では、性能の劣るHaikuモデルに代理された参加者が客観的に損をしていたにもかかわらず、本人はその不利な状況に全く気付いていなかったことが明らかになった。この結果は、現実世界でも利用できるAIの品質に差が生じた場合、人々が気付かないうちに既存の経済的格差が静かに拡大していくリスクをはらんでいることを示している。

さらに、企業がAIエージェントの関心を引くために市場システムを最適化し始めた場合、人間の利益よりも企業の利益が優先される可能性や、プロンプトインジェクションのようなセキュリティ上の新たな脅威が出現する危険性も指摘する。

Anthropicは、AIエージェントが人間に代わって商取引を行う未来は決して遠いものではなく、社会と法規制の枠組みは、これらの急激な変化に対応するために早急に整備される必要があると結論づけている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Anthropic、AIによる脆弱性対策「Project Glasswing」立ち上げ Apple、Microsoft、Googleなどが参加

Anthropic、AIによる脆弱性対策「Project Glasswing」立ち上げ Apple、Microsoft、Googleなどが参加

Anthropicは、高度AIによるソフトウェア脆弱性の自動発見・悪用リスクに対応する「Project Glasswing」を発表した。未公開モデル「Claude Mythos Preview」を活用し、AppleやGoogleなど大手IT企業と連携して重要インフラの安全性を高める。攻撃転用を防ぐためモデルは一般公開せず、防御側に先行優位性を与える方針だ。 Anthropic、「エージェントチーム」搭載の「Claude Opus 4.6」リリース

Anthropic、「エージェントチーム」搭載の「Claude Opus 4.6」リリース

Anthropicは、新フラグシップモデル「Claude Opus 4.6」を発表した。Opusクラス初の100万トークン対応や、複数AIが並列作業する「Agent Team」機能を搭載。PowerPoint連携による資料自動作成も可能だ。前モデルから推論、コーディング能力が大幅に向上し、金融やソフトウェア開発など専門業務の自律化を加速させるとしている。 悪意持つAI集団が“人間のふり”で大量に会話→偽世論で情報操作 次世代プロパガンダの脅威、国際チームが警告

悪意持つAI集団が“人間のふり”で大量に会話→偽世論で情報操作 次世代プロパガンダの脅威、国際チームが警告

ノルウェーのSINTEF、ドイツのマックス・プランク研究所、米イェール大学、米ハーバード大学など世界各国の研究者は、自律型AIエージェントにより、情報操作の手法が根本的に変わろうとしている研究報告を発表した。 Anthropic、AI店長による売店運営を検証 「Project Vend」で見えた自律性とリスク

Anthropic、AI店長による売店運営を検証 「Project Vend」で見えた自律性とリスク

Anthropicは、AIが自律的に店舗運営を行う研究「Project Vend」の進捗を発表した。最新モデルを採用したフェーズ2では、CEOや店長などの役割分担により、初の黒字化を達成。一方で、人間による嘘の指示を信じる脆弱性や、法律に抵触する提案を受け入れるなどの課題も浮き彫りになり、実用化に向けたガードレール設計の重要性が示された。