ChatGPTに重要な情報を送っても安全か? 自治体のネットワーク分離モデルから考える(2/2 ページ)

自治体における生成AIの利活用、今回は「送信された情報の管理の問題」、つまり「ChatGPTに重要な情報を送信しても安全なのか?」という点について考えたい。

ChatGPTを職員の端末からシームレスに使いたい

ChatGPTの利活用を検討していくと、いくつかの課題が見えてきます。

- 自治体によっては、インターネットに接続できる端末が限られているため、ChatGPTなどの外部サービスを気軽に使えない

- 業務効率を高めるために、日常的な作業の中でシームレスにChatGPTを利用したい。例えば、作成中の文書をそのままChatGPTに入力し、回答をもらいたい

- 実務に即した利活用のために、機密性レベル2の情報も扱えるようにしたい

これらを解決するために、レベル2ネットワークにある職員の端末からシームレスにChatGPTを使う方法を考えてみましょう。

総務省では「地方公共団体における情報セキュリティポリシーに関するガイドライン」の改定作業が進められており、新たなネットワーク分離モデルとして「α’(アルファ・ダッシュ)型モデル」というものが検討されています。

これは、レベル2ネットワークから直接インターネット上の外部サービスを利用するために、いくつかの条件を満たした上で、その接続を認めていこうというものです。現時点で、満たすべき条件はいくつか挙げられていて、

(1)外部サービスとの間で安全な通信経路を保つこと。外部からの侵入を防ぐこと

(2)接続する外部サービスを限定すること

(3)外部からファイルをダウンロードする際には、無害化処理を行うこと

(4)接続する外部サービスは、ISMAP等の外部認証を受けたサービスとすること

となっています。

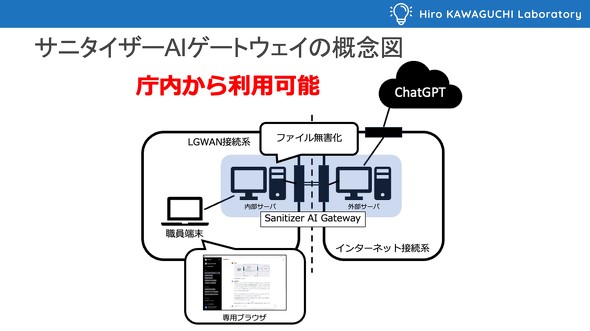

当社では、この条件の(1)から(3)までを満たす「サニタイザーAIゲートウェイ」という製品を開発しており、すでにいくつかの自治体に導入を進めています。外部サービスとの通信を中継するゲートウェイサーバと、専用ブラウザ、ファイル無害化エンジンで構成されています。これにより、職員が普段使用する端末でChatGPT専用のブラウザを起動しておき、ChatGPTをシームレスに使えるようになりました。

また、OpenAI社のWebサイトでは、ChatGPTなど自社のサービスについて、外部監査や認証を受けている旨を公開しています。ISMAPなど国内の認証ではありませんが、EUのGDPR、米カリフォルニア州のCCPAの認証を受けていることで、ひとまず信頼できる外部サービスと考えてよいのではないかと思います。

これらの対策を講じることで、α’モデルによる接続を通じてChatGPTをレベル2ネットワークと同等の安全性を持つものとして扱うことが可能となります。その結果、機密性レベル2までの情報をChatGPTで取り扱えるようになります。

さらにOpenAI社からの約款やプライバシーポリシーを見てみましょう。約款はいくつかありますが、業務で使用する場合に重要なのは次の2つです。

これらを簡単に表現すると「ChatGPTは自らのサービス改善のためにデータを利用することがある(利用者側でそれを拒否することはできる)。しかし、個人を特定する情報は利用者の同意なしには共有されない」と解釈することができます。

したがって、自治体でChatGPTを利用するのならば、

- α’モデルでの接続、利用により、ChatGPTをレベル2ネットワーク相当とする

- ChatGPT利用における、情報セキュリティポリシーに基づく実施手順を作成し、順守させる

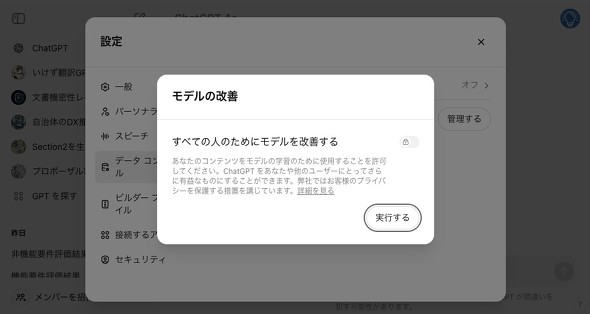

- ChatGPT内で「サービス改善のためのデータ利用を拒否する」設定を行い、入力した情報をChatGPTに取り込ませない

という組み合わせがよいのではないかと思います。

次回は、3番目の論点である「生成された文章に対する評価者側の問題:AIが生成した文章だからダメという理屈は通用するのか」について考えてみましょう。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

プロンプトの悩み不要 自治体で使うべき「ChatGPT Plus」の機能とは?

プロンプトの悩み不要 自治体で使うべき「ChatGPT Plus」の機能とは?

生成AIを業務に導入する自治体が増える一方で、依然として活用に二の足を踏む自治体も。何がハードルになっているのか。 5分の作業が船移動で半日仕事に……沖縄・竹富町が挑むDX 離島の不利性どう解消?

5分の作業が船移動で半日仕事に……沖縄・竹富町が挑むDX 離島の不利性どう解消?

沖縄県竹富町は、島しょ自治体が抱える不便をテクノロジーで解消しようと、DXに注力している。これまでは、5分で終わる町職員の業務が、離島へのフェリー移動を伴う出張となれば半日かかることもあった。 東京都、生成AIをどう利用? 最大の効果は「時短」ではなく……

東京都、生成AIをどう利用? 最大の効果は「時短」ではなく……

8月から文章生成AIの全局導入を始めた東京都は、生成AIのメリットについて「単純な業務時間の短縮効果にとどまらない」とする。導入から約3カ月。東京都が生成AI活用を通じて得た「時短効果」以上の手応えとは――。 生成AI、那覇市はどう活用? 職員も思いつかなかった、AIが提案したアイデアとは

生成AI、那覇市はどう活用? 職員も思いつかなかった、AIが提案したアイデアとは

2023年12月から生成AIを導入した沖縄・那覇市。利用シーンを6つのケースに絞り、文章のたたき台作成などに用いている。行政が生成AIなどの先端技術を使う意義とは――。 ChatGPTを「産業振興につなげたい」 人口ワースト2位・島根県の挑戦

ChatGPTを「産業振興につなげたい」 人口ワースト2位・島根県の挑戦

都道府県別の人口ランキングでワースト2位の島根県。国内有数の「高齢化先進県」でもあることから、産業振興は喫緊の課題だ。IT企業との連携や誘致の取り組みを展開するが、ChatGPTについてはどう活用していくのか。