「Pixel 4」のカメラ技術から見える、スマホカメラの進化(2/2 ページ)

Googleがメディア向けに「Pixel 4」のカメラ技術に関する説明会を開いた。この1年のスマートフォンカメラの進化はどこにあったのかを伝える内容だった。テーマはGoogleのスマートフォンにおけるコンピュテーショナルフォトグラフィーと機械学習。

4.夜景モード:明るくなりすぎない工夫も

今や搭載するのが当たり前になった夜景専用のモード。これもHDRと同じく、連写+合成で暗い場所でもディテールをしっかり表現でき、ノイズが少なくダイナミックレンジが広い画像を作っている。

Pixel 4の場合1回のシャッターで最高15コマを連写して作っているのだけど、そのとき単に合成するだけだと夜とは思えない明るい写真になってしまうので、シャドー部を完全に黒くするなど、夜に見えるようなトーンマッピングをして夜景らしさを保っている。

動く被写体がいたらそれを検知してブレないようにしている。

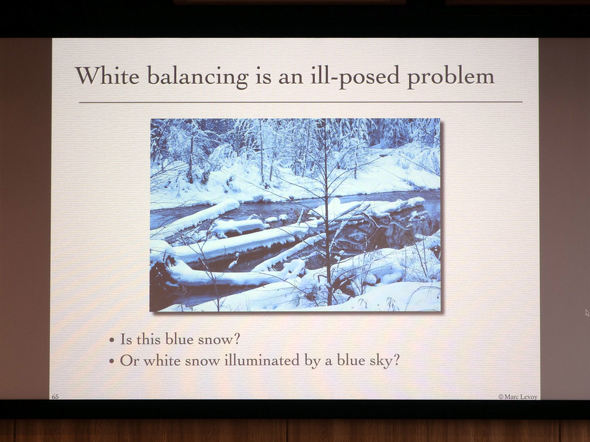

もう1つ、雪景色が青くならないよう、赤っぽい照明の下ので肌色が正確に出るよう、最適なホワイトバランスを作るために機械学習を利用しているという話も紹介された。これも重要なことだ。

Pixel 4のカメラ技術まとめ

今回の話をまとめると、Pixel 4のカメラには、以下の技術が使われている。

- 1回のシャッターで超高速連写をし、それを重ね合わせることで、よりダイナミックレンジの広い絵を作り出したり、よりノイズが少ない絵を作り出したり、それぞれのわずかなズレを利用して超解像な望遠画像を作り出したりしている

- 機械学習を利用して適正な色になるようホワイトバランスを決めたり、人の輪郭を判断したりしている

- デュアルピクセルやデュアルカメラによる深度データを利用していること

説明の内容はかなり専門的だったので、可能な限りかみ砕いてみた。

イメージセンサー技術の向上に加え、これらを組み合わせることでPixelのカメラの画質は上がっている。デジタル一眼に比べると光学的に不利な点を補った上に、見る人によって好ましい写真を作っている。だからGoogleではソフトウェアアップデートによってさらにレベルを上げていくのでお楽しみに、的な話もちょっと出た。

スマートフォンカメラの画質差は、センサー技術(さらには画素数や搭載するカメラの数)以上に、コンピュテーショナルフォトグラフィーや機械学習部分でついているのだ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

望遠レンズ搭載で「Pixel 4」のカメラは何が変わったのか? Pixel 3と比較する

望遠レンズ搭載で「Pixel 4」のカメラは何が変わったのか? Pixel 3と比較する

シングルカメラながら、なぜか背景がちゃんとボケる賢さときれいな夜景モードと安定した画質が定評のある「Pixel 3」。その後継機となる「Pixel 4」は、デュアルカメラを搭載してきた。新たに搭載した望遠レンズを含めた実力はいかほどか? 本当に“同じ”? 「Pixel 3」と「Pixel 3a」のアウトカメラを撮り比べる

本当に“同じ”? 「Pixel 3」と「Pixel 3a」のアウトカメラを撮り比べる

Googleのスマートフォン「Pixel 3」と、その廉価版に相当する「Pixel 3a」。両者のアウトカメラは基本スペックが同じということになっているが、本当に同じなのか? 撮り比べてみるのである。 AIの力でデュアルカメラ超え? 「Pixel 3 XL」の“賢い”カメラの実力を見る

AIの力でデュアルカメラ超え? 「Pixel 3 XL」の“賢い”カメラの実力を見る

Google純正のスマートフォン「Pixel 3」「Pixel 3 XL」が日本に上陸。トレンドに逆らうようにアウトカメラはあえてシングルで、インカメラがデュアルという面白い構成。どんなものなのか、撮り試してみましょう。 ハード、ソフト、AIの三位一体で攻める「Pixel 4」 “我が道を行く”ゆえの課題も

ハード、ソフト、AIの三位一体で攻める「Pixel 4」 “我が道を行く”ゆえの課題も

10月24日にGoogleの最新スマートフォン「Pixel 4」「Pixel 4 XL」が発売される。ハードウェアとしては、デュアルカメラ化したことや、電波を使ってジェスチャーを検知する「モーションセンス」に対応した。比較されがちなiPhoneとは開発思想が異なるが、他社比較から見える課題もある。 「Pixel 4」は何が新しい? 3/3aと比較、ネックは価格か

「Pixel 4」は何が新しい? 3/3aと比較、ネックは価格か

Googleの最新スマートフォン「Pixel 4」「Pixel 4 XL」が10月24日に発売される。カメラが進化し、2020年春からは新機能の「モーションセンス」が利用可能になる予定。Pixel 3や3aとの違いをまとめつつ、Pixel 4は買いなのかどうかを考えたい。