Microsoft Research、「NUI」の最新成果を報告:Kinectで進化する直感操作(1/2 ページ)

“タッチ”を大幅に取り入れたWindows 8で直感的なPC操作を可能にしたMicrosoft。しかし、彼らが目指す本当のゴールは「Natural User Interface」(NUI)だ。

Windows 8のタッチ操作は、ほんの入り口に過ぎない

Xbox 360用の周辺機器として登場したモーションセンサーの「Kinect for Xbox 360」は、一部の技術者が自力で解析して、その機能を自由に使えるソフトウェアを“私的”に開発していたが、Microsoftが「Kinect for Windows」とSDKをセットにした開発者キットをリリースしたことによって、Kinectは、インテルをはじめとする各種研究機関でユーザーインタフェース開発や実験に広く用いられるようになった。

日本マイクロソフトは、1月28日に、これらの実験の成果として登場したNUI(Natural User Interface)の最新成果を、日本の関係者に向けて公開した。

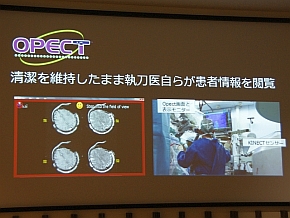

手術現場で活躍する「Opect」

日本マイクロソフトがニチイ学館、東京女子医科大学 先端生命医科学研究所(FATS)と共同で開発した「Opect」は、Kinectを使ってデバイスに直接触れることなしにカルテやCT写真を参照できる。手術現場では執刀医の手に血液がついてしまうため、タッチスクリーン型のデバイスが使えない。そのため、非接触で操作できるUIが必要となる。2次元写真を操作するシステムはすでにFATS内で運用を開始しており、現在は3次元オブジェクトを操作するシステムを開発中だという。

なお、日本マイクロソフトはKinect本体と開発キットを提供するだけで、Opectのソフトウェアやシステムの販売権と著作権はニチイ学館とFATSにある。

マイクロソフト ディベロップメント 代表取締役社長の加治佐俊一氏(写真=左)。日本マイクロソフトがニチイ学館、東京女子医科大学 先端生命医科学研究所(FATS)と共同で開発した「Opect」(写真=右)

マイクロソフト ディベロップメント 代表取締役社長の加治佐俊一氏(写真=左)。日本マイクロソフトがニチイ学館、東京女子医科大学 先端生命医科学研究所(FATS)と共同で開発した「Opect」(写真=右)身体障害者支援システム「OAK」

体が不自由な人の場合、マウスやタッチスクリーンを操作できないことも多い。「OAK」は、まばたきや口の開閉といった顔の動きをスイッチにして、画面のページめくりといった操作を行うシステムだ。障害の状況によっては、顔を固定することも難しい場合があるため、Kinectの「フェイストラッキング」機能を利用して、顔と目や口の位置をつねに把握し、その状態をチェックし続けることで、顔の位置を静止できない障害者でも利用できるようにしている。

空中に文字を書く「AIR SHODOU」

モーションセンシングを利用した基本的なアプリケーションといえるのが「AIR SHODOU」だ。文字通り「エア書道」のアプリケーションで、手の動きをKinectで認識して、その動きに合わせて画面上に文字を描く。

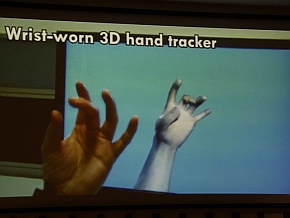

既製品のセンサーを組み合わせた「Digits」

今回のデモでは、NUI研究の一環として「Digits」と呼ぶリストバンド型のセンサーも紹介した。Digitsは、赤外線センサーなど、すでの市販しているセンサー製品を組み合わせて作ったもので、腕の位置や指の動きなどを正確にトレースできる。Digitsを使えば、物体やデバイスに触れずにAR的にオブジェクトを操作したり、ハンズフリーでスマートフォンを操作したりと、より近未来的なアクションが可能になる。

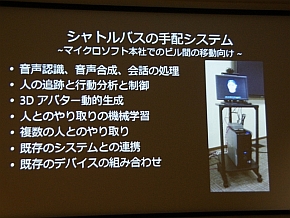

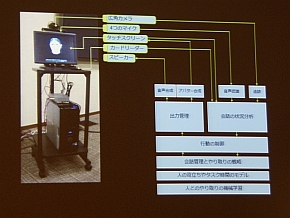

NUIを利用した自動受付システム

米ワシントン州シアトル郊外のレドモンドにある米Microsoft本社は、100近い独立した建物で構成する巨大なキャンパスで、社内の移動でもシャトルバスを手配するほどに広大だ。このような会社の受付を、従来のような人間によるのではなく、PCを使って機械的に処理してしまおうという試みも紹介している。ハードウェア的には処理能力の高いPC程度でしかないが、目の前の人物を認識し、その表情や言葉を自然言語解析で学習しながら受け答えする。デモでは、2人組の会話から同じグループに所属する人物であると認識しつつ、彼らのシャトルバスの手配が終了したら、新たに出現した3人目の人物に呼びかけるなど、かなりインテリジェントな仕組みになっている。

関連キーワード

Kinect for Windows SDK | Kinect for Xbox 360 | Microsoft | NUI(Natural User Interface) | ユーザーインタフェース | 障がい者 | 研究機関 | 医療 | 直感的 | Kinect for Windows | 言語解析 | モーションセンサー | 自然言語

Copyright © ITmedia, Inc. All Rights Reserved.