Microsoft Research、「NUI」の最新成果を報告:Kinectで進化する直感操作(2/2 ページ)

“タッチ”を大幅に取り入れたWindows 8で直感的なPC操作を可能にしたMicrosoft。しかし、彼らが目指す本当のゴールは「Natural User Interface」(NUI)だ。

臨場感投影システム「IllumiRoom」

1月初旬にMicrosoftが発表した「IllumiRoom」は、Kinectで部屋の形状を3次元的に把握し、ユーザーの後方に設置したプロジェクタを使って実行中のゲームやアプリケーションに合わせて臨場感のある背景や視覚効果を表示するシステムだ。3次元的に部屋の物体を把握しているため、画面外に投影する情報はオブジェクトの存在を認識する形で自動的に再計算して、凹凸があっても自然な形で表示する。なお、この技術の詳細については4月の学会で正式発表するという。

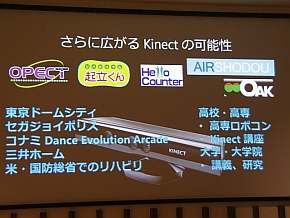

このように、Kinectをユーザーインタフェースとして利用している施設や団体は、すでに数多く存在する。研究開発中のケースも含めればかなりの数に上る。米国防総省では、退役軍人のリハビリテーションにも利用しているという。日本では、遊戯施設のほか、大学などの研究機関での利用が多いようだ。

加治佐氏は、MicrosoftがNUIで目指すのは、Kinectのようなモーションセンシングやタブレットデバイスでのマルチタッチ操作だけでなく、音声認識や自然言語解析など、より自然な形でデバイスとの対話が可能になる仕組みだと語っている。

進化するKinectと「Kinect Fusion」

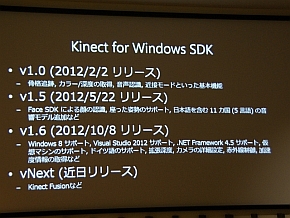

Kinectのハードウェアは、リリースした当時のままだが、後に登場したSDKでソフトウェア的な拡張を続けている。例えば、2012年5月にリリースしたバージョンでは、Kinectを使った顔認識が可能になり、「OAK」のようなシステム開発が容易になった。次期アップデートでは「Kinect Fusion」という新機能を追加するという。この機能では、Kinectを持って移動すると、移動した周囲の風景をデバイスのカメラと深度センサーが自動的に3Dイメージとテクスチャーを生成する。Kinectは、もともと加速度センサーを搭載しているので、デバイス自体を動かすと、その移動成分も検知可能だという。

Kinect for Windows SDKのロードマップ。2012年夏リリースのバージョンで顔認識などをサポートした。次のアップデートでは「Kinect Fusion」と呼ぶ3Dオブジェクト解析機能を追加する

Kinect for Windows SDKのロードマップ。2012年夏リリースのバージョンで顔認識などをサポートした。次のアップデートでは「Kinect Fusion」と呼ぶ3Dオブジェクト解析機能を追加する関連キーワード

Kinect for Windows SDK | Kinect for Xbox 360 | Microsoft | NUI(Natural User Interface) | ユーザーインタフェース | 障がい者 | 研究機関 | 医療 | 直感的 | Kinect for Windows | 言語解析 | モーションセンサー | 自然言語

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

ジェスチャーで操作するロボット作る「Kinect×教育用レゴ マインドストームNXT」

ジェスチャーで操作するロボット作る「Kinect×教育用レゴ マインドストームNXT」

「Kinect×教育用レゴ マインドストームNXT」は動きで操作できるロボットを開発可能なキット。 Kinectを活用した障害者向け活動支援ソリューション「OAK」、東大先端研と日本MSが共同開発

Kinectを活用した障害者向け活動支援ソリューション「OAK」、東大先端研と日本MSが共同開発

東京大学 先端科学技術研究センターと日本マイクロソフトは、脳性まひや脊髄性筋萎縮症などを抱える重度障害者の活動を支援するソリューション「OAK - Observation and Access with Kinect -」を共同開発。「Kinect for Windows センサー」を応用することで実現した。- 医療現場の課題を「人材力+IT力」で解決――ニチイ学館と日本マイクロソフトが業務提携

ニチイ学館と日本マイクロソフトが医療機関の経営、診療、地域連携などを支援するサービスを共同開発・販売する。第一弾としてKinectを活用した手術室向け画像操作システムを提供開始。  手術中にKinectを活用、執刀医がPCをジェスチャー操作 ニチイが世界初のシステム発売

手術中にKinectを活用、執刀医がPCをジェスチャー操作 ニチイが世界初のシステム発売

外科手術中に執刀医がPC画面をジェスチャー操作できるようにする医療支援システムをニチイ学館が発売。「手術室でKinectを活用するシステムの商用化は世界初」という。 「今年は新しいやつ、持ってこれましたよ」――2012 AKIBA PC-DIY EXPO 〜夏の陣〜リポート

「今年は新しいやつ、持ってこれましたよ」――2012 AKIBA PC-DIY EXPO 〜夏の陣〜リポート

これからのアキバのトレンドを思い描きつつ、6月23日と24日に開催された自作パーツイベント「2012 AKIBA PC-DIY EXPO 〜夏の陣〜」の見どころを一挙にリポートしたい。