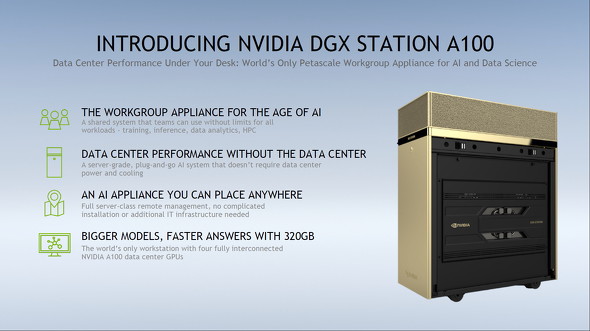

NVIDIAが新型AIワークステーション「DGX Station A100」を発表 2020年末までに発売:CPUはXeonからEPYCに

AIデータ処理に特化したNVIDIA製のワークステーションに新モデルが登場する。CPUをIntelのXeonからAMDのEPYCに変更した他、AmpereベースのハイエンドGPU「NVIDIA A100」を4基搭載することで「データセンター並みの機械学習処理を机の下で実現」した。

NVIDIAは11月16日(米国太平洋時間)、新型のAIワークステーション「NVIDIA DGX Station A100」を発表した。2020年第4半期中(12月まで)にパートナー企業を通して発売される予定だ。

DGX Station A100の概要

DGX Station A100は、「DGX Station」の後継製品で、AmpereアーキテクチャベースのハイエンドGPU「NVIDIA A100」を4基搭載している。データ科学者が自宅やオフィス(研究室)で研究作業を進めやすくするためのソリューションとして開発された。

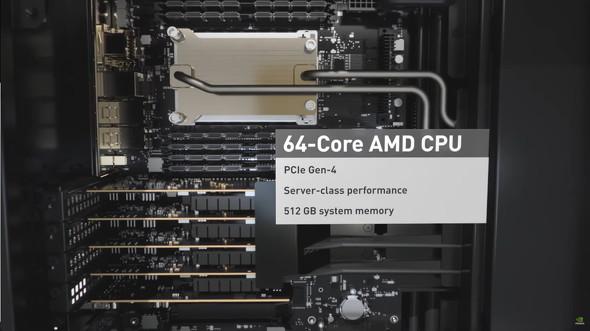

AMDのサーバ向けCPU「EPYC(エピック)」(64コア)を採用し、メインメモリは最大で512GBまで搭載できる。ストレージは1.92TBのNVMe SSDをOS用に備える他、データキャッシュ用に最大7.68TBのNVMe SSDを搭載可能だ。

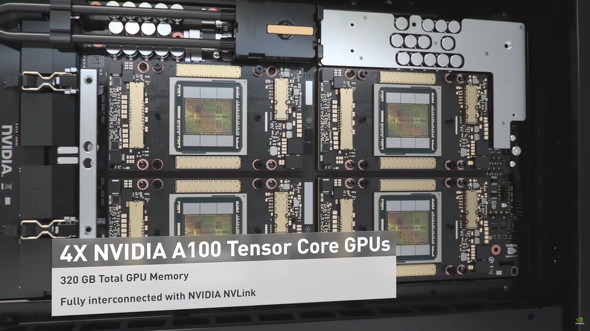

GPUのNVIDIA A100は、2020年5月に発表済みのグラフィックスメモリ40GBのカードの他、DGX Station A100と同時に発表されたグラフィックスメモリ80GBのカードも選択できる。第3世代の「NVLink」によって4基を連結することで、80GBカードを選択した場合は合計で320GBのメモリ空間を確保可能だ。同社のGPUリソース分割技術「NVIDIA Multi-Instance GPU(MIG)」を利用すると、最大で28個のインスタンスを並行処理できる。

映像出力はMini DisplayPort×4で、全ポートから4K(3840×2160ピクセル)映像を同時出力することも可能だ。有線LANは10GBASE-Tポート×2と、管理用の1000BASE-Tポート×1を備える。

GPUとしてNVIDIA A100を4基搭載し、第3世代NVLinkで連結している。画像では320GB(80GB×4)のグラフィックスメモリ空間が使えることをアピールしているが、160GB(40GB×4)の構成も用意されている

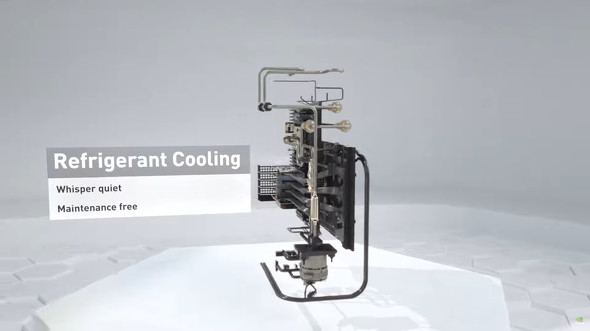

これだけハイスペックだと本体内にある熱源の冷却が不安になるが、冷媒を使った冷却システムを本体に内蔵することで解決している。このシステムはDGX Station A100のために新規開発されたもので、静音かつメンテナンスフリーであることが特徴だ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

理研、ディープラーニング解析に世界最大のNVIDIA DGX-1システムを導入 毎秒4000兆回演算

理研、ディープラーニング解析に世界最大のNVIDIA DGX-1システムを導入 毎秒4000兆回演算

プロ向けGPUもAmpereアーキテクチャを採用! 「NVIDIA RTX A6000」「NVIDIA A40」登場

プロ向けGPUもAmpereアーキテクチャを採用! 「NVIDIA RTX A6000」「NVIDIA A40」登場

コンシューマー向けの「GeForce RTX 30シリーズ」に続き、NVIDIAのプロフェッショナル向けGPUもAmpereアーキテクチャに移行する。ただし、従来とは異なり「Quadro(クアドロ)」ブランドは冠さずに展開される。【訂正】 NVIDIAが「GeForce RTX 30シリーズ」を発表 8K DLSS対応の「GeForce RTX 3090」など3製品を順次投入

NVIDIAが「GeForce RTX 30シリーズ」を発表 8K DLSS対応の「GeForce RTX 3090」など3製品を順次投入

NVIDIAが、リアルタイムレイトレーシング対応GPUの新世代製品を発表した。先代の発売当初の価格をキープしつつ、性能を大幅に引き上げたことが特徴だ。 全てのハイエンドが“過去”になる――4Kゲーミングの最高峰「GeForce RTX 3080」先行レビュー

全てのハイエンドが“過去”になる――4Kゲーミングの最高峰「GeForce RTX 3080」先行レビュー

日本でも9月17日に発売する「GeForce RTX 3080」だが、その実力はいかほどなのだろうか。発売前日だが、「Fouders Edition」(リファレンスカード)を使って先行チェックする。 価格、パフォーマンス、消費電力の“三方良し” 「GeForce RTX 3070」徹底レビュー

価格、パフォーマンス、消費電力の“三方良し” 「GeForce RTX 3070」徹底レビュー

10月29日22時に発売される「GeForce RTX 3070」は、GeForce RTX 30シリーズのエントリー製品である。メーカーのNVIDIAは前世代のハイエンド「GeForce RTX 2080 Ti」とほぼ同じか、それを超える性能を発揮するというが本当なのだろうか。ベンチマークテストを通してチェックしてみよう。