Intel偑乽師悽戙Xeon僾儘僙僢僒乮Sapphire Rapids乯乿傪僠儔尒偣丂峀懷堟儊儌儕撪憼僶乕僕儑儞傪梡堄丗Xe-HPC偼乽専徹抜奒乿偵

僗乕僷乕僐儞僺儏乕僞乕偺悽奅揑側僀儀儞僩乽ISC 2021乿偵崌傢偣偰丄Intel偑HPC乮僴僀僷僼僅乕儅儞僗僐儞僺儏乕僥傿儞僌乯偵娭偡傞庢傝慻傒傪敪昞偟偨丅偦偺拞偱丄師悽戙偺Xeon僗働乕儔僽儖僾儘僙僢僒乮奐敪僐乕僪柤丗Sapphire Rapids乯偵HBM乮峀懷堟儊儌儕乯傪撪憼偡傞僶乕僕儑儞偑梡堄偝傟傞偙偲偑柧傜偐偲側偭偨丅

丂Intel偼6寧28擔乮暷崙懢暯梞帪娫乯丄ISC乮International Supercomputing Conference乯 2021偺奐嵜偵崌傢偣偰丄HPC乮僴僀僷僼僅乕儅儞僗僐儞僺儏乕僥傿儞僌乯傗AI乮恖岺抦擻乯偵娭偡傞庢傝慻傒傪敪昞偟偨丅偦偺拞偱丄師悽戙偺乽Xeon僗働乕儔僽儖僾儘僙僢僒乿乮奐敪僐乕僪柤丗Sapphire Rapids乯偺奣梫偑彮偟偩偗愢柧偝傟偰偄傞丅

Sapphire Rapids偺摿挜

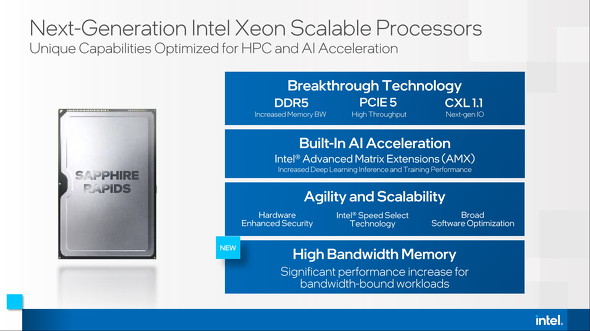

丂怴悽戙Xeon僗働乕儔僽儖僾儘僙僢僒偼丄10nm僾儘僙僗偱奐敪偑恑傔傜傟偰偄傞丅崱夞偺乬僠儔尒偣乭偱偼丄埲壓偺傛偆側婡擻傪旛偊偰偄傞偙偲偑敪昞偝傟偨丅

- DDR5儊儌儕偲HBM乮峀懷堟儊儌儕乯偺僒億乕僩

- PCI Express 5.0偺僒億乕僩

- CXL乮Compute Express Link乯 1.1偺僒億乕僩

- Intel AMX乮Advanced Matrix Extensions乯偺搵嵹

丂怴偨偵岞昞偝傟偨偺偼丄HBM偺僒億乕僩偱偁傞丅堦晹偺SKU乮儌僨儖乯偱HBM傪撪憼乮摑崌乯偟偨僶乕僕儑儞傪梡堄偡傞傛偆偩丅

丂偦偺柤偺捠傝丄HBM偼僶僗暆傪戝偒偔庢傞偙偲偱傾僋僙僗懍搙傪堷偒忋偘偨儊儌儕偱丄尰嵼偼HPC乮僴僀僷僼僅乕儅儞僗僐儞僺儏乕僥傿儞僌乯岦偗偺GPU偵偍偄偰丄戞2悽戙偵憡摉偡傞乽HBM2乿傗乽HBM2E乿乮HBM2偺懷堟傪傛傝峀偘偨傕偺乯傪僌儔僼傿僢僋僗儊儌儕偲偟偰嵦梡偝傟傞帠椺偑懡偄丅

丂HBM撪憼儌僨儖偱偼丄HBM偺傒偼傕偪傠傫丄DDR5儊儌儕偲慻傒崌傢偣偰壱摥偡傞偙偲傕偱偒傞丅

丂怴悽戙Xeon僗働乕儔僽儖僾儘僙僢僒偼丄婛偵堦晹偺尋媶婡娭偱棙梡偑奐巒偝傟偰偄傞丅HBM撪憼僶乕僕儑儞偺儕儕乕僗傕岲堄揑偵庴偗擖傟傜傟偰偄傞偲偄偆丅PCI Express 5.0傗CXL 1.1偵傛偭偰擖弌椡懷堟偑峀偑偭偨偙偲偲憡傑偭偰丄恖岺抦擻張棟傗僨乕僞暘愅偺僷僼僅乕儅儞僗偑岦忋偡傞偙偲傪婜懸偟偰偄傞傛偆偩丅

丂側偍丄怴悽戙Xeon僗働乕儔僽儖僾儘僙僢僒帺懱偺彜梡採嫙偺帪婜偼柧尵偝傟偰偄側偄丅

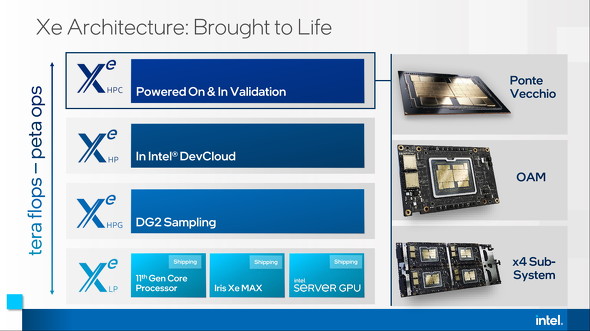

HPC岦偗GPU乽Xe-HPC乿偼専徹抜奒偵堏峴

丂摨幮偑HPC岦偗偵奐敪傪恑傔偰偄傞GPU乽Xe-HPC乿乮壖徧丄奐敪僐乕僪柤丗Ponte Vecchio乯偵偮偄偰偼丄2021擭弶摢偵婲摦妋擣偑姰椆偟丄僔僗僥儉専徹夁掱偵堏峴偟偨偲偄偆丅

丂Xe-HPC偼HBM儊儌儕傪搵嵹偡傞側偳丄HPC偵嵟揔側愝寁偲側偭偰偄傞丅昁梫偵墳偠偰丄OAM乮OCP Accelerator Module乯傗偦傟傪暋悢枃搵嵹偟偨僒僽僔僗僥儉偲偟偰採嫙偡傞偙偲傕壜擻偱丄僔僗僥儉偺婯柾偵墳偠偰張棟擻椡傪廮擃偵挷惍偱偒傞偲偄偆丅

Copyright © ITmedia, Inc. All Rights Reserved.

娭楢婰帠

Intel偑乽戞3悽戙Xeon僗働乕儔僽儖僾儘僙僢僒乮Ice Lake乯乿傪敪昞丂嵟戝40僐傾偱張棟擻椡傪岦忋

Intel偑乽戞3悽戙Xeon僗働乕儔僽儖僾儘僙僢僒乮Ice Lake乯乿傪敪昞丂嵟戝40僐傾偱張棟擻椡傪岦忋

Intel偑丄Ice Lake傾乕僉僥僋僠儍偵婎偯偔戞3悽戙Xeon僗働乕儔僽儖僾儘僙僢僒傪敪昞偟偨丅僋儘僢僋摉偨傝偺張棟惈擻傪岦忋偟丄婡夿妛廗儀乕僗偺AI張棟傕崅懍壔偟偰偄傞丅側偍丄婛懚偺Cooper Lake傾乕僉僥僋僠儍偺惢昳偼宲懕斕攧乮暪攧乯偝傟傞丅 AMD偑僒乕僶岦偗CPU乽EPYC 7003僔儕乕僘乿傪敪昞丂Zen 3傾乕僉僥僋僠儍偱僋儘僢僋摉偨傝偺惈擻傪岦忋

AMD偑僒乕僶岦偗CPU乽EPYC 7003僔儕乕僘乿傪敪昞丂Zen 3傾乕僉僥僋僠儍偱僋儘僢僋摉偨傝偺惈擻傪岦忋

AMD偑Zen 3傾乕僉僥僋僠儍傪嵦梡偟偨僒乕僶乛僨乕僞僙儞僞乕岦偗CPU傪敪攧偡傞丅僋儘僢僋摉偨傝偺惈擻偑岦忋偟偨偙偲偱丄幚梡僷僼僅乕儅儞僗傕傛傝岦忋偟偰偄傞偲偄偆丅 NVIDIA偺僨乕僞僙儞僞乕岦偗GPU乽NVIDIA A100乿PCI Express 4.0儌僨儖偵80GB峔惉搊応丂儊儌儕懷堟暆偼枅昩2TB偵奼挘

NVIDIA偺僨乕僞僙儞僞乕岦偗GPU乽NVIDIA A100乿PCI Express 4.0儌僨儖偵80GB峔惉搊応丂儊儌儕懷堟暆偼枅昩2TB偵奼挘

NVIDIA偺僨乕僞僙儞僞乕岦偗GPU乽NVIDIA A100乿偺PCI Express僇乕僪儌僨儖偵丄僌儔僼傿僢僋僗儊儌儕傪80GB偵攞憹偟偨峔惉偑搊応偡傞丅廬棃偺40GB峔惉偲斾傋偰儊儌儕懷堟暆偑奼挘偝傟偰偍傝丄儊儌儕梕検憹壛埲忋偺僷僼僅乕儅儞僗傾僢僾傪婜懸偱偒傞丅 NVIDIA偑怴宆AI儚乕僋僗僥乕僔儑儞乽DGX Station A100乿傪敪昞丂2020擭枛傑偱偵敪攧

NVIDIA偑怴宆AI儚乕僋僗僥乕僔儑儞乽DGX Station A100乿傪敪昞丂2020擭枛傑偱偵敪攧

AI僨乕僞張棟偵摿壔偟偨NVIDIA惢偺儚乕僋僗僥乕僔儑儞偵怴儌僨儖偑搊応偡傞丅CPU傪Intel偺Xeon偐傜AMD偺EPYC偵曄峏偟偨懠丄Ampere儀乕僗偺僴僀僄儞僪GPU乽NVIDIA A100乿傪4婎搵嵹偡傞偙偲偱乽僨乕僞僙儞僞乕暲傒偺婡夿妛廗張棟傪婘偺壓偱幚尰乿偟偨丅 NVIDIA偑僨乕僞僙儞僞乕岦偗CPU乽Grace乿傪奐敪丂Arm傾乕僉僥僋僠儍傪嵦梡偟偰2023擭弶摢偵敪攧傊

NVIDIA偑僨乕僞僙儞僞乕岦偗CPU乽Grace乿傪奐敪丂Arm傾乕僉僥僋僠儍傪嵦梡偟偰2023擭弶摢偵敪攧傊

NVIDIA偑丄僨乕僞僙儞僞乕岦偗GPU偵壛偊偰乬CPU乭偺奐敪傪昞柧偟偨丅尰嵼攦廂庤懕偒傪恑傔偰偄傞Arm偺傾乕僉僥僋僠儍傪巊偭偰愝寁偡傞偙偲偱丄徣揹椡惈偲崅懍墘嶼傪椉棫偟偨偙偲偑摿挜偩丅