パナソニック、拡散モデルによるマルチモーダルAI「LaViDa」開発 文章生成を高速化

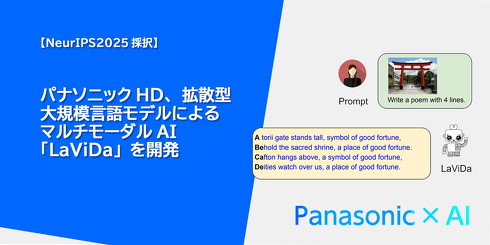

パナソニック ホールディングスと傘下の米パナソニックR&Dカンパニー オブ アメリカは、主に画像生成AIに利用する「拡散モデル」で文章を生成するマルチモーダルAI「LaViDa」を開発したと発表した。

パナソニック ホールディングス(パナソニックHD)と傘下の米パナソニックR&Dカンパニー オブ アメリカは11月27日、主に画像生成AIに利用する「拡散モデル」で文章を生成するマルチモーダルAI「LaViDa」を開発したと発表した。米カリフォルニア大学ロサンゼルス校の研究者と協力。従来の文章生成で多く使われる「自己回帰型モデル」の一部に比べ、処理を高速化したという。

拡散モデルによる文章生成では、入力データの一部にランダムにマスキングを施し、それを復元していく。自己回帰型モデルに比べ、処理を高速化できるなどの強みを持つ一方、1)単語同士の関連度を演算する「アテンション計算」が重くなる、2)学習時のマスキングに不具合が生じる可能性が高まる、という課題があった。

そこで、パナソニックHDらは、入力画像と質問文のトークン(データを処理するために分割した最小単位)のアテンション計算から、出力する文章のトークンを排除する仕組み「Prefix-DLM」を開発した。これにより、計算を効率化。加えて、マスキングするトークンに漏れがないよう、相補的な2通りのマスキングを用意し、全てのトークンをAIが学習できるようにした。

ベンチマークの結果、LaViDaは、自己回帰型モデル「Open-LLaVa-Next-8B」に比べ、グラフなどが含まれる書類の内容理解や、数学の証明問題などで高い性能を示し、文章の生成も速かったという。また、自己回帰型モデルが苦手とされる特定の形式に沿った文章生成もできたという。

今回の研究成果は、機械学習分野の国際会議「NeurIPS 2025」に採択された。12月3日から5日まで米国サンディエゴで開催される本会議にて発表予定。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

松下幸之助の“AI偽動画”出回る、PHP研究所が注意喚起 「見かけたら通報フォームに報告を」

松下幸之助の“AI偽動画”出回る、PHP研究所が注意喚起 「見かけたら通報フォームに報告を」

PHP研究所は、松下幸之助氏の“AI偽動画”に注意を呼び掛けた。同氏の画像や音声をAIによって不正に合成した動画が、Web上に出回っていることを確認したという。 “6分で分かる”ビジネスパーソン向け「AIエージェント入門資料」、パナソニックコネクトが公開

“6分で分かる”ビジネスパーソン向け「AIエージェント入門資料」、パナソニックコネクトが公開

パナソニックコネクトは、「6分でわかるビジネスパーソンのためのやさしいAIエージェント入門」と題した資料を公開した。AIエージェントの特長や仕組みなどを、全24枚のスライドで解説している。 「今日の夕飯なに作ろう?」をAIが解決 パナソニック、AI料理アシスタントサービス開始

「今日の夕飯なに作ろう?」をAIが解決 パナソニック、AI料理アシスタントサービス開始

パナソニックは、料理に関する質問ができるチャットAIサービス「Bistroアシスタント」の提供を始めた。同社が手掛けるオーブンレンジ「Bistro」シリーズを利用するユーザー向けの有料サービスで、ユーザーの要望に応じたレシピの提案などができるという。 パナソニック、1000億パラメータの社内専用LLMを開発へ AIスタートアップ・ストックマークと協業

パナソニック、1000億パラメータの社内専用LLMを開発へ AIスタートアップ・ストックマークと協業

パナソニックホールディングスは、パナソニックグループ専用大規模言語モデル(LLM)「Panasonic-LLM-100b」を開発すると発表した。AIスタートアップ企業のストックマーク(東京都港区)と協業し、開発していく。 米AI企業のAnthropic、東京に拠点開設へ 「Claude」日本語版もリリース予定

米AI企業のAnthropic、東京に拠点開設へ 「Claude」日本語版もリリース予定

米Anthropicは、秋ごろに東京都に拠点を開設すると発表した。併せて、同社のAIサービス「Claude」の日本語版をリリースする。