Google、「Gemma 4」のテキスト生成を最大3倍高速化する「MTP」をリリース

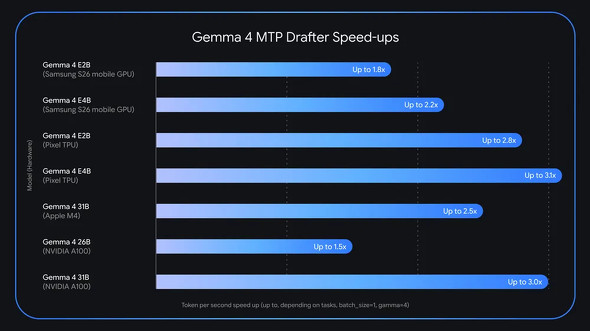

Googleは、オープンモデル「Gemma 4」向けにテキスト生成を最大3倍高速化するマルチトークン予測ドラフター(MTP)をリリースした。投機的デコーディングを採用し、生成品質を保ちながら推論を並列化する。主要な推論フレームワークに対応し、エッジからクラウドまで多様な環境で実用性を高める技術だ。

米Googleは5月6日(現地時間)、4月に公開した高性能オープンモデル「Gemma 4」向けに、テキスト生成を最大3倍高速化するよう設計されたマルチトークン予測ドラフター(MTP)をリリースしたと発表した。

通常のLLMの推論はメモリ帯域幅がボトルネックになりやすく、単一のトークンを生成するためだけに数十億のパラメータをVRAMから演算ユニットへ移動させる必要があり、計算リソースが十分に活用されず高いレイテンシが発生するという課題を抱えている。特に、コーディングアシスタントや複数のステップを迅速に計画する自律型エージェント、ミリ秒単位の応答が求められるリアルタイムチャットや音声アプリケーションなどでは、この遅延は本番環境へのデプロイにおける最大の障壁となるため、推論速度を根本から引き上げる技術が必要とされていた。

この課題を解決するため、MTPは「Speculative Decoding」(投機的デコーディング)と呼ばれる仕組みを採用している。これは、モデルが1つずつ自己回帰的にトークンを生成する従来のプロセスとは異なり、大規模なターゲットモデル(Gemma 4の31Bなど)と、軽量で高速なドラフトモデルを組み合わせて推論を並行化するアプローチだ。アイドル状態の計算リソースを活用してドラフトモデルが複数の未来のトークンを先行して予測し、それをターゲットモデルが一括して検証する。ターゲットモデルが予測を承認すれば、1度のフォワードパスでシーケンス全体を受け入れ、さらに独自のトークンを1つ追加して出力するため、生成品質や推論ロジックを一切損なうことなく処理を大幅に高速化できる。

このドラフトモデルはターゲットモデルのアクティベーションを活用し、KVキャッシュを共有することで効率を高めている。さらに、小型モデル向けには語彙全体での計算を省くためのクラスタリング手法が組み込まれているほか、26Bの混合エキスパート(MoE)モデルでは、バッチサイズを4から8程度に増やして並列処理することでエキスパートの重みの再利用効率が高まり、ローカル環境で最大約2.2倍の速度向上が得られる仕組みとなっている。

MTPドラフターはGemma 4本体と同じApache 2.0ライセンスの下で公開されており、エッジデバイスから開発者のローカルワークステーション、クラウド環境まで、あらゆる場所で動作するように設計されている。Hugging Face Transformers、MLX、vLLM、SGLang、Ollama、LiteRT-LMなどの主要な推論フレームワークに対応しており、コンシューマー向けGPUやApple Siliconを搭載したPC上で複雑なオフラインワークフローを高速に実行できる。

「Google AI Edge Gallery」を通じてAndroidやiOSのモバイルデバイス上でも直接実行でき、特にエッジモデル(E2B、E4B)では推論が迅速に完了することでデバイスのバッテリー消費を抑える効果も期待できるとしている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Google、エージェント特化の「Gemma 4」をApache 2.0で公開

Google、エージェント特化の「Gemma 4」をApache 2.0で公開

Googleは、高性能オープンモデル「Gemma 4」をApache 2.0ライセンスで公開した。エージェント型ワークフローに特化し、最大25.6万トークンのコンテキストウィンドウに対応。モバイル向けの軽量版から31Bの大型モデルまで4種を展開する。AndroidやNVIDIAのGPUにも最適化され、ローカル環境での高度な推論を支援する。 Google、推論の深さを制御する「thinking levels」搭載の「Gemini 3.1 Flash-Lite」リリース

Google、推論の深さを制御する「thinking levels」搭載の「Gemini 3.1 Flash-Lite」リリース

Googleは、Gemini 3シリーズ最速の「Gemini 3.1 Flash-Lite」をリリースした。「Gemini 2.5 Flash」と比較して出力が2.5倍高速化し、ベンチマークでもそれを上回る性能を達成。タスクに応じた推論の深さを制御できる「thinking levels」も搭載し、大量翻訳から高度なSaaSエージェントまで幅広い用途に対応するとしている。 Google、推論を強化した「Gemini 3.1 Pro」発表 GitHub Copilotでも利用可能に

Google、推論を強化した「Gemini 3.1 Pro」発表 GitHub Copilotでも利用可能に

Googleは、推論能力を強化した最新モデル「Gemini 3.1 Pro」を発表した。論理パズル等の難関ベンチマークで前モデルの2倍以上の性能を記録。複雑なSVGアニメーションのコード生成も可能になった。GeminiアプリやNotebookLM(ProとUltra)で利用できるほか、GitHub Copilotでもパブリックプレビューとして提供が開始された。 Googleのオープンな生成AIモデル「Gemma」、1億5000万超ダウンロード

Googleのオープンな生成AIモデル「Gemma」、1億5000万超ダウンロード

Googleのオープンな生成AIモデル「Gemma」のダウンロード数が累計1億5000万回を超えたと発表した。Gemmaは昨年2月に公開された。2023年2月に公開されたGemmaと競合するMetaの「Llama」のダウンロード数は累計12億回以上だ。