ニュース

KDDIら、アジア最大規模のAI向けデータセンター構築へ シャープの堺工場跡地を活用

KDDIは、シャープらと共にアジア最大規模のAI向けデータセンター構築に向けた協議を始めると発表した。

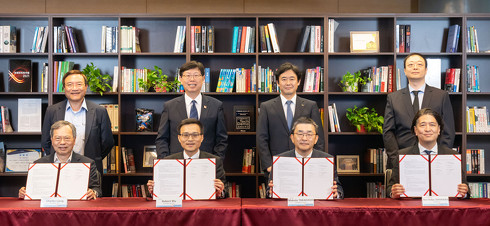

KDDIは6月2日、シャープらと共にアジア最大規模のAI向けデータセンター構築に向けた協議を始めると発表した。同社らの他にPCベンダーの米Super Micro Computerとデータサイエンス事業を手掛けるデータセクション(東京都品川区)も参加。シャープの堺工場跡地に構築する予定で、稼働時期については「早期の稼働を目指す」という。

AI計算基盤には、米NVIDIAの「GB200 NVL72」を1000ユニット搭載することを検討中で、これが実現すればアジア最大規模のAIデータセンターになるという。KDDIはネットワークの構築・運用を、データセクションはAIデータセンターの運営支援などを提供する予定。また、Super Micro Computerが「膨らむ発熱量に対応可能なプラットフォーム」を提供することも協議している。

KDDIは「AIが加速度的に進化するなか、急増するAI処理に対応できるAIデータセンターの構築が求められている」と説明する。一方、大規模なAIデータセンターの構築には「最先端の演算装置の調達」「設備の発熱を抑える高効率な冷却システムの整備」「電力・場所の確保」の3点が課題だと指摘。これらの課題をクリアするために4社で連携し、AIデータセンターの構築を目指す。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

NVIDIA、AI需要で過去最高の売上高 「次の産業革命が始まった」とファンCEO

NVIDIA、AI需要で過去最高の売上高 「次の産業革命が始まった」とファンCEO

NVIDIAの2月〜4月の決算は、売上高は前年同期比約3.6倍の260億4400万ドル、純利益は約7.3倍だった。AI需要でデータセンター向けGPUが快調で、ファンCEOは「次の産業革命が始まった」と語った。 「RAGはそんなに簡単じゃない」──AIエンジニア主導でLLMを導入すると失敗に? 日本語特化のELYZA・曽根岡CEOに聞く、LLM開発&活用のいま

「RAGはそんなに簡単じゃない」──AIエンジニア主導でLLMを導入すると失敗に? 日本語特化のELYZA・曽根岡CEOに聞く、LLM開発&活用のいま

GPT-3.5と同水準の日本語特化型LLMを開発したELYZA。4月にはKDDIグループの傘下となり、注目を集めている。日本語性能トップクラスのLLMをどう作っているのか。KDDI傘下になったのはどんな狙いが? LLM活用でいま注目のポイントは? 気になることを、曽根岡侑也CEOにインタビューした。 NVIDIA、4608基のH100GPUを搭載したデータセンター規模のAIスパコン「Eos」を披露

NVIDIA、4608基のH100GPUを搭載したデータセンター規模のAIスパコン「Eos」を披露

米NVIDIAは同社が独自に開発したデータセンター規模のスーパーコンピュータ「Eos」をブログと動画で披露しました。 “純粋な国産AI”誕生 ハードもデータも全部日本製 スパコン「富岳」で開発

“純粋な国産AI”誕生 ハードもデータも全部日本製 スパコン「富岳」で開発

スーパーコンピュータ「富岳」で学習をした日本語特化の大規模言語モデルを開発した──東京工業大学と東北大学、富士通、理化学研究所、名古屋大学、サイバーエージェント、Kotoba Technologiesの合同研究チームは、そんな発表をした。