初の“長考できる”国産LLM、どう開発? 「PLaMo 3.0 Prime」の資料公開、PFN

Preferred Networksは、フルスクラッチで開発したLLM「PLaMo 3.0 Prime」β版の開発に関する資料を公開した。同モデルの開発手法の一部や、同社が国産LLMを開発する理由などを紹介している。

Preferred Networks(PFN)は4月5日、フルスクラッチで開発したLLM「PLaMo 3.0 Prime」β版の開発に関する資料を公開した。同モデルの開発手法の一部や、同社が国産LLMを開発する理由などを紹介している。

AIモデルの開発は、大量のテキストを学習させて言語能力を高める事前学習と、人間の求める出力を目指す事後学習に大きく分けられる。資料では、主に事後学習に焦点を当て、PLaMo 3.0 Primeのβ版の開発方法を解説している。

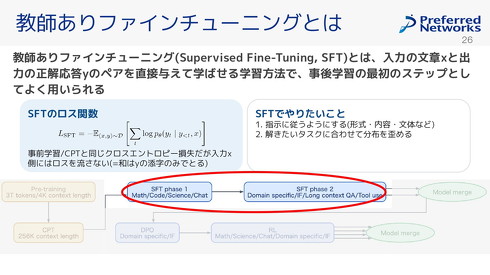

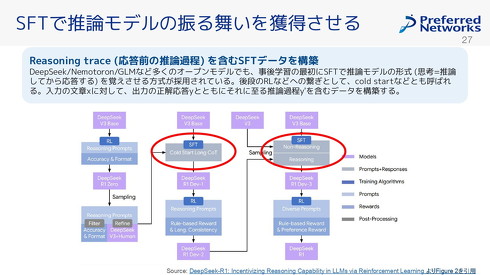

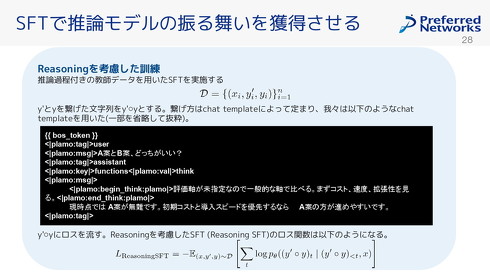

例えば、入力と正解となる出力の組み合わせをAIに学ばせる教師ありファインチューニングや、AIが試行錯誤しながらよりよい出力に改善する強化学習などに関する取り組みを紹介。加えて、長考によって質の高い出力をする推論(Reasoning)機能を最適化するための工夫なども挙げている。

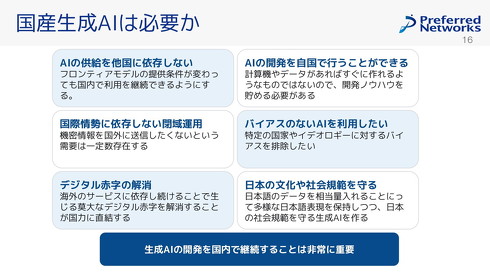

また、資料ではPFNが国産LLMを開発する理由も説明している。PFNは、日本のAIモデルの性能は現時点で、米国や中国のモデルに及ばないとの認識を示す。一方、米国や中国のAIモデルを、今後も同条件で利用できるとは限らないと指摘する。AIの供給を他国に依存せず、国内で開発・運用する体制などのためにも、国産LLMが重要としている。

PLaMo 3.0 Primeのβ版は、PFNが3月19日に公開したAIモデル。既存のAIモデルを下敷きにせず、ゼロベースで構築した。国内で開発されたフルスクラッチモデルでは、初となる推論機能を備えている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

初の“長考”できる国産フルスクラッチLLM「PLaMo 3.0 Prime」 Qwen3-235Bやgpt-oss-120bに肉薄 PFN

初の“長考”できる国産フルスクラッチLLM「PLaMo 3.0 Prime」 Qwen3-235Bやgpt-oss-120bに肉薄 PFN

Preferred Networksが既存モデルを下敷きにせず、ゼロベースで構築した大規模言語モデル「PLaMo 3.0 Prime」のβ版をリリースした。中国産モデル「DeepSeek R-1」などの開発手法を参考に、同様の形で開発したモデルとしては国内で初めて、長考によってクオリティーの高い回答(reasoning)が可能な機能を搭載した。 GMOとPFNが資本提携、合弁会社を設立 「国産AI環境」提供へ

GMOとPFNが資本提携、合弁会社を設立 「国産AI環境」提供へ

Preferred Networksは、GMOインターネットグループと同社傘下のGMOサイバーセキュリティ byイエラエと資本業務提携し、合弁会社「GMO Preferred Security」を設立したと発表した。 Preferred Networks、岡野原氏が社長に就任 西川氏は会長に

Preferred Networks、岡野原氏が社長に就任 西川氏は会長に

Preferred Networksは、これまで最高技術責任者を務めていた岡野原大輔氏が、代表取締役社長に就任したと発表した。これに伴い、最高経営責任者を務めていた西川徹氏は、代表取締役会長に就く。 「国内で完結する生成AI基盤」開発へ さくら、Preferred、NICTが協業

「国内で完結する生成AI基盤」開発へ さくら、Preferred、NICTが協業

Preferred Networksとさくらインターネット、情報通信研究機構(NICT)の3社は、完全に国内で完結する国産生成AIのエコシステム構築を目指すことで基本合意した。 住友生命、PFNに出資 「協業も検討」

住友生命、PFNに出資 「協業も検討」

住友生命はAIスタートアップのPreferred Networks(PFN)に出資すると発表した。PFNとの協業も検討する。