Micronがサーバ/データセンター用「LPDRAM SOCAMM2」の256GBモデルをサンプル出荷 新しいLPDDR5Xダイで容量アップ+消費電力削減

Micronが、サーバ/データセンター用の「LPDRAM SOCAMM2」において256GBモデルをサンプル出荷を開始した。省電力性と高速性を両立したLPDDR5Xメモリをより大容量に使えるようにすることで、メモリ回りのTCOを改善する狙いがある。

Micron Technologyは3月3日(米国山岳部標準時)、サーバ/データセンター向けメモリモジュール「LPDRAM SOCAMM2」の256GBモデルを開発し、サンプル出荷を開始したと発表した。従来の約1.33倍の容量(192GB→256GB)を備えており、AI処理を行うデータセンターで求められる大容量と省電力を両立しつつ、RDIMM(Registered Dual Inline Memory Module)と比べて設置面積を減らせることが特徴だ。

- →SOCAMM2(マイクロン)

そもそも「LPDRAM SOCAMM2」って何?

LPDRAM SOCAMM2と聞いて「何の略なのか?」と思う人もいると思うので、少し詳しく解説する。

LPDRAM≒LPDDR5Xメモリ

LPDRAMは「Low-Power DRAM(Dynamic Random Access Memory)」の略だ。要するに通常と比べて低消費電力のDRAMということになる。

PC/ワークステーションやサーバなどで使われるDRAMは、1サイクルで2回データ転送を行えるDDR(Double-Data-Rate)メモリが一般的で、現在は第5世代の「DDR5」が主流だ。

そのため、ここでいう「LPDRAM」はLPDDR5X規格のメモリのことを指す。

SOCAMM2

SOCAMM2は「CAMM(Compression-Attached Memory Modules)」の一種で、クライアントデバイス(PC/ワークステーション)向けの「LPCAMM2(第2世代LPCAMM)」と比べると大容量を狙った製品となる。「SO」は「Small Outline(小型)」を、「2」は第2世代をそれぞれ意味する。

CAMMは日本語で「圧着式メモリモジュール」と呼ばれており、その名の通り「差し込み」ではなく「圧着(ネジ止め)」で装着することが特徴で、従来のDIMMモジュールと比べるとメモリスロットとの“密着度”を高められるため、より高速なメモリを着脱可能な形で実装できるというメリットがある。

MicronはCAMMの開発や普及に熱心で、先述のLPCAMM2もMicronが標準化に大きな役割を果たした。今回発表されたSOCAMM2は、同社がNVIDIAと共同でサーバ/データセンター向けに開発した「SOCAMM」の次世代製品ということになる。

256GBのLPDRAM SOCAMM2って何がすごいの?

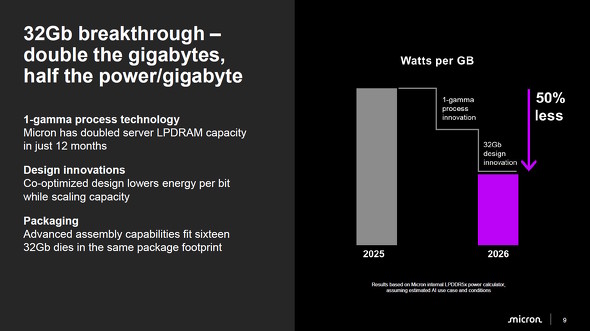

今回Micronが発表した256GBのLPDRAM SOCAMM2は、従来は1枚当たり最大192GBだった容量を、新たに開発した「32GbitモノリシックLPDRAMダイ」を適用したLPDDR5Xメモリモジュールを使うことで256GBに拡大したことが一番の特徴だ。

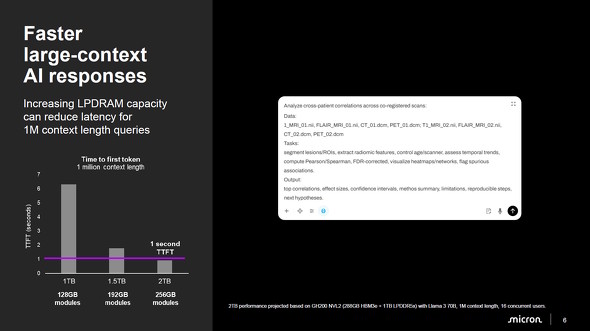

これにより、このモジュールと8チャンネルのLPDDR5Xメモリに対応するCPUを組み合わせると、最大で2TBのシステムメモリを確保できる。より大きなサイズのコンテクストウィンドウや推論ワークロードに対応できるようになるため、システム全体のパフォーマンスの改善につながる。

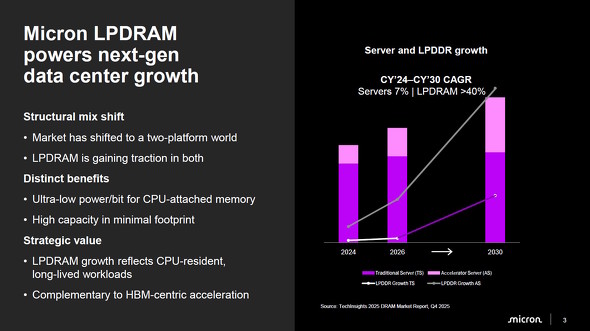

サーバ/データセンターではLPDRAM(≒LPDDRメモリ)の需要が高まるという予測があり、特にCPUに常駐する長時間ワークロードにおいて「HBM(広帯域メモリ)中心の高速化」を補完する役割を果たすと見られている

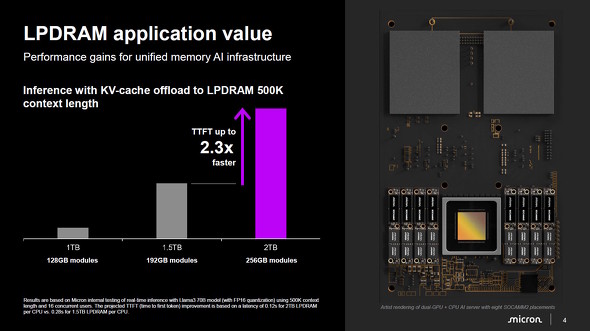

Micronが実施したテストでは、ユニファイドメモリアーキテクチャのシステム(※1)においてこのモジュールを8枚(合計1.5TB)搭載した場合、128GBのモジュールを8枚(合計1TB)搭載した場合と比べて、長文コンテキストのリアルタイムLLM(大規模言語モデル)の推論における1つ目のトークン生成が2.3倍以上高速になったという。

- →テストの詳細(英語)

(※1)NVIDIA Hopper GPU(HBM3e搭載)とNVIDIA Grace CPU(LPDDR5Xメモリ対応)をNVLink-C2Cでつないだシステム

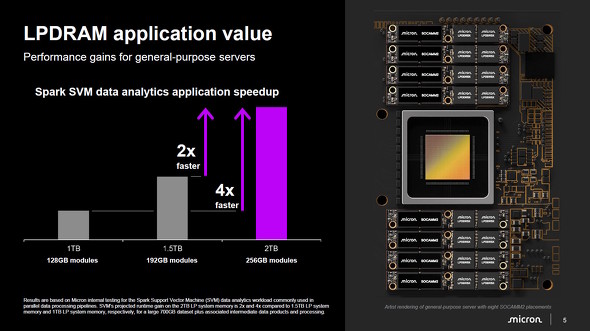

Micronでは、より容量の大きいLPDRAM SOCAMM2は汎用(はんよう)サーバにもメリットがあるとしている。

SVM(サポートベクターマシン)アルゴリズムによるデータ分析アプリを、今回発表したメモリモジュールを8枚(合計2TB)搭載したシステムで稼働すると、128GBモジュールを8枚(合計1TB)搭載したシステムと比べて最大4倍、現行の最大容量である192GBモジュールを8枚(合計1.5TB)搭載したシステムと比べても最大2倍のパフォーマンスを発揮できるという。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

さようなら「Crucial」――Micronがコンシューマー向け製品事業から撤退 販売は2026年2月まで継続

さようなら「Crucial」――Micronがコンシューマー向け製品事業から撤退 販売は2026年2月まで継続

Micronが、「Crucial」ブランドで展開しているコンシューマー向け製品事業からの撤退を発表した。データセンター向け製品に注力するための経営判断で、販売自体は2026年2月まで継続するという。 メモリの新規格「LPCAMM2」「GDDR7」をCOMPUTEX TAIPEIで見てきた

メモリの新規格「LPCAMM2」「GDDR7」をCOMPUTEX TAIPEIで見てきた

先週開催されていた見本市「COMPUTEX TAIPEI 2024」では、会場のブース各所にメモリやメモリモジュールの新規格が展示されていた。それらをチェックしよう。 「LPCAMM2」でオンボードメモリがなくなるかも? Micronがプッシュする新型メモリモジュールのメリット

「LPCAMM2」でオンボードメモリがなくなるかも? Micronがプッシュする新型メモリモジュールのメリット

MicronがノートPC向けの「LPCAMM2」なる新型メモリモジュール規格の説明会を開催した。従来のノートPCで使われてきた「SO-DIMM」と比べて、どのようなメリットがあるのだろうか。 Micron、1βプロセスノードを採用したLPDDR5Xメモリをサンプル出荷

Micron、1βプロセスノードを採用したLPDDR5Xメモリをサンプル出荷

米Micron Technologyは、最先端DRAMテクノロジーとなる1βプロセスノードを採用したLPDDR5Xメモリ製品のサンプル出荷を開始した。 「これで年単位の品薄が確定」――“Crucial撤退ショック”のPCパーツショップ

「これで年単位の品薄が確定」――“Crucial撤退ショック”のPCパーツショップ

12月3日に突如発表されたCrucialの撤退のニュースは、アキバのPCパーツショップを大きく揺さぶった。売り場での混乱は見られなかったが、どのショップも事態の深刻さに打ちひしがれていた。