生成AIブームの裏にひそむ「AIリスク」 ハーバード大で起業した日本人経営者が語る“AIとの向き合い方”(2/2 ページ)

ITリーダーが知るべきAIの品質・リスク管理の手法

一方で、リスクを十分に考慮してAIを開発、運用している企業は少ないのが実情だと同氏は指摘する。多大なコストと時間をかけて開発したAIモデルが十分な成果を上げられずに、早々にすてられてしまうケースも後を絶たない。

「現在のAIは精度を重視するあまり、リスクをはじめとする他の評価指標があまりにも軽視されています。車に例えれば、『速度が十分出ていれば出荷準備完了!』と言っているようなものです。本来はブレーキやハンドル、さまざまな機能を漏れなくテストして品質を担保しなくてはいけないのに、それをほとんどやらないまま平気で公道を走っているのです」

AIの品質を担保するためのテスト技法はいまだ確立されておらず、ベテランのデータサイエンティストが「俺がテストしたモデルなんだから大丈夫!」と言えばそれが通るような属人化の問題がある。

AIリスクへの課題意識から、Robust IntelligenceではAI開発時に網羅するべきテストを自動的に実行する「AI Stress Testing」、本番運用を開始した後のAIモデルが十分な品質を保っているか「1日1回」「1時間に1回」といったスパンで自動的にチェックする「AI Continuous Testing」、AIモデルへの不適切なデータのインプットなどをブロックする「AI Firewall」の3サービスから成るプラットフォームを提供する。これによって開発から運用まで一貫してAIの健全性を保ち、前述のリスクを回避するという。

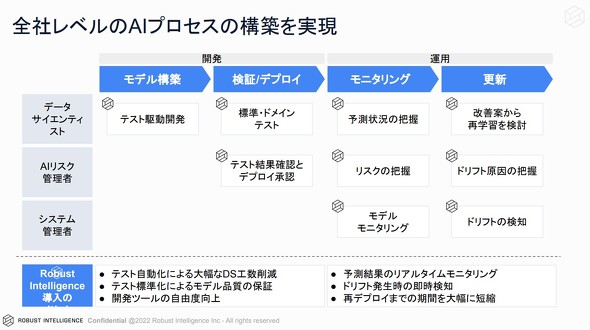

AIのリスクへ対処するためには、AIの開発・運用を担う技術部門だけでなく、リスク管理チームやガバナンス担当部門も巻き込んだ全社的な議論が必須だ。Robust Intelligenceはそれぞれの担当者がAIの状況を随時確認しながら議論を進められるような仕組みを備えていると大柴氏は話す。

「AIが引き起こす問題が、企業の社会的信用に大きな影響を与えることもあります。エンジニアだけに考えさせて責任を負わせるものではなく、本来はガバナンスチームやリーガルチームが主体となって方針を決めるべきです。しかしこうした部署のメンバーはAIについての知識に乏しいため、技術部門との橋渡しをする仕組みが必要とされています」

NECやセブン銀行、東京海上日動も実践、企業が取り組むべき「攻めのAIガバナンス」

米国ではAIリスク管理の重要性に気付いて行動を起こす企業も現れている。既にPayPalやExpedia、アメリカ国防総省といった大組織がRobust Intelligenceの製品を導入してAIリスク管理の取り組みを始めている。

「Expediaのような旅行会社では、AIを使って顧客にお勧めの旅行プランをレコメンドする仕組みを導入していますが、コロナ禍やウクライナ戦争などの非常事態によって急にAIの予測精度が低下するという事態に見舞われました。機能、品質面のリスクを回避するために、私たちの製品のような仕組みを導入してAIリスクに備える企業が米国では急速に増えてきています」(大柴氏)

実際に多くの米国企業の経営層が、SDGsやサイバーセキュリティなどと並んでAIリスクを重要な経営課題の1つとして位置付けている。こうした潮流はやがて日本にも波及するはずだと同氏は力説し、そのためには経営層やマネジメント層の強いコミットメントが必要だという。

「やはり企業の経営層がAIリスクを重要な経営課題として認識し、それにしっかり対処していくという意思を示すことが大事だと思います。それによって、技術部門やガバナンス部門の現場で既に危機意識を持っている一部の人たちがより動きやすくなるはずです」

なお日本国内においても、NECやセブン銀行、NTTデータ、東京海上日動などがいち早く同社の製品を導入してAIリスクへの対処に乗り出しており、業界の裾野も広がっている。

「一例として損害保険業界では、AIリスク管理の重要性が高まっています。 保険の不正請求の自動検知においてもしAIモデルに偏りが生じ、正当な請求であるにもかかわらず不正だと判断してしまうと、サービスの公平性が失われてしまいます。損害保険は重要な社会インフラとしての役割を担っていますから、こうしたミスは絶対に防がなくてはなりません。そのためにはやはりAIリスク管理の取り組みが必須だと言えます」

また人材サービス企業がAIを使って求人情報をユーザーに提供する際、性別や年齢、住所などによって不公平な扱いが生じていないかをチェックするために同社製品を導入しているケースもあるという。こうした倫理的なリスクを含めたAIリスク全般に対する意識は、今後日本においても広く共有されていくだろうと大柴氏は予想する。

「日本は米国と比べてどうしてもリスクに対して及び腰になる傾向があるため、AIリスクを恐れるあまりAIの活用自体に後ろ向きになってしまうような事態を危惧しています。そうではなく、リスクをきちんと管理することでAIを安心して活用できるようになり、結果的に自社の企業価値も向上させることができるということを訴えかけたいですね。そうした『攻めのAIガバナンス』こそが強く求められているのと思います」

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- NEC社長が説く AI時代と新たな安全保障環境の到来で「ITサービスはこう変わる」

- まずは「重要資産の棚卸し」を NISTが示す「個人事業主」レベルの防衛ライン

- Googleが警告する「BlackFile」によるMFA突破と組織的恐荒 従業員を「偽サイト」へ誘導する音声詐欺の全貌

- Anthropic、中小企業用AI業務支援「Claude for Small Business」発表 15種のAIエージェントが作業を肩代わり

- 中小企業の約65%が「情シス不在」 デジタル化でも残る課題との関連は?

- SAPが「自律型エンタープライズ戦略」を始動 AIエージェントが業務を自動実行する時代へ

- Microsoft、Exchange Serverの重要脆弱性を公表 CISAが悪用を確認

- 2027年からの「IT資格大アプデ」は改良か、改悪か?

- アクセンチュアがAnthropicとの協業を国内本格化 Claudeを活用した4つの支援領域とは

- AIエージェントなどを活用している企業の8割が「人減らし」 費用対効果に明暗の理由は?