動き出した「日の丸LLM」プロジェクトの"中身"――日本学術会議の講演から探る:Weekly Memo(2/2 ページ)

研究開発プロジェクトはどんな活動を実施するのか

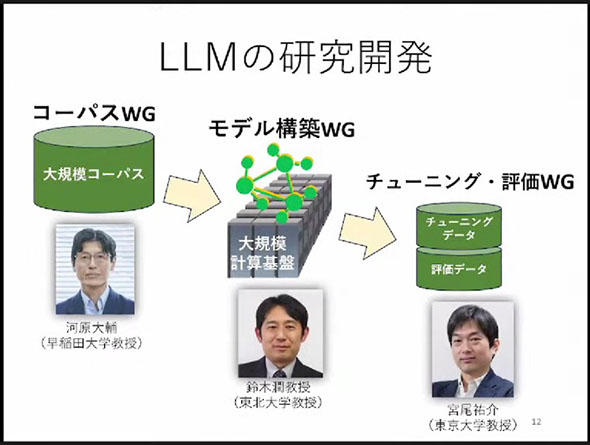

研究開発プロジェクトの具体的な活動としては、「まず、大規模なコーパスを用意する必要がある。それをベースに大規模な計算機資源を使ってLLMを構築する。そして、そのLLMをチューニングして評価する必要がある」(黒橋氏)ことから、その流れにのっとって「コーパスワーキンググループ(WG)」(幹事:早稲田大学の河原大輔教授)、「モデル構築WG」(幹事:東北大学の鈴木潤教授)、「チューニング・評価WG」(幹事:東京大学の宮尾祐介教授)の3つのWGを設置した(図4)。

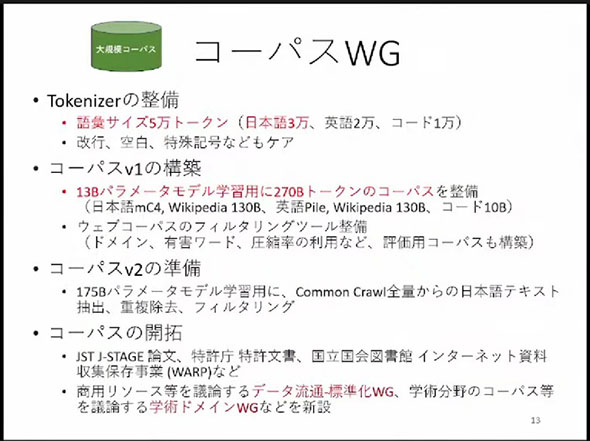

コーパスWGでは、まず文章を最小単位に分ける「Tokenizer」を整備する。黒橋氏によると、「語彙(ごい)サイズは日本語3万、英語2万からなる5万トークンのものを設計する」とのこと。なぜならば、GPTなどの海外モデルは英語が中心なので、日の丸LLMは「日本語力」を前面に押し出すことが最大の差別化ポイントになるからだ。

そして、13Bパラメータモデル学習用に270Bトークンのコーパスを整備した「コーパスv1」を構築する。さらに175Bパラメータモデル学習用に、「Common Crawl」(公開されているWebコーパス)から日本語テキストを抽出し、「コーパスv2」の構築を目指す構えだ(図5)。

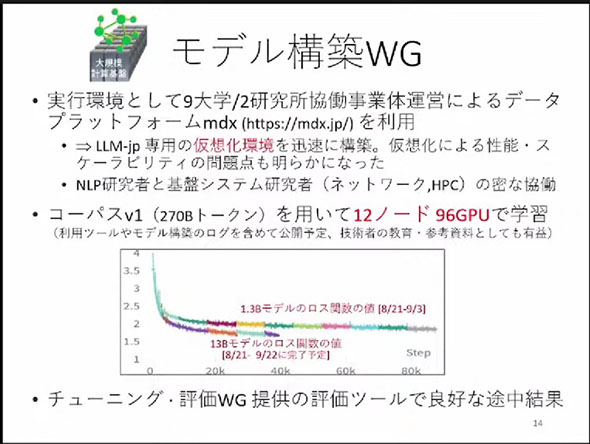

モデル構築WGでは、実行環境として、9大学と2研究所の協働事業体運営によるデータプラットフォーム「mdx」を計算機資源として利用し、LLM-jp専用の仮想化環境を構築した。黒橋氏によると、「現在、コーパスv1を用いて12ノード96GPUで学習している」とのことだ。

モデル構築WGの活動内容を記した図6下段のグラフは、ロス関数の推移を示したものだ。要は、1.3Bモデルに続いて13Bモデルも順調に動いていることを表している。

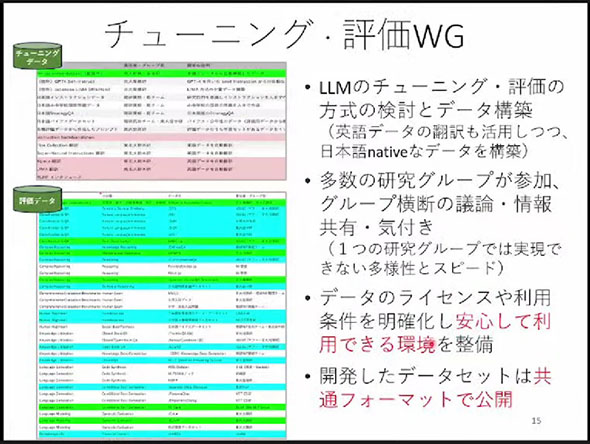

チューニング・評価WGでは、構築したモデルをチューニングして評価する。同WGで作成した評価ツールによると、「現在のところ、良好な結果が得られている」(黒橋氏)とのことだ。

また、同氏は「このWGでは、どんどん賢くなるLLMをどうやって評価するかという難しい問題に対処しなければならない。まずは多様な評価データセットをどうつくるか。多くの研究グループの協力を得ることが重要になる」と述べた(図7)。

最後に、黒橋氏は次のように語った。

「LLMの賢さやこれからの進化は、今後の人類の知の基盤になり得る。LLMの研究開発は、もはやビッグサイエンスだ。LLM-jpはそれに取り組むオープンな基盤として貢献していきたい。2023年度中に開発予定の175Bモデルをベースに、LLMに関するさまざまな課題や多様な分野での活用に取り組みたい」

まさに、日の丸LLMの研究開発への決意表明とも受け取れる発言だ。175Bモデルは先述にあるように、GPT-3と同等レベルだ。その日本語の理解や生成能力はどれほどのものになるか。できれば、一般にも試せるようにしていただきたい。黒橋氏が懸念として述べたように、「日本版LLM」を日本として保持することは非常に重要だと筆者も考える。その意味でも大いに注目していきたい。

著者紹介:ジャーナリスト 松岡 功

フリージャーナリストとして「ビジネス」「マネジメント」「IT/デジタル」の3分野をテーマに、複数のメディアで多様な見方を提供する記事を執筆している。電波新聞社、日刊工業新聞社などで記者およびITビジネス系月刊誌編集長を歴任後、フリーに。主な著書に『サン・マイクロシステムズの戦略』(日刊工業新聞社、共著)、『新企業集団・NECグループ』(日本実業出版社)、『NTTドコモ リアルタイム・マネジメントへの挑戦』(日刊工業新聞社、共著)など。1957年8月生まれ、大阪府出身

関連記事

- 「Weekly Memo」記事一覧

AIによる「意思決定の自動化」は“正しいこと”なのか? IBMの最新調査から考察

AIによる「意思決定の自動化」は“正しいこと”なのか? IBMの最新調査から考察

生成AIを活用する最大のリスクは「人間が行う意思決定を委ねてしまうこと」ではないか。筆者がかねて抱いてきたこの懸念を、IBMの最新調査結果とともに考察したい。 アクセンチュアの提言から考察する 「どうすれば生成AIをうまく使いこなせるか」

アクセンチュアの提言から考察する 「どうすれば生成AIをうまく使いこなせるか」

生成AIはどうすればうまく使いこなせるようになるのか。アクセンチュアの年次調査レポートから探る。 商用利用可能な70億パラメーターの日本語LLMをELYZAが公開 性能はGPT-3.5に匹敵

商用利用可能な70億パラメーターの日本語LLMをELYZAが公開 性能はGPT-3.5に匹敵

ELYZAはMetaのLlama 2をベースにした新しい日本語の大規模言語モデルを開発した。性能はGPT-3.5に匹敵するとされており、研究および商用利用が可能となっている。 Microsoft、生成AIによる知的財産権侵害での法的リスクを負担する新方針を発表

Microsoft、生成AIによる知的財産権侵害での法的リスクを負担する新方針を発表

Microsoftは生成AIの出力に関する知的財産権侵害での法的リスクを負うとする「Copilot Copyright Commitment」を発表した。

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- シャドーITのリスクは「こう変わった」 “悪意なき情報漏えい”にどう立ち向かう?

- NEC社長が説く AI時代と新たな安全保障環境の到来で「ITサービスはこう変わる」

- Google検索、25年ぶりの大刷新 「ググる」から「AIエージェントに任せる」へ

- 2027年からの「IT資格大アプデ」は改良か、改悪か?

- まずは「重要資産の棚卸し」を NISTが示す「個人事業主」レベルの防衛ライン

- 「AIでAIと戦う」時代の幕開け Google CloudとWizが目指す自律防御の世界

- なぜ高度なAIを導入しても成果が出ない? 日本企業が陥る「デジタルフリクション」の罠

- 「AI活用をDXの二の舞にしない」 ガートナーが語る、企業が真のイノベーションを起こす方法

- Dellが「Deskside Agentic AI」発表 エージェント型AIをローカルで実現

- 2026年の世界AI支出は47%増の2.6兆ドルへ――インフラ主導から「企業の本格導入」への転換を予測 Gartner調査