「期待外れ」の生成AI活用、オンプレLLMが突破口になり得るワケ 課題とコツを整理する:Enterprise IT Summit 2025秋 イベントレポート

日本企業の生成AI活用が「期待外れ」に終わる理由とは。製造業特化型AIを手掛ける専門家が、セキュリティの壁を突破するオンプレミス活用の勘所を解説。

この記事は会員限定です。会員登録すると全てご覧いただけます。

製造業向けに特化したAI開発を手掛けるエムニのCEO(最高経営責任者)を務める下野祐太氏によれば、日本では生成AI活用一定進んでいるものの、期待以上の成果を得ている企業は他国と比較して少ないという。本稿では、日本企業の生成AI活用が期待以上の成果を生み出せない理由と、その対策としてのオンプレミスの重要性について解説する。

本稿は、アイティメディアが主催したオンラインセミナー「Enterprise IT Summit 2025秋」(2025年11月17日〜20日)の講演「データ利活用を実現するためのデータマネジメント」の内容を編集部で再構成したものです。

生成AIが期待以上の成果を生まない理由

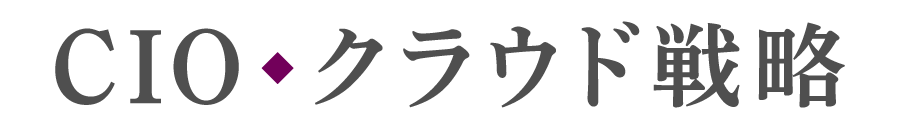

下野氏が紹介したデータによると、日本は生成AIを活用している企業の割合こそ平均的な水準にあるものの、生成AIを活用して期待以上の効果を得た企業の割合は他国を下回るという。米国および英国はそれぞれ51%、50%の企業が期待を上回る効果を実現している。ドイツで28%、中国で24%となっているが、日本は13%しか期待以上の効果を得られていない。

その理由について下野氏は「最も重要なユースケースの設定が現場ベースでできていないためだ」と語った。日本は生成AIを全社活用しているのに対し、米国は経営やコーポレートなどの特定業務に特化した具体的なユースケースを設定している。

「つまり、現場に根ざした具体的なユースケースが定められていないため、生成AI活用が業務効率化に終始してしまっている。米国で重要視されている顧客価値向上にアプローチできていない」(下野氏)

下野氏は製造業向けのAI開発を支援する中で、生成AI活用のハードルを実感したという。同氏は「セキュリティやプライバシーの問題が生成AI活用の障壁となっている。ユースケースを絞った上で、セキュリティを確保する体制まで構築しなければならない」と強調した。

“オンプレLLM”開発の課題とコツ

OpenAIの「GPT」シリーズやGoogleの「Gemini」など、高性能なAIモデルの多くがクラウドで提供されているため、企業における生成AI活用の主戦場はクラウドとなっている。一方、工場など重要なデータを保管している事業所で生成AIを活用しようとすると、機密データの漏えいを防ぐ必要があるためクラウドを利用しにくい。

この課題を解決するために下野氏が「重要なソリューション」と位置付けたのがオンプレミスだ。しかし、オンプレミスでの生成AI活用にも幾つかの課題がある。同氏が挙げたのは以下の3点だ。

LLMの種類が限定される

オンプレミスでは使用できる大規模言語モデル(LLM)の種類が限定される。オンプレミスで使用できるモデルは、オープンソースまたはオープンウェイトのモデルで、「フロンティアモデル」と呼ばれる最先端のモデルと比較すると性能が落ちる場合が多い。昨今はオープンモデルでも性能や安定性が向上しており、今後の発展が期待されているという。

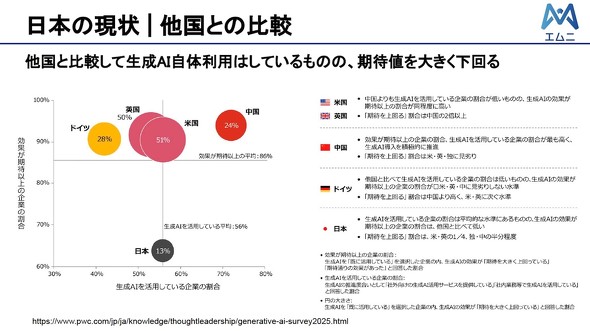

下野氏はオープンモデルにRAG(検索拡張生成)やファインチューニングを組み合わせることで精度は改善できると述べた。また、プロンプトの分量とコストが比例しにくいというオンプレミスの特徴を生かし、長文プロンプトで精度を高める選択肢もあるという。

「特許に関する翻訳に特化したLLMをオンプレミスで開発した際は、ファインチューニングによって他社の汎用(はんよう)モデルや翻訳モデルを超える精度を実現できた」(下野氏)

下野氏によると、ファインチューニングは詳細な知識の取得には向かないが、翻訳のような言葉の概念の理解は得意だという。このように、その技術がどのような用途に適しているかを理解しておくことで、モデルの選択肢が限られていても対処しやすい。

前処理の複雑さ

AIに参照させるデータの前処理が複雑になりやすい点も、オンプレミスでLLMを使う際の課題だ。下野氏によれば、あるチャットbot開発においては、生成AIに入力する文章をLLMが分かりやすい形に変換したり、入力した内容を再構成したり、検索方法を改善したりして、精度改善に取り組んだという。

クラウドサービスの中にはこれらの前処理を半自動的に実行してくれるものもあるが、オンプレミスでは前処理の精度を高める知見が必要になる。

一方、下野氏は次のようにも語り、オンプレミスでは手間がかかる代わりに柔軟性が手に入るというメリットを強調した。

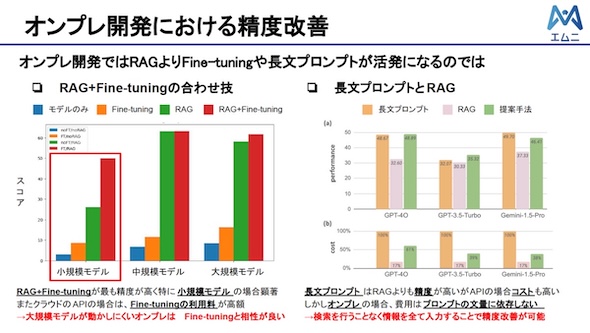

「オンプレミスでは前処理の精度を高めるために工数がかかるが、これは前処理に関連する工程の柔軟性が高いという意味でもある。例えば、AI-OCRと画像処理技術を活用して、図表や図面から必要な情報を抽出して、検索や回答の際に柔軟に参照させることも可能だ」

大規模利用の難しさと運用保守のコスト

オンプレミスの環境構築にはハードウェアが必要なため、大規模に運用しようとすると、PCやサーバの調達個数を検討する必要がある。現場での運用保守業務も必要になりコストがかかりやすい。

クラウドはそのようなイニシャルコストがかかりにくい代わりに、ランニングコストがかさみがちだ。クラウドで開発するか、オンプレミスで開発するかはユースケースに応じて設定する必要があると下野氏は指摘する。

「クラウドを選ぶべきか、オンプレ開発を選ぶべきかは具体的なユースケースに従って決めるべきだ。イニシャルコストのみならず、ランニングコストもふまえてユースケースを想定してほしい」

生産現場における生成AIのキラーケース

下野氏によると、製造業の生産現場において生成AI活用によるインパクトが最も大きいユースケースは「暗黙知の言語化と技能伝承」だという。

生産現場においてこれらが十分になされていない理由は、個人の思考を整理する難しさにある。例えば、熟練の従業員に「勘やコツを教えてください」と質問しても満足な回答は得られないだろう。これはそもそも質問の論点が絞られておらず、回答が難しいからだ。

暗黙知を言語化できたとしても、そのナレッジを管理するのが難しいという課題もある。ナレッジが大量かつ複雑になると、欲しい情報がどこにあるか分からなくなるケースも多い。同じ事業であっても条件や対処方法の違いにより、従業員それぞれで業務の進め方が異なり、統一されたナレッジの確立が難しい場合もある。

多くの生産現場に共通するこれらの課題を解決する際、生成AIは大きな可能性を秘めていると下野氏は語る。エムニの「AIインタビュアー」のようなサービスを使い、AIが人に適切な質問を投げかけることで、熟練の従業員のナレッジを効果的に蓄積できるという。

企業における生成AI活用が広がり始めてから数年がたったが、実際に使ってみて「期待外れ」と感じている人もいるだろう。その原因は、下野氏が指摘するように「具体的なユースケースが設定されていない」ためかもしれない。まずは自社の業務フローを整理し、どの部分に生成AIによる効率化の余地があるか検討する必要がある。そのための手段として、オンプレミスが候補に挙がった際は本稿の内容を参考にしてほしい。

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- システムが守っても「あなた」が壊す? パスワード管理の盲点を突く手口

- 「AIを使えば全員同じになる」 羽生善治九段が語るAI時代の差別化と意思決定

- AI時代のSIerの「勝ち筋」とは? 富士ソフトが新体制を始動

- 「Windows+R」は絶対に押さないで! 新入社員に贈るセキュリティの新常識5選

- アクセンチュアとSAP、AIを前提とした基幹システム刷新プログラムを本格展開へ

- AIエージェントを活用する中堅・中小は何を使っている? 先進企業が「手放さないツール」【調査】

- AI活用で足らないのは「ビジョン」や「熱量」じゃない 経営層と現場で拡大する“ズレの正体”

- Geminiアプリで直接ファイル生成・エクスポート可能に コピペの手間を省き作業をシームレス化

- 情シスがいきいきと働くためにやるべきこととは? リアルな「お悩み」に回答

- やはりClaude Codeの品質は下がっていた Anthropicが調査し特定した3つの要因