入力ミスによる情報流出を未然防止 Microsoft、Copilot入力文の保護機能を提供開始:セキュリティニュースアラート

Microsoftは、「Microsoft 365 Copilot」のプロンプト入力時に機密情報をリアルタイム検知し、処理を停止する機能の一般提供を開始した。社内情報の利便性を保ちつつ、外部検索やAI処理による漏えいを防ぐ。

この記事は会員限定です。会員登録すると全てご覧いただけます。

Microsoftは2026年4月21日(現地時間)、「Microsoft 365 Copilot」における機密データ保護機能として、入力プロンプトに対する情報漏えい対策(DLP)機能の一般提供を開始したと発表した。「Microsoft 365 Copilot」および「Copilot Chat」の全ユーザーに追加費用なしで提供する。

入力したテキストを処理前に評価し「うっかりミス」防ぐ 設定方法は?

生成AIの業務利用が拡大し、ユーザーは文書要約や分析、資料作成などを自然言語で指示できるようになった。他方で、入力内容に機密情報が含まれる場合の取り扱いが課題となっていた。今回の機能は、こうしたリスクに対処するため、ユーザーが入力したテキストを処理前に評価し、機密情報が含まれているかどうかに応じて処理を制御する点に特徴がある。

Microsoftはこれまで約2年間にわたり、Copilot用のDLP機能を段階的に拡充してきた。2024年11月には、機密ラベルに基づきファイルやメールをCopilotの処理対象から除外する仕組みを導入。機密情報を含む入力に対し、社内データの参照は維持しつつ外部Web検索のみを禁止する機能も公開プレビューとして提供している。

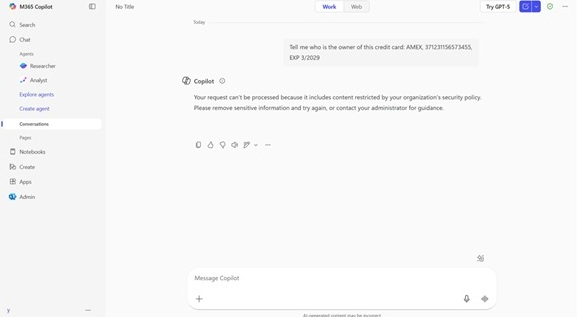

今回一般提供となった機能は、これらの取り組みを補完するもので、入力プロンプトそのものをリアルタイムで検査する。検出には「Microsoft Purview」の分類・検出エンジンが使われ、クレジットカード番号や社会保障番号などの標準定義に加え、企業独自のキーワードやコードネームなども対象とできる。該当情報が検出された場合、Copilotは処理を停止し、「Microsoft Graph」やWebを利用した情報参照や外部検索処理も実行されない。ユーザーには、ポリシーによって要求に対応できない旨が通知される。

この仕組みで、AI利用時の情報漏えいや過剰共有を防止できる。金融分野では取引条件や口座情報の流出防止、医療分野では患者情報の保護、製造業では知的財産や機密設計情報の保全など、幅広い用途が想定されている。企業内で進行中の非公開案件に関しても、プロジェクト名を条件として設定することで、関連情報の外部露出を抑制できる。

導入は、Microsoft PurviewのData Security Posture Management(DSPM)ポータルからのガイド付き設定で簡単に適用できる。推奨ポリシーはワンクリックで適用可能で、初期状態ではシミュレーションモードで動作し、実際の影響を確認した後に本格適用できる。また管理者はDLPポータルやMicrosoft 365管理センターからの設定も可能だ。

運用面においては、ポリシー違反が発生した際の通知やアラートがMicrosoft PurviewおよびMicrosoft Defenderポータルに表示される。これによって、どのポリシーが適用されたか、どの種類の機密情報が検出されたか、どのような操作が試みられたかといった詳細を把握できる。管理者はこれらの情報を基に調査・ルール調整し、継続的にセキュリティ体制を最適化できる。

Microsoftは今回の機能について、安全なCopilot活用を支える重要な強化策と位置付けている。AIの利便性を維持しつつ、企業のコンプライアンス要件やデータ保護要件に対応することで、業務への導入を後押しする狙いがある。同社は今後もCopilotの進化に併せて保護機能を拡充し、AI活用とセキュリティの両立を推進するとしている。

関連記事

自社のAIが攻撃者のアシスタントに? 「LLM Jacking」の深刻なリスク

自社のAIが攻撃者のアシスタントに? 「LLM Jacking」の深刻なリスク

攻撃トレンドが“侵入からログイン”へ移行する中、企業のAIリソースを乗っ取って悪用する「LLM Jacking」の脅威が拡大しています。単なる高額な利用料の発生にとどまらず、侵入先のRAG環境などを悪用して「企業の機密情報を効率的に分析・奪取」する、AI時代の新たな攻撃実態とその深刻なリスクを解説します。 AI規格「MCP」に構造的欠陥? セキュリティ企業が指摘するもAnthropicは修正否定

AI規格「MCP」に構造的欠陥? セキュリティ企業が指摘するもAnthropicは修正否定

OX Securityは、Anthropicが策定する規格「MCP」に設計起因の欠陥があると発表した。任意コマンド実行によってデータ流出の恐れがあり、脆弱なインスタンスは最大20万規模に及ぶと推計されている。各製品で修正が進んでいるが、規格レベルの課題が残存している。 Microsoftが4月の月例更新を公開 過去2番目規模の160件超の脆弱性を修正

Microsoftが4月の月例更新を公開 過去2番目規模の160件超の脆弱性を修正

Microsoftは、月例セキュリティ更新で160件超の脆弱性を修正した。8件が重大、2件がゼロデイ脆弱性で、SharePointのなりすましやDefenderの権限昇格を含む。攻撃確認済みの問題もあり、迅速な更新適用が必要だ。 Windowsのリモートデスクトップ接続が刷新 情報の自動共有は「原則禁止」に

Windowsのリモートデスクトップ接続が刷新 情報の自動共有は「原則禁止」に

Microsoftは2026年4月の更新でRDPファイル起動時の警告を強化し、接続前に送信元や共有設定を確認させる仕組みを導入した。不審なファイル経由の接続や情報漏えいの危険を示し、利用者に慎重な判断と確認行動を求めている。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- マクロを使わずにExcelを自動化 ゼロから分かる「パワーピボット」超入門

- Microsoft 365 Copilotが新デザインを発表 ExcelでCopilot利用率が33%増加

- Microsoft「Build 2026」発表まとめ 開発基盤の拡充から安全対策、ハードウェアまで

- 知らない番号からの着信、出る前に見抜く 話題の警察庁推奨アプリを試してみた

- AIによるコード生成、3年後は3倍超に AI普及で浮上する課題は

- 「会話がスマホに盗聴されている」の真相 スマホセキュリティで守るべきルールとは?

- 「業務の前提そのもの」をどうアップデートする? IBMが説く「AXの要件」を考察

- なぜ本番環境のAIは失敗するのか? Datadog調査で判明した「運用の壁」と打開策

- コンサルの品質、なぜ「バラつく」のか? ガートナーが背景を解説

- Claudeが驚異の1100%成長でシェア17%に急拡大、急落するCopilot――米生成AIアプリ市場動向調査