Microsoftのイベントと「AI PC」で一気に上昇する要求スペック 大きく変化するAI PC時代のPC選び:Windowsフロントライン(2/4 ページ)

Microsoftのスペシャルイベントが開催目前に迫っている。次世代のSnapdragon搭載PCを始めとして、“AI PC”の新たな姿が提示されるだろう。

スペシャルイベントでは何が発表されるのか

Microsoftが出資を行い、実質的にAI方面でのメインパートナーとして機能しているOpenAIだが、5月13日(米国時間)に「GPT-4o」を発表している。カメラ映像を介してのマルチモーダルの処理強化に加え、従来のGPTに比べ処理速度が2倍になったことでレスポンスが向上しており、より自然な形で対話が可能になっているのが特徴だ。

現在、MicrosoftではこのGPTのベースになっている大規模言語モデル(LLM)を応用して同社製品群のインタフェースを強化する「Copilot」の名称が付くサービスを水平展開しており、この波はWindowsにも到来しつつある。当然ながら、次世代Windowsもまたこの動きとは無縁ではない。

イベントではMicrosoftの最新の「AI」への取り組みについて言及が行われると思われるが、その一部はWindows上で展開され、実際にデモンストレーションを交えて披露されるだろう。

実際に搭載が見込まれる機能についてWindows Centralのザック・ボーデン氏が言及しているが、「AI Explorer」「Windows Studio Effects」「Live Captions」については各方面の報道でもたびたび触れられている。

AI Explorerは説明を聞く限り、既に廃止されている「タイムライン」のAI版のような機能で、過去の作業記録を自然言語による対話で再現できるというものだ。該当する機能は「Recall」と呼ばれているが、従来との違いはNPUとLLMを利用する点で、インタフェース的にはCopilotの一種に近いものと考えられる。

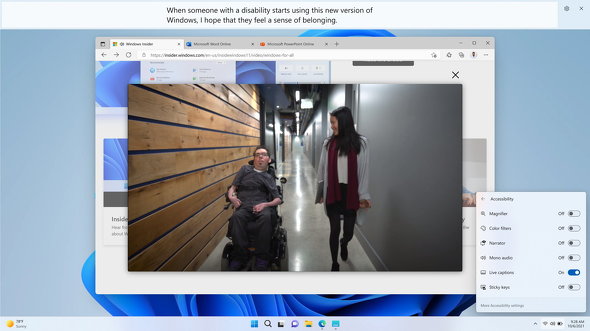

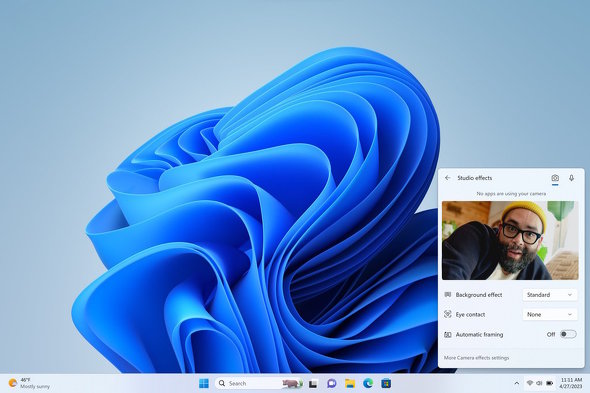

Windows Studio Effectsについては既存機能の強化版で、背景の入れ替えのみならず、人物画像の最適化などをリアルタイムで施せる。Live Captionsについては、Windows上で再生されている音声に対してリアルタイムで好みの言語のキャプションを表示させることができる。アクセシビリティー機能であると同時に、リアルタイム翻訳も担っている。

だがおそらく、このイベントでの最も大きなトピックとなるのは「ローカルLLM」だろう。特に生成AI(Generative AI)を“オンデバイス”で動作させる仕組みとなる。現状でもPC上でLLMを動作させることは可能だが、大きく2つのボトルネックが存在する。

一般に、LLMにおける性能の優劣の指標の1つにパラメーター数があり、パラメーター数が多いほど複雑な(より多様な)処理が可能になるとされている。これに学習データ量(トークン)などの要素が加わることで、対応可能な受け答えの幅が広がることになる。

これら数値が大きいほど“優秀”なLLMと言えるかもしれないが、難しいのは学習データ量が増えるほどLLM(モデル)のサイズが大きくなり、パラメーターが増えるとその処理のために高速なプロセッサやデータを展開するための“メモリ”が必要になるというワナがある。

それゆえ「でかけりゃいいもんじゃない」という図式があり、実際に公開されているLLMも用途に応じて複数の学習データ量やパラメーター数のモデルが用意され、実行環境に合わせて最適なものを選ぶことが重要になる。

例えば1年半前に登場して話題となったChatGPTだが、ベースとなったGPT-3.5のパラメーター数は1750億、つまり「175B」だと公表されている(BはBillionの略)。細かい部分は省略するが、LLMを「推論」で実行する場合に要求されるメモリは最低でも「○○B」で表現されるパラメーター数の「○○」の部分の1〜1.2倍程度の「○○GB」のメモリが必要で、「学習」を行う場合はさらに10倍程度のメモリが必要になるとされている。

比較的優秀で大規模なローカルLLMでは70Bや130Bといったパラメーターが設定されているが、それぞれ80GBや150GB程度のメモリが最低限必要ということになる。加えて、これらを高速で処理するための「プロセッサ」と「メモリ」が必要となるわけで、この条件を満たせなければレスポンスが“非常に遅い”LLMとなってしまい、実用に耐えないというわけだ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

ASUSが「新しいAI PC」を5月21日午前3時(日本時間)に発表 Snapdragon X搭載?

ASUSが「新しいAI PC」を5月21日午前3時(日本時間)に発表 Snapdragon X搭載?

ASUSTeK Computerが、5月21日午前3時(日本時間)に「新しいAI PC」を発表する。発表会の登壇者など、分かっている情報を総合すると「Snapdragon Xシリーズを搭載するVivobook S 15」が登場する可能性がある。 QualcommがPC向けハイエンドSoC「Snapdragon X Elite」を発表 CPUもGPUもNPUも高速なのに省電力

QualcommがPC向けハイエンドSoC「Snapdragon X Elite」を発表 CPUもGPUもNPUも高速なのに省電力

Qualcommが、ノートPC向けの新型SoCを発表した。従来モデルから大幅にパフォーマンスを引き上げ、x86ベースのノートPC向けCPUにも劣らないどころか上回るパフォーマンスを手に入れたという。 「M4チップ」と「第10世代iPad」こそがAppleスペシャルイベントの真のスターかもしれない

「M4チップ」と「第10世代iPad」こそがAppleスペシャルイベントの真のスターかもしれない

Appleのスペシャルイベントで華々しく登場した新しいiPad Pro/iPad Airシリーズだが、注目ポイントは他にあると林信行氏は語る。その心は? 使って分かったM4チップ搭載「iPad Pro」のパワフルさ 処理性能とApple Pencil Pro/Ultra Retina XDRディスプレイ/新Magic Keyboardを冷静に評価する

使って分かったM4チップ搭載「iPad Pro」のパワフルさ 処理性能とApple Pencil Pro/Ultra Retina XDRディスプレイ/新Magic Keyboardを冷静に評価する

Appleが5月15日に発売する新しい「iPad Pro」は、想像以上にパワフルだ。しかし、用途によっては「iPad Air」でもいいかもしれない――iPad Proを中心に、実機に触れつつレビューしていこう。 M4チップ登場! 初代iPad Proの10倍、前世代比でも最大4倍速くなったApple Silicon

M4チップ登場! 初代iPad Proの10倍、前世代比でも最大4倍速くなったApple Silicon

Appleが、スペシャルイベントにて新型Apple SiliconのM4を発表、同時にM4搭載iPad Pro2モデルを5月15日から発売する。