4割超が生成AI利用で「ヒヤリ」経験あり 何が起きた?

業務での生成AI活用には、不安の声も寄せられている。実際にどんなリスクやトラブルが発生しているのか。不正検知サービスやサイバーセキュリティサービスを開発・提供するChillStack(東京都渋谷区)が調査を実施した。

4割が生成AI利用で「ヒヤリ」経験あり

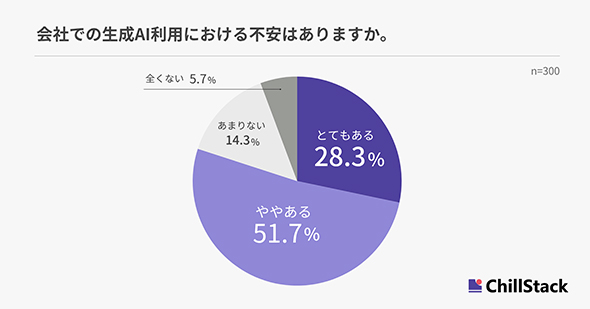

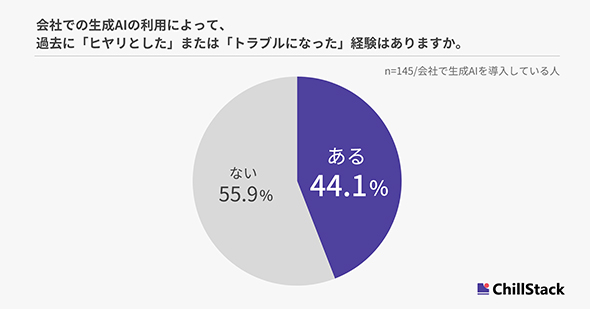

会社での生成AI利用について、80.0%が「不安がある」という結果に(「とてもある」28.3%、「ややある」51.7%の計)。また、会社での生成AIの利用において、過去に「ヒヤリとした」または「トラブルになった」経験がある人は44.1%だった。

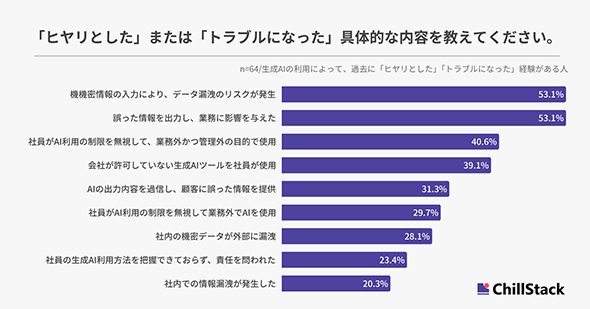

「ヒヤリとした」または「トラブルになった」具体的な内容では、「機密情報の入力により、データ漏えいのリスクが発生」「誤った情報を出力し、業務に影響を与えた」(各53.1%)、「社員がAI利用の制限を無視して、業務外かつ管轄外の目的で使用」(40.6%)が上位を占めた。

生成AIの業務利用でリスクだと感じることは?

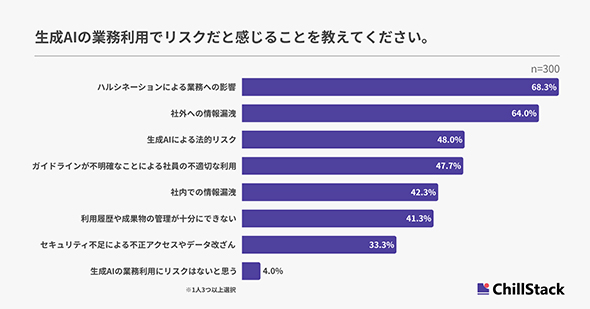

生成AIの業務利用でリスクだと感じること1位は「AIが誤った情報や不正確なデータを生成するハルシネーションによる業務への影響」(68.3%)だった。以下「社外への情報漏えい」(64.0%)、「生成AIによる法的リスク」(48.0%)と続いた。

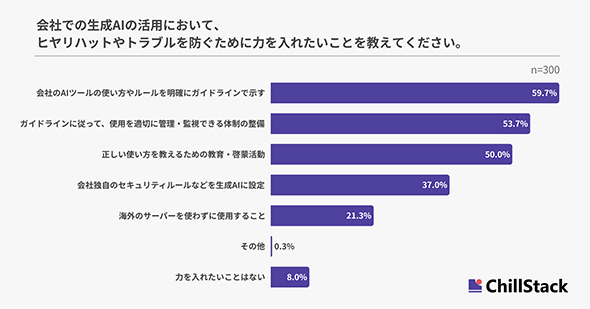

生成AIのリスク防止策は?

生成AIのリスク防止策では、「会社のAIツールの使い方やルールを明確にガイドラインで示す」(59.7%)が最も多かった。その他、「ガイドラインに従って、使用を適切に管理・監視できる体制の整備」(53.7%)、「正しい使い方を教えるための教育・啓蒙活動」(50.0%)といった声が寄せられた。

調査は5月20日、企業の情報システム部門に所属し、生成AIの導入または導入検討を行っている担当者、生成AIの導入に興味がある300人にインターネットで実施した。

関連記事

生成AIに「プロンプトは必要ない!」 日本マイクロソフト役員が断言するワケ

生成AIに「プロンプトは必要ない!」 日本マイクロソフト役員が断言するワケ

「プロンプトは必要ない」――生成AI活用に必要なプロンプトについて、日本マイクロソフトの業務執行役員でエバンジェリストの西脇資哲氏はこう断言した。西脇氏が考える生成AIの正しい活用法とは。 生成AI時代の「学び」とは? サイバー大学が挑む「教育とテクノロジー」の融合

生成AI時代の「学び」とは? サイバー大学が挑む「教育とテクノロジー」の融合

生成AIの波は教育現場にも押し寄せ、従来の学びの在り方を変えようとしている。生成AIと教育の未来を見据えたサイバー大学の取り組みを、川原洋学長に聞いた。 「アシスタント→漫画家」は時代遅れ? 生成AIは漫画業界で働く“人”の役割をどう変えるのか

「アシスタント→漫画家」は時代遅れ? 生成AIは漫画業界で働く“人”の役割をどう変えるのか

かつて斜陽産業とも呼ばれた漫画は現在、デジタル化で再成長を遂げている。その背景に、生成AIの存在がある。生成AIの登場で、アシスタントや漫画家の仕事はなくなってしまうのだろうか……? 三菱電機「Serendie」の生成AI活用 「DX人材2万人体制」の狙いは?

三菱電機「Serendie」の生成AI活用 「DX人材2万人体制」の狙いは?

三菱電機は独自のデジタル基盤「Serendie」(セレンディ)を軸に、2030年度までにDX人材2万人体制を目指している。三菱電機がDX人材とAI活用を強化する狙いは? 同社執行役員で、DXイノベーションセンターの朝日宣雄センター長に聞いた。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR注目記事ランキング