ディープラーニングのGUI開発で産総研ABCIのGPUを利用可能に――ソニーと産総研が連携サービス、AI開発促進へ

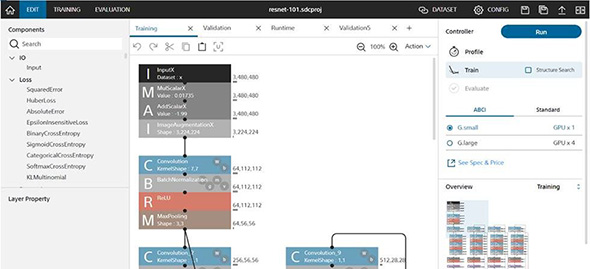

ソニーは、ディープラーニングの統合開発環境「Neural Network Console Cloud」のアップデートとして、産総研のAI処理向けスパコン「ABCI」との連携を発表。ニューラルネットワークの学習・評価に用いる計算リソースとして、ABCIのGPUを選択できるようになった。

この記事は会員限定です。会員登録すると全てご覧いただけます。

ソニーとソニーネットワークコミュニケーションズは2019年4月8日、ディープラーニング(深層学習)の統合開発環境「コンソールソフトウェア:Neural Network Console」のクラウドサービスで、産業技術総合研究所(産総研)のスーパーコンピュータシステム「AI橋渡しクラウド(AI Bridging Cloud Infrastructure:ABCI)」との連携による新サービスの提供を開始した。

ソニーは2017年6月に、ディープラーニング開発用のコアライブラリ「Neural Network Libraries」をオープンソース化し、同年8月にNeural Network Consoleの無償提供を開始。2018年5月からは、マルチGPUによる高速学習が可能なクラウド版「Neural Network Console Cloud」の提供を開始した。

Neural Network Consoleは、GUIベースの直観的な操作でニューラルネットワークの設計、学習、評価ができる統合開発環境。マウス操作とパラメーターの調整だけで、ディープラーニングプログラムを生成できる。クラウド版では、CPU、マルチGPU、最大1TBまでのワークスペース、無制限のプロジェクト数などのディープラーニング実行環境が提供されている。

ABCIは、産総研が構築、運用する世界最大規模の人工知能(AI)処理向け計算インフラストラクチャ。国内における産学官共同AI研究開発のオープンプラットフォームとして、2018年8月に本格運用を開始した。ABCIの中核となる高性能計算システムは、AI処理に適した半精度演算性能が550PFLOPS(ペタフロップス)、倍精度演算性能が37PFLOPSで、実運用される計算システムとしては国内最高性能を記録。NVIDIAのGPU「NVIDIA TESLA V100」をノード当たり4基、計4352基搭載し、この性能を実現している。

関連記事

“JAXAの高精細衛星データ×産総研のスパコン「ABCI」”で衛星データを高速解析するAI技術開発へ

“JAXAの高精細衛星データ×産総研のスパコン「ABCI」”で衛星データを高速解析するAI技術開発へ

宇宙航空研究開発機構(JAXA)と産業技術総合研究所(産総研)は、衛星データをAIで高速解析する技術の研究開発を開始。産総研のAI処理向けクラウド型スパコン「ABCI」を用いて、JAXAの衛星データを高速かつ高精度に自動解析する技術を開発する。 AIのビジネス活用を実践的に学べる、社会人・大学生向け「NEC アカデミー for AI」 2019年4月に開講

AIのビジネス活用を実践的に学べる、社会人・大学生向け「NEC アカデミー for AI」 2019年4月に開講

NECは、社会課題を解決するAI人材を育成する「NEC アカデミー for AI」を2019年4月に開講する。AIのビジネス活用を実践的に学ぶ「入学コース」と、AI人材に必要なスキルや知識を習得できる「オープンコース」を用意する。 Microsoftが「AIビジネススクール」開校 AIの“戦略・文化・責任”についてのオンライン授業を無料で提供

Microsoftが「AIビジネススクール」開校 AIの“戦略・文化・責任”についてのオンライン授業を無料で提供

Microsoftは、ビジネスリーダー向けに、AIのビジネス活用をリードするための知恵やノウハウを無料で学べる「Microsoft AI Business School」を開校。ケーススタディーや講義のビデオなどを通して、AI戦略の定義、AIに対応する企業文化の実現、“責任あるAI”などを学習できる。 DXの“現実解”を求める企業が急増――IDC、2019年の国内IT市場の主要10項目を予測

DXの“現実解”を求める企業が急増――IDC、2019年の国内IT市場の主要10項目を予測

2019年は、DXの“現実的な解”を求める企業が急増し、既存業務プロセスの効率性追求などの取り組みが増えるという。一方、対話型AIやスマートフォン接続型のAR/VRヘッドセットのビジネス用途が広がるなど、DXを推進する新たなイノベーションアクセラレーターの活用が進む見通しだ。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- 「AIを使えば全員同じになる」 羽生善治九段が語るAI時代の差別化と意思決定

- やはりClaude Codeの品質は下がっていた Anthropicが調査し特定した3つの要因

- 「日本のDXは期待外れ」が64% 世界平均を大きく上回るとGartnerが警告

- Anthropicの新指標 AIの影響を受けにくい「3割の人々」の共通点は?

- NECが人材育成サービスを刷新 「今後必要とされる人材像」を再定義した背景

- 「Windows+R」は絶対に押さないで! 新入社員に贈るセキュリティの新常識5選

- AI活用で足らないのは「ビジョン」や「熱量」じゃない 経営層と現場で拡大する“ズレの正体”

- Windowsのリモートデスクトップ接続が刷新 情報の自動共有は「原則禁止」に

- NTTデータが「商品企画AI」を発表 社内データを基に150秒でコンセプト生成

- メインフレーム「IBM Z」は51%増、全事業セグメントが増収 IBMが2026年Q1決算を発表