社内に生成AIがやって来た! 何に怖がるのが「正解」か:誌上シミュレーション:生成AIが社内にやってきた その時、何が起こるか(1)

この連載では、企業の中で生成AIを活用する際にあらかじめケアしておくべき点について、Box Japanの武田新之助が解説します。

生成AIの導入効果に関しては、さまざまな調査や報告、事例がちまたにあふれています。生成AIさえ導入すれば、業務効率化が劇的に向上し、生産性が向上する――。そう思われている方も結構いらっしゃるのではないでしょうか。

2025年は、企業が生成AIの導入と活用に本腰を入れ始める年といわれています。皆さんの会社でも、導入検討を本格的に始めたり、PoC(概念実証)から本番への移行を計画したりしているかもしれません。

でも、ちょっと立ち止まって考えてみた方がいいことがあります。

現在のIT環境のまま生成AIを導入すると、最悪の事態が起こりうる懸念があります。この連載は、企業の中で生成AIを活用する際にあらかじめケアしておくべき点について解説します。

筆者紹介:武田 新之助(たけだ しんのすけ)

Box Japan プロダクトマーケティング部 シニアプロダクトマーケティングマネージャー

20年以上にわたり、銀行の情報システム部門や日系SIerのプリセールスエンジニア、外資系ベンダーのアーキテクトとして活躍。特にコラボレーション・コミュニケーション領域において幅広い知識と豊富な経験を有する。

日本マイクロソフトを経て2023年にBox Japanに移籍。プロダクトマーケティングマネージャーとして製品の市場投入やメッセージングをリードするともに、さまざまなイベント、セミナーで講演し製品価値を訴求。

生成AI普及は「不安」? 私たちは何に怖がるのが「正解」か

2022年11月のChatGPT公開で一気に知名度が高まった生成AIですが、企業が業務で使う場合には、インターネット上の情報を基に回答する一般向けの生成AIではなく、自社内のデータを基に回答する、企業向けの生成AIを使う必要があります。インフラを用意して自社構築する企業もありますが、時間とコストがかかります。クラウドサービスとして機能を提供している事業者も複数ありますので、一般的な企業においては、そのようなサービスを利用するのが現実的でしょう。

具体的な使い方としては、「この資料を要約して」「このセミナーのお誘いメールを書いて」など、自分の作業の一部を肩代わりしてもらい、仕事の時短を図る使い方や、「育休の申請方法を教えて」「製品Aの活用事例を教えて」など、情報収集に使うケースが多いようです。他部署や同僚にチャットやメールで問い合わせていたことを生成AIに聞けるようになれば、質問者も楽だし、担当部署の負担も減ります。

Box Japanが実施した調査によれば、活用方法のトップは「検索などの情報収集」。次いで「文書の要約、質疑応答」「文書や文章の翻訳」「メール・チャットなどの文章作成」でした。いずれもテキストを対象としているので、現段階においてはテキストでの利用がメインのようです。現在の生成AIモデルは、画像や音声、動画も扱えるようになっていますので、マルチモーダルAIの活用も今後広がっていくでしょう。

業務で使う生成AIの「何」が不安なのか

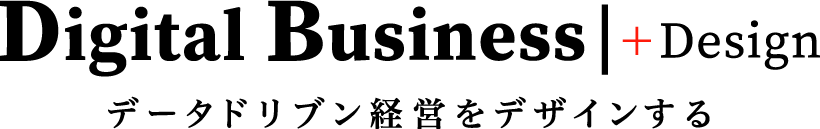

Box Japanは、2024年に「企業における生成AIの活用に関する意識調査」を実施しました。調査対象は、生成AIを導入している企業のユーザーと運用管理者、そして導入を検討している企業の導入関与者(製品選定に関わる人など)の合計1000人です。

生成AI導入済み企業に、「生成AIを利用して、課題や不安に感じることはありますか?」と質問したところ、管理者(導入・運用者)は95%が「ある」と答えています。一般ユーザーで「ある」と答えた人は74%なので、かなりの差が出ています。

では、何に課題や不安を感じるのか。具体的に見ていきましょう。

管理者と一般ユーザーとで回答が若干異なりますが、ざっくりまとめると、課題や不安は以下の3点になります。

- 機密情報が見えてしまうのではないか

- 使いこなせないのではないか

- 間違いに気付かず誤情報を発信してしまうのではないか

注目すべきは、管理者の1位が「機密情報が見えてしまう」なのに対して、一般ユーザーは上位に入っていないことです。管理者が生成AIによる機密情報の漏えいに敏感になっている一方で、一般ユーザーはそもそも機密情報にアクセスできない(と思っている)のが、この乖離(かいり)の一因だと思われます。

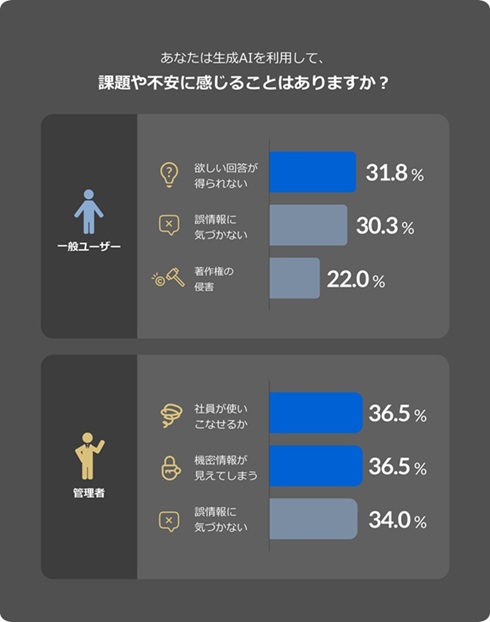

実は、これから導入しようとしている検討中企業が何を重視するかという質問では、「セキュリティ面が担保されていること」が45.8%で、回答の正確さ(34.5%)や提供される機能(27.0%)を大きく引き離してトップになっています。

いままでは、社内の機密情報や個人情報がファイルサーバやクラウドストレージに保存されていても、どこにあるどのフォルダの中にそのファイルがあるか知らなければたどり着くことは難しいため、アクセスできる状態にあっても、「機密情報が見えてしまう」ことを心配する必要はあまりありませんでした。そもそも、他部署のファイルサーバにはアクセスできない企業もあります。

一方で、生成AIはできるだけ多様なドキュメントから情報を収集して回答します。その結果、本来はアクセスするべきではない情報を参照して生成AIが回答を出してくる可能性があります。例えば、生成AIに「私の名前が載っている書類をリストアップしてください」と質問したら、見えてはいけないものが見えてしまうかもしれません。

企業の中で生成AIを利用するには、データを適切に管理する必要があります。

「使いこなせない」「間違いに気付かない」

課題や不安の2つ目に挙げたのが、「使いこなせないのではないか」です。管理者においては「機密情報が見えてしまう」と同率首位。一般ユーザーは、「欲しい回答が得られない」ことを最大の課題・不安と感じています。

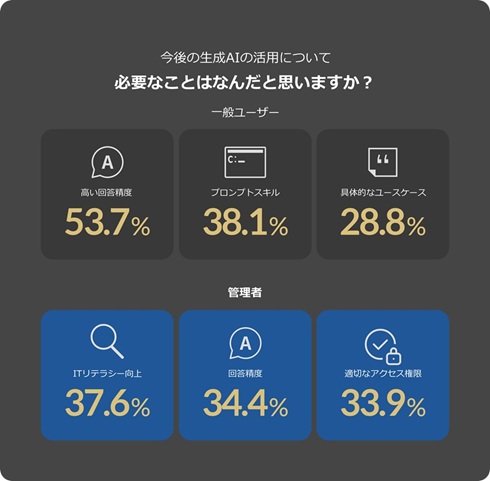

下図は生成AI導入済み企業に、生成AIの活用促進に必要なことを聞いた結果です。

これを見ると、一般ユーザーは生成AIに対して「高い回答精度」を求めている一方で、自分自身に「プロンプトスキル」が必要だと考えています。

特にプロンプトスキルについては、書き方を指南する記事や書籍がいろいろと出ていますし、プロンプトトレーニングやコンテストを実施している企業もあります。ただ、一般ユーザーは「あの面倒そうなことをやらなければいけないのか」と不安になっているし、管理者側も「リテラシーがないと使いこなせない」と心配している様子がうかがえます。

課題や不安では、管理者とユーザーの両方で「誤情報に気付かない」が上位に挙がっています。が、これは「生成AIは間違った回答をすることがある」と広く認知されているということでしょう。事実とは異なる内容や文脈とは無関係な内容を生成する「ハルシネーション」と呼ばれる現象です。

ただ、企業の中で生成AIを利用する場合は、もう一つ気を付けなくてはならない「誤情報」があります。それは、間違った情報源です。企業内には、書きかけの文書や古い文書などもあります。同じ事について、逆の内容が書いてある文書が存在することもあります。これらがきちんと整理・管理されていないと、生成AIが間違った回答を出してくる危険性があります。

守るべき4つのデータ

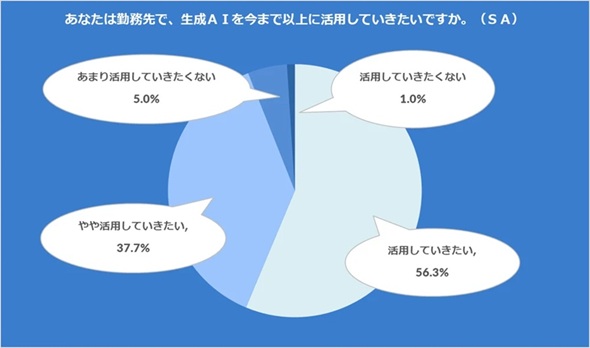

課題や不安はあるものの、既に導入している企業の運用管理者に導入後の社内の反応を尋ねた質問では、82.5%が好評だったと答えています。さらに、今後も活用したいと答えた人は、一般ユーザーで94.5%、運用管理者は93.0%でした。業務で使う生成AIについて、みなさんやはり興味はあるし、取り組みたいというモチベーションは高いようです。

では、企業の中で生成AIを活用するには何が重要なのでしょうか。

企業内にはさまざまな機密情報があります。個人情報を含む人事データや新製品の開発データ、取引先のデータなどがそれに該当します。権限のない人にはこれらの情報にアクセスできないようになっていなければなりません。

そして、生成AIを利用する時に守るべきデータはその機密情報を含むファイルだけではありません。守るべきデータは実は4種類あります。それぞれの注意点とともにお伝えします。

1. 業務データ

一つはもちろん、社内にある業務データなどです。そしてそのデータは、「Single Source of Truth」(信頼できる唯一の情報源)でなければなりません。生成AIが古いデータや間違ったデータを参照すると、間違った回答を返す懸念があるからです。

また、権限のない人がそのデータを利用してしまわないように、アクセス権の設定や管理が必要です。これが適切に実施されていないと、機密情報を含む社内データが生成AIを通じて漏えいするリスクがあります。本来アクセスできない人にまで権限が付与されている状態を「オーバーシェアリング」(過剰共有)といいます。

2. 集約したデータ

生成AIで利用しやすいように、データ(ファイル)をさまざまなシステムやファイルサーバから、生成AI専用ストレージにコピーして集める場合があります。さまざまな場所やシステムにファイルが分散して保存されている場合、ファイルを1カ所に集約しないと、生成AIで社内の情報を活用できません。

この場合、アクセス権の継承、収集の対象範囲、ファイルの重複排除という課題が生じます。これらを解消するのが難しいため、生成AIを導入してみたものの全従業員が利用しても差し支えない就業規則AIなどの展開にとどまってしまうケースがあります。でも、それでは膨大な企業のファイルに含まれているナレッジやノウハウを生成AIで十分に活用できません。

3. プロンプト

生成AIが利用するファイルだけでなく、ユーザーが入力したプロンプトにも、機密情報や重要なノウハウ、ナレッジが含まれている可能性があります。プロンプトが生成AIモデルのディスクやログに保存されたり、学習に利用されたりした場合、AIモデルからの情報漏えいにつながりかねません。

自社の機密情報がAIモデルの学習に利用された場合、そのAIモデルを利用する全てのユーザーに使用されます。もし一般に公開されるモデルの場合、それはインターネット上の全てのユーザーを意味します。これは一般的なデータ漏えいとなんら変わりはありません。

4. 生成AIのデータ

生成AIが回答した分析結果や生成したコンテンツも、企業の重要な情報資産です。企業内のコンテンツと入力されたプロンプトを基に生成されているので、企業のノウハウやナレッジが詰め込まれています。生成AIの情報源である業務ファイルだけでなく、生成AIが生成した情報も適切に管理されなければ、企業の中で安全に生成AIを利用することはできません。

第2回はこれらのデータを保護するセキュリティについて解説します。

関連記事

ユーザー企業に聞いた、生成AI導入はいくらかかるのか?【実態調査】

ユーザー企業に聞いた、生成AI導入はいくらかかるのか?【実態調査】

Box Japanが「企業における生成AIの活用に関する意識調査」を発表した。企業が生成AI導入で重視する要素や、今後の活用推進のカギ、生成AIにかかる予算などが明らかになった。 生産性向上を「個人」から「企業全体」に広げるためには Box CEOが語った施策から考察

生産性向上を「個人」から「企業全体」に広げるためには Box CEOが語った施策から考察

デジタルの活用は業務における個人の生産性を上げつつある。だが、それが企業全体としての生産性向上につながっているのかどうか。Boxのアーロン・レヴィCEOの見解と施策から考察する。 IDが漏えいしても仕方がない――企業のマズイID管理への特効薬は

IDが漏えいしても仕方がない――企業のマズイID管理への特効薬は

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- 「AIを使えば全員同じになる」 羽生善治九段が語るAI時代の差別化と意思決定

- やはりClaude Codeの品質は下がっていた Anthropicが調査し特定した3つの要因

- 「日本のDXは期待外れ」が64% 世界平均を大きく上回るとGartnerが警告

- NTTデータが「商品企画AI」を発表 社内データを基に150秒でコンセプト生成

- NECが人材育成サービスを刷新 「今後必要とされる人材像」を再定義した背景

- Anthropicの新指標 AIの影響を受けにくい「3割の人々」の共通点は?

- 「Windows+R」は絶対に押さないで! 新入社員に贈るセキュリティの新常識5選

- メインフレーム「IBM Z」は51%増、全事業セグメントが増収 IBMが2026年Q1決算を発表

- AI活用で足らないのは「ビジョン」や「熱量」じゃない 経営層と現場で拡大する“ズレの正体”

- 「AI社員」も登場 ServiceNow新戦略から探る、「自動化された企業」から逆算するAI活用