「不可能な賭け」から13年 Googleが独自AIチップ「TPU」を独自開発し続ける理由:「Google Cloud Next 2026」現地レポート

Googleは第8世代TPU「8i」「8t」を発表した。2013年の「不可能な賭け」から始まった自社製チップ開発は、今や推論と学習の2系統へと進化した。垂直統合の強みや失敗を許容する文化、そしてAIの未来を予測する戦略の全貌を、同社フェローのアミン・ヴァダット氏が語る。

この記事は会員限定です。会員登録すると全てご覧いただけます。

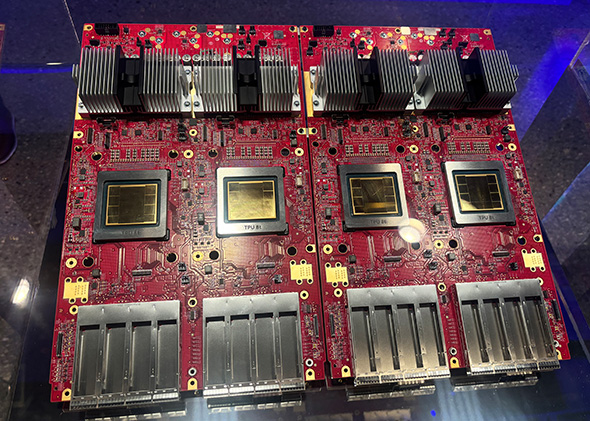

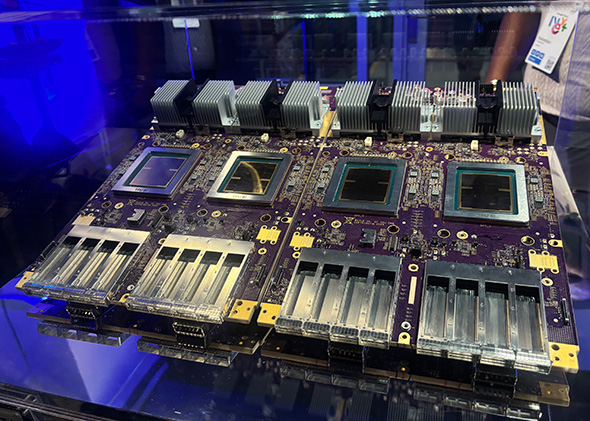

Google Cloudが4月中旬に米国ラスベガスで開催した「Google Cloud Next 2026」の重要な発表の一つが、第8世代のTensor Processing Unit(TPU)の「TPU 8i」と「TPU 8t」だ。Googleは今回初めて用途に合わせた2種類のチップを展開する。TPU開発に着手して13年、なぜ汎用(はんよう)的な既存チップに頼らず自社設計にこだわり続けるのか。

Googleのフェローであり、AIとインフラ担当チーフテクノロジストのアミン・ヴァダット(Amin Vahdat)氏がその歴史を振り返りながら戦略を説明した。

2013年、「不可能な賭け」から始まった

GoogleにおけるTPUの歴史は2013年に始まる。TPUとは、Googleが独自開発したAI処理向けの専用チップだ。汎用計算を担うCPUや、画像処理から転じてAI学習にも広く使われるようになったGPUとは異なり、TPUはニューラルネットワークの推論や学習に不可欠な行列演算を効率的に処理する。特定のワークロードに徹底して特化することで、電力効率と処理性能を大幅に高められるとGoogleは主張している。

Googleがこの専用チップの開発に踏み切った背景には、CPUでは到底埋められない効率の壁があった。

当時はカスタムシリコン(自社設計チップ)の開発に対し、業界全体が否定的な見解を示していた。「CPUは毎年速くなっている」「待てばいい」――それが業界の多くの意見だったとヴァダット氏は振り返る。

しかし、Googleの見解は異なっていた。その転換点となったのが、音声認識と言語翻訳への対応だ。当時、翻訳サービス「Google Translate」を成長させる上で、音声認識技術の活用は避けて通れない課題だった。ヴァダット氏は、当時の切実な状況をこう説明する。

「音声認識は計算コストが非常に高く、膨大な行列演算を繰り返さなくてはいけない。当時、Google Researchのディーン(Jeff Dean氏)は、『もしCPUだけでその計算をこなそうとすれば、Google全体のデータセンターをあと2〜3個分も建て増ししなければならない』と話していた」

一方、カスタムシリコンならば100倍の効率化が見込める。「CPUが100倍速くなるのをただ待つわけにはいかない。しかも、当時既にCPUのシングルコア性能の向上が鈍化しつつあるという見方が広まり始めていた」とヴァダット氏は述べる。こうして、論理的には明快だが、実行には大きなリスクを伴う決断に至った。

最初のチームはわずか30〜40人。投資額も当時としては小さかった。「失敗のコストも低くかった」とヴァダット氏は振り返る。

失敗を許容するカルチャーが大きな賭けを可能にした

なぜGoogleはこうした決断ができるのか。ヴァダット氏はそれをカルチャー面から語る。

「Googleには『不可能かもしれないことに賭ける』という伝統がある。ラリー(Larry Page氏、共同創業者)とセルゲイ(Sergey Brin氏、共同創業者)から続くもので、不可能なことに対して健全な敬意のようなものがある」

その象徴として挙げたのが「Google Maps」だ。「自前の飛行機を飛ばし、車を走らせて地球全体をマッピングする。最初は『ナンセンス』と思われていた。でも実際にやってみると、意味がある取り組みになった」(ヴァダット氏)。

このカルチャーで重要なのは、失敗した場合でもキャリアが傷つかないという点だ。「失敗しても何かを学ぶ。そして、たいていの場合、その失敗を通じて既存の製品や別の製品が良くなる」とヴァダット氏はGoogleの考え方を説明する。大きな賭けに挑む人材を罰しない――それがTPUという長期投資を支えた土台だった。

もう一点、興味深いのが投資コストの考え方だ。Goolgeは検索において「AI Overviews」を開始したが、組み込みのコストについてヴァダット氏は、「Searchというビジネスユニットの目標は収益を上げることではない。最高品質で最も有益な結果を出すことだ。収益化は別の組織が担う。Searchの仕事は、収益化されるかどうかに関わらず、最高の結果を出すことだ」と短期的な収益よりも品質を優先するカルチャーをうかがわせた。

このようなカルチャーに支えられTPUは進化を遂げた。TPU v1(2015年)からv2(2018年)、そして2025年のIronwood(v7)まで、世代ごとに技術が積み重ねられた。チップの発熱を効率的に処理する液体冷却と数千のチップを1つのスーパーコンピュータとして束ねるカスタムネットワークインターコネクトや、AI演算に最適化された専用数値演算フォーマットといった革新が世代ごとに加えられた。

TPU v1は、特定の用途にのみ対応するASIC(Application Specific Integrated Circuit=特定用途向け集積回路)と呼ぶべき存在だった。しかし、世代を重ねるごとに対応できるワークロードが広がり、今やAI以外の数学的集約型処理にも使われるほど汎用性を増した。「われわれがどの時点でASICから脱却したかという明確な転換点はない。必要とされるものに応えながら、できることを増やし続けた結果が今のTPUだ」とヴァダット氏は述べる。

TPUは「Gemini」や「Google 検索」といったGoogleのサービスを支えるだけでなく、「Google Cloud」を通じて外部の顧客にも提供されている。その一例が、金融大手のCitadel Securitiesだ。

同社はTPUをAIモデルの学習や推論に使うのではなく、独自のトレーディングシステムに採用している。一般的なAI用途とは異なるが、「数学的に高度な集中処理を要する」という点では共通しているからだ。TPUの導入により、同社はシステムの処理効率を2〜4倍に高め、同時に30%のコスト削減に成功したという。

垂直統合という強み チップ、クラウド、モデルを一社で

Google CloudのCEO、トーマス・キュリアン(Thoma Kurian)氏は自社の強みを垂直統合とする。「フロンティアモデル、スケールするインフラ、最先端のAIチップを全て一つの会社で持っているのはわれわれだけだ」とキュリアン氏は基調講演で述べた。

垂直統合はそれぞれのエリアにメリットをもたらした。ヴァダット氏が例として挙げたのがTPU 8iの設計過程だ。

エージェント時代に求められるのはスループットではなくレイテンシ――つまり、いかに速く応答を返せるかだ。しかし、従来のチップ接続方式はスループットとバンド幅に最適化されており、レイテンシには不向きだった。この課題を特定できたのも、DeepMind(Google傘下のAI研究組織)と肩を並べて研究する環境があったからこそだとヴァダット氏は言う。

「もしチップだけを作っていたら、前世代よりも速いものにすることで終わっていた。それも悪くはない。だが、サービスが何を必要としているかという洞察に基づいてアーキテクチャを変えること。それが本当のゲームチェンジャーだ」

DeepMindとの議論を経て生まれたのが「Boardfly topology」という新しいネットワーク接続方式だ。チップ間のネットワーク直径を50%以上削減し、任意の2チップ間の距離を大幅に短縮する。公式ブログによれば、これによってオンチップレイテンシが最大5倍削減されている。

「2年前、AIエージェントはまだ一般的な話題ではなく、リアルタイムの強化学習が主流のワークフローでもなかった」とヴァダット氏は振り返る。それでも、社内の数千人もの研究者たちは既にこの未来を予見していた。「多くの優秀な才能が『2〜3年後にはこうなる』と一貫して説き、われわれはそれに耳を傾けた」。

なぜ今、2種類なのか 20年前のシフトが示した未来

8世代目となる今回、Googleは2チップ展開に踏み切った。その決断の根拠として、ヴァダット氏が持ち出したのはGoogleの歴史だった。

「2000年頃、Googleの最大の課題はWebインデックスの構築だった。何万台ものサーバを数カ月かけてクロールし、インデックスを作った。これは巨大な一回限りの作業だった。しかし、インデックスの価値はサービング(ユーザーへの応答処理)にこそある。2005年から2010年にかけて、インフラの負荷の主役は、インデックスからサービングへと変わっていった」

AIにおいても、同じ構造のシフトが起きていると見る。トレーニング(学習)はWebインデックスの構築に相当する大規模で一回限りの作業だ。一方、推論はクエリへの応答に相当する。GeminiやGoogle 検索、「YouTube」が毎秒処理する無数のリクエストがそれに当たる。

最初はAIのトレーニングが主役に見えても、普及が進めば、やがて推論がインフラ負荷の大半を占めるようになる。そうなれば、大量のデータを読み込むトレーニングと、瞬時の回答が求められる推論とでは、必要な性能特性が全く異なってくる。1つのチップで両方を最適にこなすことは、もはや困難なのだ。「2024年、私たちはこの見立てを確信した。だから2種類のチップに踏み切った」とヴァダット氏は述べた。

こうやって開発された2つのチップは「単純な派生ではなく、ゼロから設計した」と同氏は強調する。

TPU 8t(トレーニング特化)

トレーニングに特化したTPU 8tは、フロンティアモデルの開発サイクルを数カ月から数週間に短縮できるとGoogleは主張する。

1ポッド当たり9600チップ、2PBの共有高帯域幅メモリを備え、121 ExaFlopsの演算能力を持つ。前世代比で1ポッド当たり約3倍の演算性能を実現しつつ、ストレージアクセスは10倍高速化された。また、最大100万チップを単一の論理クラスタとして扱えるVirgo Networkを採用し、ニアリニアなスケーリングを実現する。

TPU 8i(推論特化)

推論に特化したTPU 8iは、エージェント時代の低レイテンシ処理を担う。288GBの高帯域幅メモリと384MBのオンチップSRAM(前世代比3倍)を組み合わせ、モデルのアクティブな作業セットをオンチップに保持することで処理の遅延を最小化する。

Boardfly topologyによるICI帯域幅は19.2Tb/sで前世代比2倍。前世代比で80%のコストパフォーマンス改善を実現し、同コストで約2倍の処理量をこなせるとしている。

これからの予測 CPUの復権とさらなる専門化

第8世代を発表したが、まだ課題は残っている。その一つが信頼性だ。前世代のIronwoodでは1万チップ規模で97%超のgoodput(実際に有意義な計算が前進している時間の割合)を達成しており、TPU 8tでも同水準を目標として設計されている。ヴァダット氏は次のように説明した。

「神経系のように、全チップが少しずつ計算を進めてはお互いに情報を交換する。9600チップが協調して動くとき、1チップでも止まれば計算全体が止まる」

チップが動いていても、障害からの復旧中であったり無駄な再計算が発生したりすればgoodputは下がる。障害を素早く検知し、人間が介入することなく自動的に復旧できるかどうかが問われる。人間が関与すれば最低30分、場合によっては数時間のダウンタイムが生じる。それを自動化で解消することが、高いgoodputの鍵だ。

障害を素早く検知して復旧できれば、goodputは保たれる。しかし「厄介な問題」と表現したのは、検知すらできない種類の障害だ。それがサイレントデータ破損(silent data corruption)だ。

「チップが完全に止まるのではなく、ごくまれに計算を間違える場合がある。1時間に1回のエラーでも、そのチップが他の全チップと情報を交換するネットワークにつながっている以上、誤りが全体に伝搬する」。これは業界全体が直面する未解決課題だという。

将来を見据えてヴァダット氏は幾つかの予測を示した。

1つ目は「エージェント時代にはCPUが復権する」ということ。エージェントは推論を実行するだけでなく、オーケストレーション、コード実行のためのサンドボックスやVM(仮想マシン)構築、結果の検証といった汎用計算を大量に伴う。それを担うのは汎用のCPUだとヴァダット氏は見る。

2つ目は、チップの専門化がさらに進むという予測だ。「現在CPUのシングルコア性能向上は年率5%程度だ。新しいワークロードに対応するには専門化するしかない」。2チップ以上に増える可能性も示唆した。ただしヴァダット氏はこれをGoogle固有の予測ではなく、業界全体のトレンドとして語った。

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- ChatGPTがシェア4割を切る 急伸するClaude、安定のGemini――生成AI三極化の兆し

- あなたのパスワードは何分耐えられる? 解析速度上昇で「8文字パスワード」はほぼ無力に

- 富士通とNECの業績見通しから探る「2026年度国内IT需要の行方」

- Microsoft、Copilotのアップデートを発表 ExcelでPlanモードやPython連携が可能に

- 「BeReal」が突きつける経営課題 技術で防げない情報漏えいにどう向き合うか

- 中堅・中小企業に最も人気のAIエージェントは? Google Agentspaceは2位

- 「Windows+R」は絶対に押さないで! 新入社員に贈るセキュリティの新常識5選

- Anthropicが事業戦略を一挙公開 中堅企業支援の新会社設立、金融特化エージェント、SpaceX提携まで

- 「え、就職の面接官がAIだって?」 普及する“AI面接官”への困惑と改善要望【調査】

- 「時短ツール」としてAIを使い続ける企業の“落とし穴” ガートナーが警鐘

アミン・ヴァダット氏

アミン・ヴァダット氏