みなさん、その情報が「100年後どうなるか」を考えたことはありますか?:企業は、デジタルデータ“永久保存時代の到来”をどう構えるべきか

あらゆる情報のデジタル化が急速に進み、データ量が「爆発的な勢い」で増えている。そうした中、どれほどのデータをどれだけ保管すべきかに悩むIT担当者は少なくない。果たして、理想とされる「データ管理のあり方」とは何なのか。先進技術を追うストレージエバンジェリストによる「その将来の予言」から、我々が何をすべきかを考えよう。

あらゆるデータの長期保存が不可欠に

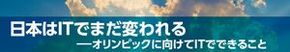

爆発的に増えているデジタルデータをそもそもどう取り扱うか、そして長期保管やその対処をどう考えるかが、いま、企業に強く求められている。

背景にあるのは「データの価値が、より強く認識されるようになった」ことである。例えば、ビッグデータ時代の到来により、これまで蓄積されつつも利用されていなかった、悪く言うと、金食い虫としてコンプライアンスのためだけに保管していた“ダークデータ”も、仮説検証の裏付けなどに極めて有益な「宝の山」であるとの認識が広がっている。

製造業の現場などでは、デジタルデータだけでなく各種レポートに手書きのメモやスケッチ、プリント写真などの付帯資料が添えられることも多い。そんな過去のデータも、その資産を有効に活用することを考慮してデジタル化する。当然、過去のデータの再整理、デジタル化、データベース化にも大容量のストレージが必要である。企業活動によって得られた全データの「長期保管」は、今後の事業成長はもちろん、訴訟対策などのためにも欠かせなくなっている。2014年現在の技術では、複数のストレージ技術を組み合わせてこのパラドックスに対応していくのが主流である。

では、これから先の時代に向けて「適切なデータの保管期間」をどう考えればよいか。日本ヒューレット・パッカード(以下、日本HP)でストレージ技術の最先端を研究、開発を推進し、ユーザーに提言するストレージテクノロジーエバンジェリストの井上陽治氏は「約100年」と見る。理由は明快だ。

「個人シーンで考えれば、SNSなどの写真や動画を一生かけて、親子で楽しみたいと考えるはず。また企業でも、今後のヒトゲノムデータを用いた予防医療などでは数世代のデータの蓄積が求められるでしょう。海外の法規制では、HIPPAの医療記録、年金記録保管期間は100年になるケースもあります。そう考えると、保管年数=約100年が導かれます」(井上氏)

ただ、デジタルデータの長期保管といっても決して簡単ではない。なぜなら、数百年のスパンで長期保存を保証する記録媒体がいまだ登場していないからだ。今から50年前、どんな方法でデータを保存しており、今、どんな形で残っているかを想像してほしい。また、デジタルファイルは一部の損傷で全体を読み取れなくなることもあり、データ喪失のリスクはその分高い。技術の革新によりデータの保存媒体は変化し続ける。その際には、新たな媒体にデータを引き継ぐ作業が必要とされる。そのための手間やコストも決して小さくない。

消費電力問題が「データセンターを破たん」させる?

しかも厄介なのが、あらゆる機器のデジタル化や、SNSに代表される各種ITサービスの普及、さらに、IoT(モノのインターネット)の拡大によって、情報が世の中に生まれる速度が今よりもっと加速し、種類も多様化することが確実なことだ。

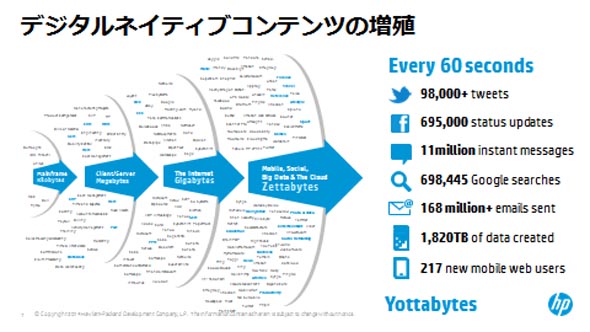

例えば、近年の実用化が期待される「自動運転自動車」は、各種センサーが1秒間に1Gバイトものデータを生成する。もちろん、1台あたりだ。「医療業界」でも、DNAデータを採取する装置の一般化と低価格化とともに、全人類の医療データを収集しようとの動きも急速に盛り上がっている。もう少し具体的な現場目線でも、動画をはじめとする大容量のデータを独自に加工して販売する企業も登場し始めており、2020年には大手ITベンダーの25%が同サービスに参入しているとの予想もある。

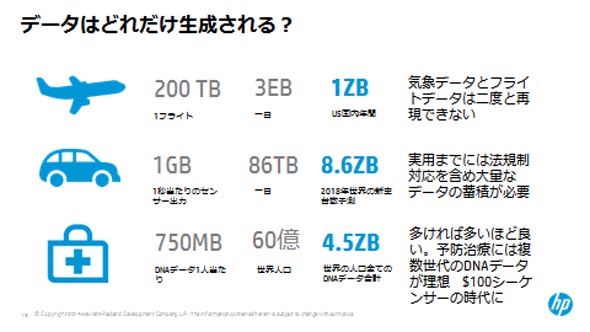

この、保管が難しく、かつ膨大な量のデジタルデータをいかに永続的に管理するのか。その手段として、今、企業が相次いて利用に乗り出しているのが「クラウド」だ。クラウドでのデータ保管は自社ですべてを抱えるのではなく、外のクラウド基盤やサービスを使う。データ管理の手間やコスト、安全性などを総合的に勘案すると、現状での長期保管のための現実解と言える。その利用の急速な広がりによって、2016年には「世界中のストレージの70%が大規模データセンターに集約される」と見られている。読者にも、おそらくそうだと思っている人は多いはずだ。

「話はそう単純ではありません」──。井上氏は苦言を呈す。

クラウドの利用が拡大すれば、当然、データセンター側の物理サーバやストレージが増える。当然、その「消費電力」も増える。データセンターの消費電力量はユーザーとデータの増加を両輪に一貫して右肩上がりを続けており、世界のクラウドサービスプロバイダとその通信を担当するキャリアの使用電力を足し上げると、現状でもすでに「日本の総消費電力を越え、英国の総消費電力の2倍に達している」のだ。消費電力は国家規模──。このことは、データセンターにとって大きなリスクにほかならない。

「こんな危機を回避すべく、ハードウェアの省電力化は以前から進められてきました。しかし、現状のままでは消費電力の増加に到底、追い付くことができません。その結果、近い将来、電力不足によってクラウドが破たんしてしまう可能性も現実問題として決して小さくないのです」(井上氏)

消費電力の削減の手本は人間の“脳”

破綻を回避するには、消費電力の抜本的な削減が不可欠だ。その困難な取り組みを成し遂げるためには、従来技術からの抜本的な転換を可能とさせる新たなイノベーションの創出が不可欠である。

目指すべきコンピュータの究極の姿とは。井上氏が提示するのが人間の「脳」である。

「人間の脳に匹敵するコンピュータは、早くて2020年ごろの登場が予測されています。しかし、その消費電力が問題です。最低でも20〜30メガワットが必要だと推計されています。対して、脳の消費電力は20ワットほどです。つまり、脳はこの時点では100万倍も効率がよい。脳にコンピュータを近づけることこそ、電力問題を解消する切り札と言えます」(井上氏)

それならば、次世代ハードウェアの要件にどんな考え方が必要だろうか。HPでは、「省電力かつ省スペース性を実現していること」、「データの保存媒体が不揮発性であること」、「高い性能と拡張性を備えていること」の3つを挙げ、将来なデータセンター基盤のあり方を再定義した。2020年の実用化を目指し、技術開発を推進している。

具体的な技術はずばり、

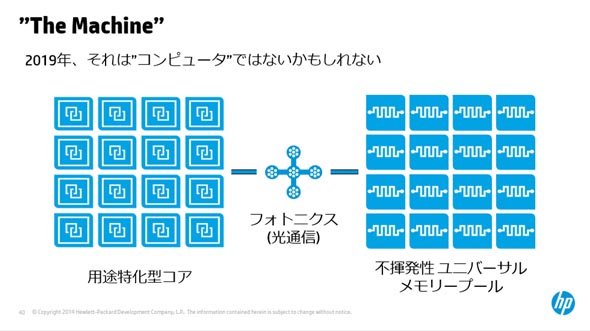

- サーバの設計を根本から見直すことによる、アプリケーションごとに最適化が可能な演算もしくはコンピュータアークテクチャの実現

- コンピュータと各種コンポーネントつなぐバスの“光子化”

- 電源を切っても情報の長期保存が可能で、高性能大容量化が可能な新メモリの開発

の3つだ。その先に同社が描くのは、従来とは格段に低消費電力かつ高性能で、拡張性も高い環境の実現である。特定の用途に特化した演算もしくはコンピュータコアと、メモリ兼ストレージがあり、それらを超高速バスで接続する。この新たなコンピュータ設計をHPでは「The Machine」と定義している。

もう、成果は着実に上がっている。

「2013年4月、HPは各アプリケーションに最適化されたコアの追加が可能な省電力サーバ“HP Moonshot System”を発表しました。これにより、従来型サーバより8割もの省電力化を実現しました。また、銅線のバスリンクより30倍も高速かつ、10分の1の消費電力で伝送する光速のバス“Photonics”や、常時通電の必要がなく従来メモリより高性能で、ストレージにも利用可能なHP独自の不揮発メモリ素材“Memristor”も、あとわずかで商用化できる段階にこぎつけているのです」(井上氏)

The Machineで新ビジネスの創造も

「The Machine」が秘める可能性は極めて大きい。

まず、既存のハードウェアをThe Machineに刷新することで、劇的な省電力化が実現され、データセンターの電力問題の抜本的対策になる。クラウドの破たんリスクが回避されることで、増え続けるデータの100年にわたる保管も現実のものとなる。

小型化も進むことも大きい。人工衛星などへの搭載が可能になれば、撮影データの活用による新たなビジネスの創出も見込まれる。

「わずかな電力で稼働するため、宇宙ではソーラーパネルにより十分な電力供給が可能です。また、無人飛行機などへの搭載などや、小型データセンターへの応用など、使い方はアイデア次第と言えます」(井上氏)

この劇的なイノベーションを実現するハードウェアの登場において見逃せないのが、長年にわたるハードウェアベンダーとしての技術とノウハウの蓄積である。人や金、時間を費やすことなく、それらを獲得することは不可能。The Machineの具現化に取り組むHPは、他のサーバベンダーに対して技術的に大きな優位性があると言える。

「なぜハードウェアが重要なのでしょう。クラウドによりソフトウェア開発は誰でもできるようになります。一方、ハードウェアはそうはいきません。いまさらインフラ……ではなく、今からなのです。我々にとって、ハードウェアに関する知的資産を多数保有していることは大きな強み。The Machineはまさにその集約と言えます。ここでの蓄積を生かし、電力問題の解決を皮切りに、困難な課題への対応を精力的に推し進めるべく日々、市場をリサーチする日々です」(井上氏)

爆発的に増えるデータの量をふまえ、管理の“あり方”を見直そう

さて、データを保管する最終的な狙いは「活用」にある。残すだけなら既存の何かに記録して博物館などで厳重に管理すればいい。それは、The Machineでも同様だ。活用となると問題となるのが、データの種類や量が増すほど「情報の検索性が低下」してしまうこと。100年ものデータ保管となれば、その量は従来と一線を画す。ここを考えたい。

「情報活用による価値を極大化するためには、データ増への何らかの手立てが不可欠です。取り組むべきことは、膨大なデータ管理を視野に入れた“管理ルールの見直し”です」(井上氏)

とはいえ、それはこれまでのデータ管理手段と大差ないと思うかもしれない。データの棚卸によって、社内のどこに、どんなデータがあるのかを洗い出し、その後データをクラウド上に移行する。見直しが必要なのは、「データの分類法」である。

「従来からのディレクトリによる管理では、データ量が増えるほどディレクトリの数が増え、必要な情報にたどり着くことが難しくなります。その対応策として効果的なのが、時系列でざっくりと情報をまとめることです。これにより、情報のあり処が感覚的に類推できるようになり、そこから検索で情報をたどることが可能になります。こうした仕組みの整備が情報活用のためにも欠かせません」(井上氏)

その上で、データを活用の促進に向け「新たなデータ管理法を現場に根付かせる」わけだ。ただ、この作業がIT部門にとって最も難しい……。

「現場の社員には、従来のやり方が変わることに反発を覚える人も少なくありません。この抵抗の中で作業を遂行するためにも、経営トップを巻き込きこみ、トップダウンで作業を進められる体制を敷く必要があります。同時に、現場に対しても十分な説明を行ってコンセンサスを得ることが重要です。これをしなければ取り組みは途中でとん挫してしまうでしょう。このことは、自社が市場について行けずに脱落することにもつながります」(井上氏)

「今後100年のデータ保存」──基盤整備と情報の管理ルールの策定をともに進めることが、100年にわたるデータ管理の実践に向けた先進アプローチだ。今後「The Machine」などによる機能の高度化と、コンサルタントによる運用支援がデータ管理を高度化させる役割を率先して担っていく構えという。

果たして100年ものデータ保管で、企業にどのような変化が生まれ、その結果、どんな未来が到来しようとしているのか。ビッグデータ時代に向けて、次世代のストレージ基盤の構築を考え、実践する時期はもう間近に迫っているようだ。

関連記事

オープンソースソフトウェアに注目せよ! ビッグデータ解析最前線

オープンソースソフトウェアに注目せよ! ビッグデータ解析最前線

「ビッグデータを活用したい」と考える企業は多いものの、実際にデータを分析するとなると、解析の手法やツール、コストに悩まされるものだ。ここでは、事例を元にオープンソースソフトウェアをうまく活用する方法を紹介していく。 こうすれば、社内SaaS活用は成功する〜事例から学ぶクラウド活用術

こうすれば、社内SaaS活用は成功する〜事例から学ぶクラウド活用術

企業内システムのクラウド化が進む昨今、「クラウドを活用して競争力を上げたい」と考える企業は多いものの、「でも、どうすればよいのかが分からない」と途方に暮れる担当者も多い。ここでは事例からクラウドの活用法を探る。 日本人の生真面目さが企業をダメにする

日本人の生真面目さが企業をダメにする

日本のITシステムは“ガラパゴスIT”などと呼ばれ、その特殊さがゆえにシステム構築に莫大な費用がかかったり、新技術導入が遅れるなどの問題が発生している。では、なぜこのような事態になってしまうのか。HPで数多くの案件を手掛けてきた西村氏に聞いた。 2020年のCIOとIT部門の役割 現実課題を打開するヒント

2020年のCIOとIT部門の役割 現実課題を打開するヒント

ITでビジネス貢献――IT部門の“あるべき姿”として長らく提唱されてきたメッセージだが、その実現のためにCIOがとるべき行動とはなにか。日本HPの山口CTOに聞く。 クラウドの本流を狙うHPの思惑

クラウドの本流を狙うHPの思惑

ベンダー各社のクラウド訴求が一段と活発になる昨今、HPは競合とやや一線を画した展開を推進しているようだ。「クラウドのブレークは2、3年後」と語る米HP クラウド テクノロジスト グループの真壁技術担当部長に真意を聞いた。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

提供:日本ヒューレット・パッカード株式会社

アイティメディア営業企画/制作:ITmedia エンタープライズ編集部/掲載内容有効期限:2015年2月6日

特集関連記事

エンタープライズ領域におけるクラウド利用がいよいよ本格的に普及段階に入った。その理由と背景は何か。自社は、導入をどう考えればよいか。主要ベンダーのクラウド関連エバンジェリストに、現状とその未来を分析してもらった。

企業内システムのクラウド化が進む昨今、「クラウドを活用して競争力を上げたい」と考える企業は多いものの、「でも、どうすればよいのかが分からない」と途方に暮れる担当者も多い。ここでは事例からクラウドの活用法を探る。

「ビッグデータを活用したい」と考える企業は多いものの、実際にデータを分析するとなると、解析の手法やツール、コストに悩まされるものだ。ここでは、事例を元にオープンソースソフトウェアをうまく活用する方法を紹介していく。

企業の“ビッグデータ活用”への期待度は高い。しかし、現実には「ビッグデータは持っているが活用はできていない」という企業がほとんどだろう。ここでは、思いがけない方法でビッグデータ分析を活用している事例などを紹介する。

日本のITシステムは“ガラパゴスIT”などと呼ばれ、その特殊さがゆえにシステム構築に莫大な費用がかかったり、新技術導入が遅れるなどの問題が発生している。では、なぜこのような事態になってしまうのか。HPで数多くの案件を手掛けてきた西村氏に聞いた。

ITでビジネス貢献――IT部門の“あるべき姿”として長らく提唱されてきたメッセージだが、その実現のためにCIOがとるべき行動とはなにか。日本HPの山口CTOに聞く。

ベンダー各社のクラウド訴求が一段と活発になる昨今、HPは競合とやや一線を画した展開を推進しているようだ。「クラウドのブレークは2、3年後」と語る米HP クラウド テクノロジスト グループの真壁技術担当部長に真意を聞いた

日本HP ストレージテクノロジーエバンジェリストの井上陽治氏

日本HP ストレージテクノロジーエバンジェリストの井上陽治氏

「検索志向のメタデータがデータマイニング、Discovery時代に必要です」(井上氏)

「検索志向のメタデータがデータマイニング、Discovery時代に必要です」(井上氏)