もうすぐ使える「Apple Intelligence」日本語版、先行で体験してみた AppleのAIで何ができるかを解説(3/3 ページ)

カメラと連携する「Visual Intelligence」

特にiPhone向けの機能で注目しておきたいのが「Visual Intelligence」だ。

Visual Intelligenceは、カメラから得た画像を使って「検索」「翻訳」「情報登録」などを行うもの。Googleも「Googleレンズ」として似たことをやっているし、Geminiでも画像認識を行っているが、同じような流れに位置するものといえるだろう。

Visual Intelligenceの呼び出しには「カメラコントロール」を使う。カメラコントロールを備えたiPhone 16やiPhone 16 Proでカメラコントロールを長押しすると表示される。カメラ撮影と似た感覚だが、画像を認識したうえで、「質問」「検索」「翻訳」など、画像から使うべきものがピックアップされ、やりたいことを選ぶ。

この機能はカメラコントロールから呼び出す訳だが、Apple Intelligenceを意識して作られたiPhoneであるはずのiPhone 16eにはカメラコントロールがない。

そのためか、もう一つの専用ボタンである「アクションボタン」にVisual Intelligence呼び出しを割り振れるようになっていて、その旨、Appleの製品ページでも説明がなされている。

なお、Apple IntelligenceはiPhone 15 Proシリーズでも使えるが、こちらにもカメラコントロールはない。OSのアップデートによってアクションボタンに割り振ることが可能にできそうなものだが、どうなるかは現状では不明だ。

Siriや通知、「写真」検索の改善も

Apple IntelligenceでSiriや通知も改善される。

分かりやすい点としては「Siriの聴き取り能力が高まる」という点を挙げておきたい。言いよどんだりしても理解してもらいやすくなった。

アプリやメールの中でのコミュニケーションや行動の履歴も把握しているので、Siriに命令した際、文脈を読んで返答してくれる可能性も高くなる。この辺は使い始めてから時間がたたないと分かりづらいところもあるし、アプリ側での対応が必要な場合もある。

通知については、複数の通知がある場合にApple Intelligenceで「内容をまとめてくれる」機能もある。前出の「メール」アプリの例もそれに近い。個人的には、「メール」での複数メールの「まとめて要約」と同様、便利なものだと感じた。

通知をまとめる機能は、海外ではニュースをまとめる際に内容を間違える、という指摘されている。生成AIが関わるモノだけに、副作用もありそうだ。そのためニュース関連ではまとめ機能が一時停止されている、という話もある。「通知まとめ」が便利であるのは間違いない。他の機能と同じく、次第に洗練されて行くことになるだろう。

また、「写真」機能の改善も多い。一足先に、写真から不要なものを消す「クリーンアップ」は追加されているが、他にも追加機能はある。

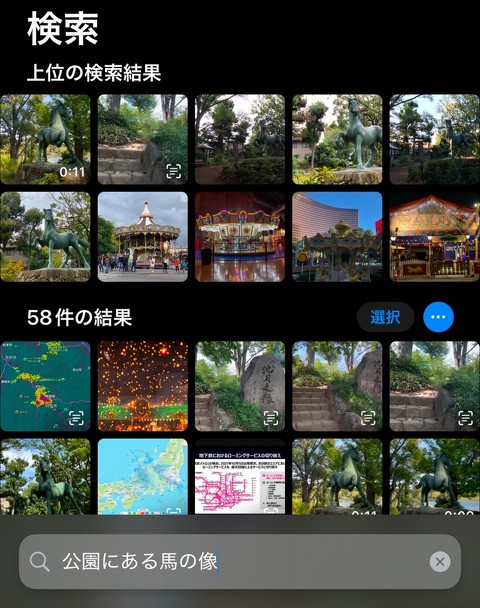

特に重要なのは、「写真」に登録されている写真や動画を検索する機能の強化だ。いままではシンプルなキーワードでの検索だったが、今後はApple Intelligenceで画像を解析し、「複雑な自然文」での検索が可能になる。また、この機能は写真だけでなく、動画の中の1コマまで対象になる。これはかなり便利だ。

ただし、アップデート直後には「写真」内のインデックス作成作業が必要になる。明確に検索できるようになるにはしばらく時間が必要になる。

これに限らず、Apple IntelligenceはAIモデルのダウンロードや適応に、しばらく時間がかかる。本領発揮には、アップデート後にしばらく待つ必要があるので、ご注意を。

関連記事

生成AI「Apple Intelligence」米国で開始 写真や文章のAI編集機能が無料で

生成AI「Apple Intelligence」米国で開始 写真や文章のAI編集機能が無料で

米AppleがiPhone・iPad・Mac向けの生成AI機能「Apple Intelligence」の提供を開始した。各OS向けに無料のソフトウェアアップデートを配信しており、英語で利用可能。日本語には未対応だが、デバイスとSiriの言語を「英語(米国)」に設定すれば日本でも英語での利用はできる。 米Appleの独自AI「Apple Intelligence」、英語のβ版を10月に提供 日本語対応は2025年以降に【詳細追記】

米Appleの独自AI「Apple Intelligence」、英語のβ版を10月に提供 日本語対応は2025年以降に【詳細追記】

米Appleは、独自AI「Apple Intelligence」のβ版を10月に提供すると発表した。まずは英語のみに対応する。 アップルのAI機能「Apple Intelligence」、日本語で使えるように 4月初旬から

アップルのAI機能「Apple Intelligence」、日本語で使えるように 4月初旬から

米Appleは、iPhone・iPad・Mac向けの生成AI機能「Apple Intelligence」を4月初旬に日本語対応すると発表した。 Appleが作ったAI 「Apple Intelligence」とは結局何なのか、改めておさらいしてみる

Appleが作ったAI 「Apple Intelligence」とは結局何なのか、改めておさらいしてみる

生成AIでAppleは出遅れたように見えたし、それゆえAppleがChatGPTなどに対抗するシステムを作り上げると思った人が多かったようだ。だから、Apple Intelligenceについて多くの人が誤解した。しかしAppleは、Apple Intelligenceは「パーソナルなインテリジェンス」と定義している。 iPhoneの目玉機能なのに日本は“お預け” 「AppleのAI」が抱えるジレンマとは

iPhoneの目玉機能なのに日本は“お預け” 「AppleのAI」が抱えるジレンマとは

新iPhoneである「iPhone 16シリーズ」は、米Appleのオンデバイス生成AIである「Apple Intelligence」にフォーカスした製品になった。ただ、「個人向けのパーソナルAI」的な要素には。「十分な機能が提供できるのか」「期待通りの賢いAIを提供できるのか」という懸念も存在する。アップルはそこにどう応えようとしているのだろうか。

Copyright © ITmedia, Inc. All Rights Reserved.