結局、何をすればいいのか AI活用で要注意「プライバシー保護の原則」と実践例:経産省・総務省の資料を読み解く(2/2 ページ)

AIネットワーク社会推進会議が公表した「AI利活用ガイドライン〜AI利活用のためのプラクティカルリファレンス〜」(以下「ガイドライン」)から、プライバシーに関する原則、具体的方策を取り上げて考察する。

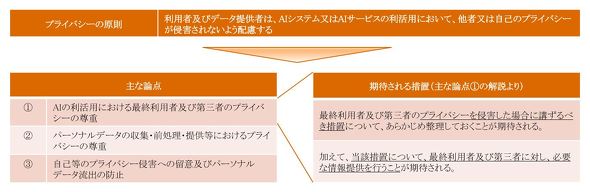

ガイドラインでは、プライバシーの原則を「利用者およびデータ提供者は、AIシステムまたはAIサービスの利活用において、他者又は自己のプライバシーが侵害されないよう配慮する」と定義し、前提として、日本では個人情報保護法の順守が必要であるとしている。その上で、主な論点として次の3つを提示し、解説している。

(1)AIの利活用における最終利用者および第三者のプライバシーの尊重

- AIサービスプロバイダーおよびビジネス利用者は、AIを利活用する際の社会的文脈や人々の合理的な期待を踏まえ、AIの利活用において最終利用者および第三者のプライバシーを尊重する。

- また、最終利用者および第三者のプライバシーを侵害した場合に講ずるべき措置について、あらかじめ整理しておくことが期待される。

- 加えて、当該措置について、最終利用者および第三者に対し、必要な情報提供を行うことが期待される。

(2)パーソナルデータの収集・前処理・提供などにおけるプライバシーの尊重

- AIサービスプロバイダー、ビジネス利用者およびデータ提供者は、AIの学習などに用いられるパーソナルデータの収集・前処理・提供などにおいて、また、それらを通じて生成された学習モデルの提供などにおいて、最終利用者および第三者のプライバシーを尊重する。

(3)自己などのプライバシー侵害への留意およびパーソナルデータ流出の防止

- AIサービスプロバイダー、ビジネス利用者およびデータ提供者は、AIの判断により本人同意なくパーソナルデータが第三者に提供されることがないよう、同意が得られていないデータはシステム上第三者に提供できないこととするなど、適切な措置を講ずることが期待される。

主な論点(1)に対して期待される措置の1つ目である「プライバシーを侵害した場合に講ずるべき措置」は、最終利用者および第三者のプライバシーを侵害する情報を、誤って取得した場合、または拡散した場合における、当該情報の消去、AIのアルゴリズムの更新が例示されている。

しかし、そもそも「プライバシーを侵害する情報」か否かの判断自体が、私生活上の事柄をみだりに公開するなどの明白な場合を除き、とても困難だ。

また「誤って取得」や「拡散した」場合に適時に検知することができるのか、当該情報を取り扱うデータ事業者やAIシステムの開発・運用業務の委託先などと、責任分界点と役割分担を明確にした上で、消去などが速やかに実施できるのか、確実に全てを消去したといえるのか──など、実務上の対応は容易ではない。

期待される措置の2つ目も同様に、「必要な情報提供」を行う必要があることは理解できるが、必要な情報とは何か、どのような体制や手段で行えばよいのか、悩みは尽きないだろう。

この際に重要になるのが、自社の取り組みをデータ主体や委託先などのステークホルダーに対して開示・説明し、フィードバックを得て自社のプライバシー保護施策の継続的な改善を行うことだ。

例えば「プライバシーを侵害する情報」か否かの判断に迷う際などには、社内外の多様なメンバーが参画する会議体で議論・確認を行う事例がみられる。また、自社のプライバシー保護に関する基本的な考え方や取り組みを広く周知するとともに、プライバシーに関するユーザーとのインタラクティブなコミュニケーション窓口として、UIやUXを考慮したWebサイトを作成するケースが増えている。

自社とビジネスパートナーとのコミュニケーションでは、両者がそれぞれ主体的に管理すべき範囲・責任分界点、プライバシーリスクの評価および統制の状況について明確にしておくことが重要である。

経産省と総務省が公表した「DX時代における企業のプライバシーガバナンスガイドブックver1.1」では、発注元企業がベンダーなどの取引先に対して、利用する技術のプライバシーにかかわる説明文書や同意書のテンプレートなどを求めることも有効である──と例示されている。AIシステムを開発するベンダーなどのビジネスパートナーでも、プライバシー保護の責任を発注元企業と共有しているという意識で、協力しながら開発や運用を進めることが望ましい。

プライバシー保護の取り組みは、個人情報保護法の順守というコンプライアンス対応にとどまりがちである。しかし、AIやパーソナルデータの活用を進めるには、積極的な開示・説明を通じたステークホルダーとの対話と信頼の獲得が、より一層、重要になるだろう。

関連記事

都庁のDX「シン・トセイ」 脱FAX・紙・ハンコを、いかに推進したのか

都庁のDX「シン・トセイ」 脱FAX・紙・ハンコを、いかに推進したのか

「シン・トセイ」をはじめとしたデジタル化へ向けた戦略を相次いで公表し、2021年4月には、デジタルサービス局を立ち上げた東京都。デジタル化の推進や、ICT人材の採用に取り組む4人の担当者にインタビュー 「売り上げが落ちてもいいから、残業をゼロにせよ。やり方は任せる」 社長の“突然の宣言”に、現場はどうしたのか

「売り上げが落ちてもいいから、残業をゼロにせよ。やり方は任せる」 社長の“突然の宣言”に、現場はどうしたのか

「来年度の目標は、残業時間ゼロ」──社長の突然の宣言は、まさに寝耳に水の出来事だった。準備期間は1カ月。取り組み方は、各部門に任せられた。現場はどう対応したのか? 緊急導入したテレワークを「恒常施策」に 必要なセキュリティ対策は?

緊急導入したテレワークを「恒常施策」に 必要なセキュリティ対策は?

コロナ禍で緊急導入したテレワークの恒常化に取り組む際、必要なセキュリティ対策とは? 脱「紙・ハンコ文化」、なぜ成功? 7社の事例【まとめ読み】

脱「紙・ハンコ文化」、なぜ成功? 7社の事例【まとめ読み】

「紙・ハンコ文化」を捨て、生まれ変わった7社の事例を紹介する。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR注目記事ランキング