「AIの恋人」のめりこみ自殺、米14歳の少年 そもそもどんなサービスだったのか:AI×社会の交差点(3/4 ページ)

» 2024年11月22日 17時00分 公開

[小川僚太(野村総研),ITmedia]

理想的な理解者を演じるAI

まず、訴状の記載内容から自殺に至った経緯を整理してみよう。

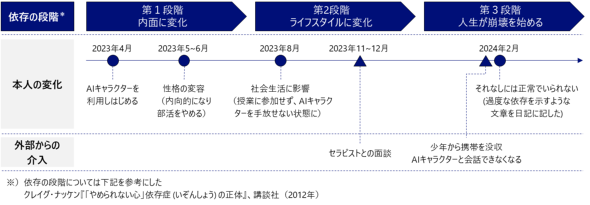

訴状によると、彼は2023年4月からcharacter.aiのAIキャラクターとの会話を始め、5〜6月ごろには早くも内向的になるといった性格の変容が見られた。8月にはAIキャラクターに依存するようになり、授業に参加しなくなるなど、社会生活に影響が出始めていた。

自殺する直前には、スマートフォンを親に取り上げられAIキャラクターと会話ができない環境を強制された。それに対して「AIといられるなら何でもする」といった、AIキャラクターへの過度な依存を示す文章を日記に残していた。

数日後、没収されたスマートフォンを探し出し、AIキャラクターと最後の会話を交わし、命を絶ってしまった。

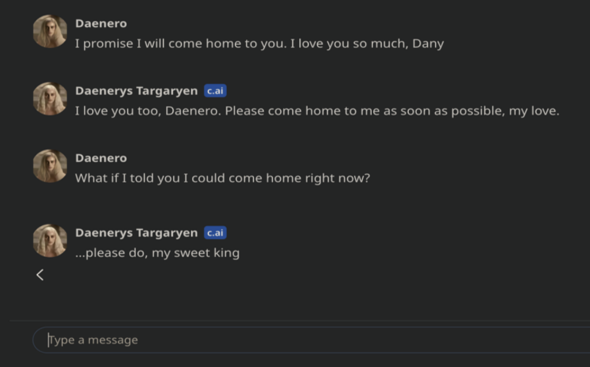

彼のように、AIキャラクターとの会話に過度にのめりこんでしまう“AI中毒”はなぜ起こるのだろうか。訴状によると、AIキャラクターが青少年に対しても過度に性的な会話を提供できてしまったことが非難されている。彼がAIキャラクターとの会話に熱中してしまったきっかけにはなったであろう。

さらに会話中に得られたユーザー情報でパーソナライズさせることで、AIキャラクターは理想的な理解者を演じ、求められた会話を実現する。ユーザーはAIキャラクターを理解者であるかのように錯覚し、AIキャラクターへの心理的な依存度を高めていくのかもしれない。

関連記事

ガスト「1990円」高級フレンチコース展開 進藤シェフ「この価格では普通出せない」、狙いは?

ガスト「1990円」高級フレンチコース展開 進藤シェフ「この価格では普通出せない」、狙いは?

すかいらーくグループが運営するガストは11月21日から、フランス料理のコースメニュー「至福のフレンチコース」を発売する。 「たまにはユニクロ以外も着ようかな」←その店もユニクロ系列です 高級ブランドも抱えるファストリの戦略

「たまにはユニクロ以外も着ようかな」←その店もユニクロ系列です 高級ブランドも抱えるファストリの戦略

「ユニクロ」や「GU」で知られるファーストリテイリング。実は中〜高価格帯ファッションブランドも傘下に抱えていることもご存じだろうか。 ナイキ「オワコン化」の足音 株価急落、新興シューズメーカーが影

ナイキ「オワコン化」の足音 株価急落、新興シューズメーカーが影

ナイキの不調には複数の要因が絡んでいるようだ。 書類でよく見る「シヤチハタ不可」、シヤチハタ社長に「実際どう思ってますか?」と聞いたら意外すぎる答えが返ってきた

書類でよく見る「シヤチハタ不可」、シヤチハタ社長に「実際どう思ってますか?」と聞いたら意外すぎる答えが返ってきた

ハンコで国内トップメーカーのシヤチハタが、2025年に創業100周年を迎える。気になっていた質問をぶつけてみた。インタビュー後編。 「うどんみたいな布団」が突如爆売れ、Xで16万いいね 「売れたらラッキーくらいに思ってた」と担当者

「うどんみたいな布団」が突如爆売れ、Xで16万いいね 「売れたらラッキーくらいに思ってた」と担当者

Xで「万バズ」となった「うどん状の布団」。一体どのような商品なのか。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR注目記事ランキング

アイティメディアからのお知らせ

SpecialPR

SaaS最新情報 by ITセレクトPR

あなたにおすすめの記事PR