AI活用のリスクとは? ビジネスで求められるAIガバナンスの条件

私たちの生活や仕事を効率的にするAI(人工知能)はさまざまなシーンで活用が模索される。ただAIにもリスクがある。AIで失敗しないために、DX時代のAIガバナンスはどうあるべきか。

この記事は会員限定です。会員登録すると全てご覧いただけます。

多様なシーンにAIが実装されビジネスに変革がもたらされている。一方でAIを利用するリスクが欧米を中心に活発に議論される。特にプライバシーに関わる領域は慎重なAIの活用が求められる。リスクに配慮して信頼できるAIを構築、運用するにはどのようなアプローチが必要か。AIのリスクやそのコントロールの在り方を、デロイト トーマツグループのAIに関する実践的研究組織「Deloitte AI Institute」所長、森 正弥氏が語った。

本記事は「NexTech Week 2022【春】AI・人工知能EXPO」での氏の講演「今こそ必要とされるAIガバナンス〜企業におけるAIの戦略的活用を支えるリスクコントロール〜」を基に編集部で再構成した。

プライバシーに関わるAIリスク

森氏はAIガバナンスを語る際に欠かせない2つのトピックに、「自動意思決定への規制」と「人間参加型AI」を挙げる。

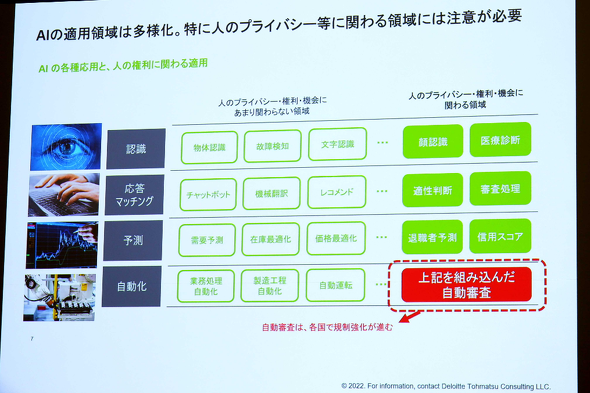

AIの役割は認識、応答・マッチング、予測、自動化など多岐にわたり、その応用範囲は広い。このうち人の「プライバシー・権利・機会」に関わるAI活用領域やそれらを組み込んだ自動審査(自動意思決定)については各国で問題が報告され、規制強化が進んでいる。住宅ローン審査に使われる与信AIなどが該当する。

「AIの判断は客観的と思われがちですが、実際にはデータに含まれる人種や性別、年齢などのバイアス(偏見)を学習してしまうことがあります。バイアスのあるデータを基にAIが与信審査を行うと差別的な要因によって審査に落ちる結果が導かれてしまい、その結果をまたAIが学習し、差別的な判断を強固なものとしてしまいます。AIの意思決定が社会的弱者への差別的な対応を助長するという問題が米国で指摘されています」(森氏)

関連記事

NECが財務省税関から受注 AI活用のX線画像識別処理システム

NECが財務省税関から受注 AI活用のX線画像識別処理システム

NECは、AIを活用して検査対象の国際郵便物をリアルタイムに自動識別するX線画像識別処理システムを財務省税関から受注した。税関検査の高度化と効率化が期待される。 ランサムウェアに対する日本企業の“脆弱さ” 改善の鍵を握る3つのポイント

ランサムウェアに対する日本企業の“脆弱さ” 改善の鍵を握る3つのポイント

ランサムウェア攻撃は今や企業にとって事業継続を脅かす重大リスクとなっている。被害増加の背景には何があるのか。そこから見えたランサムウェア対策のポイントとは。 「成功するDX」と「失敗するDX」の違いはどこにあるのか

「成功するDX」と「失敗するDX」の違いはどこにあるのか

企業が取り組むDXにおいて、成功と失敗のパターンの違いはどこにあるのか。日本マイクロソフトの提案を基に考えてみたい。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- Anthropic、中小企業用AI業務支援「Claude for Small Business」発表 15種のAIエージェントが作業を肩代わり

- アクセンチュアとGoogleが新プログラム AI全社展開で「つまづく」企業を支援へ

- デンソー、SCMの内製主義から脱却へ 「AIエージェント」で挑むサプライチェーン強靱化

- あなたのパスワードは何分耐えられる? 解析速度上昇で「8文字パスワード」はほぼ無力に

- アクセンチュアがAnthropicとの協業を国内本格化 Claudeを活用した4つの支援領域とは

- ドローンいらず? 飛行動画作成できる「Google Earth Studio」登場

- NTTグループはAIで「GAFAM級」の存在感を発揮できるか?

- 「Windows+R」は絶対に押さないで! 新入社員に贈るセキュリティの新常識5選

- SAPが「自律型エンタープライズ戦略」を始動 AIエージェントが業務を自動実行する時代へ

- ChatGPTがシェア4割を切る 急伸するClaude、安定のGemini――生成AI三極化の兆し

デロイト トーマツグループ 森 正弥氏(出典:講演より撮影)

デロイト トーマツグループ 森 正弥氏(出典:講演より撮影)