便利さの裏で進む“静かな崩壊” AIセキュリティの死角を掘り下げる

AIは「使うツール」から「意思決定し行動する主体」へと進化しつつある。しかしその裏で、企業のセキュリティは追い付いていない。暴走する計画、乗っ取り、そして現実世界への影響――。AIエージェントがもたらすリスクの本質とは何か。従来の対策が通用しない理由に迫る。

この記事は会員限定です。会員登録すると全てご覧いただけます。

PwCコンサルティングは2026年3月19日、「AIエージェントを取り巻くサイバーセキュリティリスク」と題するセミナーを開催した。

AIが効率化のためのツールから、自律的な意志決定代行者へとシフトする中で、どのようなリスクがあるのかを解説するものだ。同社の村上純一氏(パートナー)、柴田健久氏(ディレクター)が登壇し、リスクを許容し、メリットを享受するための道筋を解説した。

AI活用における世界の課題、日本の課題

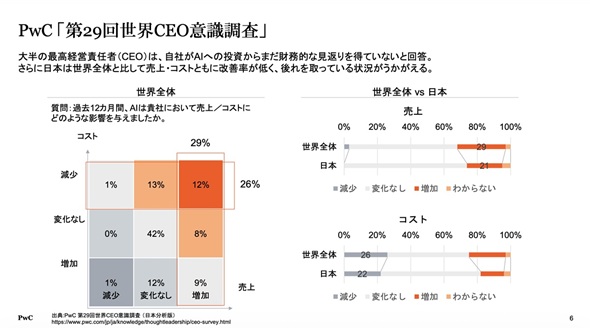

村上氏ははじめに、PwCの「第29回世界CEO意識調査」を基に、生成AIへの投資に対する現状の見返りを解説する。調査によると、「AI投資から十分な財務的リターンを得ている」と回答したCEOは全体の4分の1程度で、売上上昇とコスト削減の両方を実現できている企業はわずか12%にすぎなかった。

また、PwCコンサルティングの独自調査によると、「売上が増加した」と回答したのが、グローバルでは29%に対して日本は21%、「コストが減少した」と回答したのが、グローバル26%に対して22%と、いずれもグローバル平均を下回る結果となった。

2023年時点での調査結果では、日本企業の生成AI活用は他国を先んじていたが、2024年には米国に追い抜かれていたという。これは日本企業が先行優位を喪失し、活用の程度だけでなく、効果創出においても課題を抱えていることを示唆している。

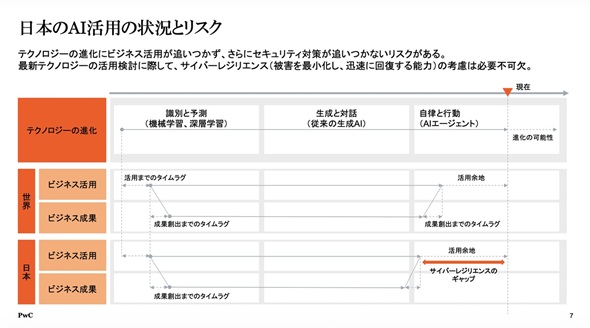

テクノロジーの進化は、従来の機械学習による「識別・予測」から、生成AIによる「生成・対話」を経て、AIが自ら目標達成のために動く「自律・行動」の段階、すなわちAIエージェントの世界へと突入している。

しかしこの進化の速度に対し、企業のビジネス活用やセキュリティ対策は大きく立ち遅れている。村上氏は、最新の技術がもたらす可能性と、それを安全に運用するためのガバナンスとの間に生じている「サイバーレジリエンスのギャップ」を強く危惧している。村上氏は、企業が競争力を維持するための大前提として、「新しいテクノロジーを使うためには、それを支えるレジリエンスの基盤が必要だ」と述べる。

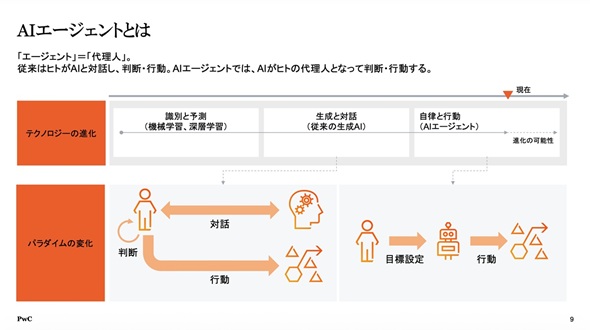

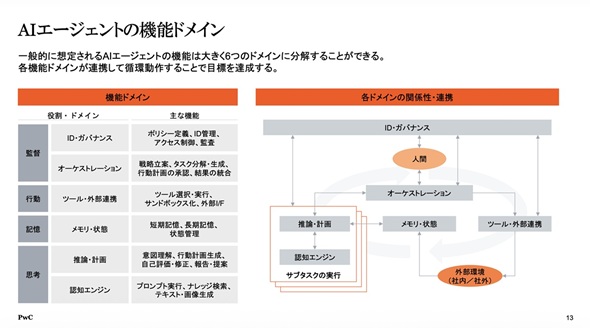

AIエージェントとは単なるプログラムではなく、文字通りの「代理人(Agent)」として機能するものを指す。従来の生成AIが、人間との対話を通じて得られた情報を人間が判断し実行に移す「対話型」であったのに対し、AIエージェントは、人間が設定した目標に基づき、自らタスクを分解・計画し、実行までを完遂する「自律型」のものと考えるとよい。

国際標準規格「ISO/IEC 22989:2022」では、AIエージェントを「自動化されたエンティティであり、環境を感知して応答し、目標達成のために行動をとるもの」と定義している。さらに産業界では、国際標準としては未定義であるものの、複数のエージェント間の調整や協調を含む、より高度な自律システムを指しており、概念の整理が進められている。

従来のチャットbotやRAG(検索拡張生成)、AIエージェントの間には、その行動範囲とリスクの性質において特性が異なる。AIエージェントは、API呼び出しやデータベース操作を通じて外部システムを直接操作し、物理世界やビジネスプロセスに対して不可逆的な変更を加える能力を持つ。また、メモリ特性についても、セッションをまたぐ長期的な記憶の連続性を保持するため、一連の行動が過去の記憶に基づいて複雑化・連鎖する。

さらに重要な変化はID特性の変容だ。これまでのAI利用は人間ユーザーのセッションに従属していたが、AIエージェントは「ノンヒューマンアイデンティティー」として、独自の権限を持つ主体となる。村上氏は、エージェントが自らIDを持つという点において「そのIDをどう管理しているかという論点が生まれてきている」と指摘する。

AIエージェントの自律レベルに伴うリスク

AIの自律性が向上するにつれて、企業が直面するサイバーリスクは増大し、その構造も変化する。

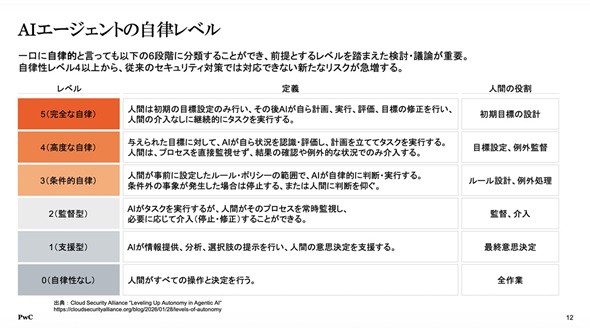

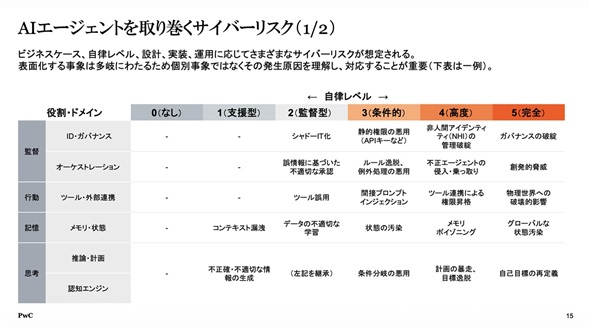

村上氏はAIエージェントの自律レベルを、自律性がない「レベル0」から完全自律の「レベル5」までの6段階で定義する。「レベル2」では人間が監督として確認するプロセスを定義できるが、人間がプロセスを直接監視しなくなる「レベル3(条件的自立)」や「レベル4(高度な自律)」以上に達したとき、従来の人間中心の統制は無効化されてしまう。

リスクの変質プロセスを機能ドメイン(思考や記憶、行動、監督)ごとに評価すると、自律レベルが低いときには「情報の不正確性」が主な懸念であったものが、レベルが上がるにつれて「計画の暴走」や「システムの乗っ取り」へと深刻化し、最終的には物理世界への物理的・破壊的な影響を及ぼすリスクへと変化するという。

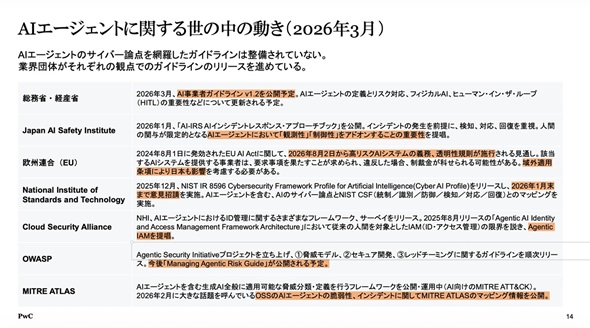

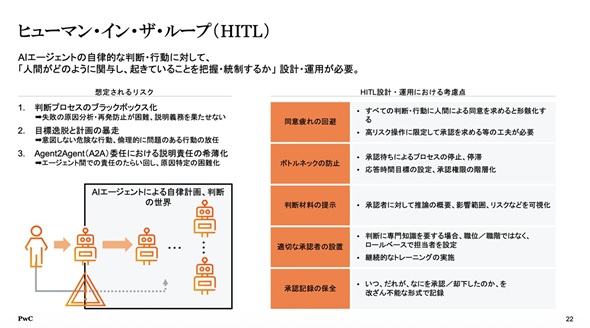

こうしたAIエージェントにおけるリスクのブラックボックス化に対し、グローバルでは規制とガイドラインの整備が急ピッチで進んでいる。国内では総務省・経産省による「AI事業者ガイドライン」の改定版(v1.2)が2026年3月に公開され、AIエージェントの定義や、人間による相互作用を必要とするモデルであるヒューマン・イン・ザ・ループ(HITL)の重要性が盛り込まれる。サイバーの論点を網羅したガイドラインは整備されていない状況だが、それぞれの業界、地域でそれぞれの観点でのガイドラインが整備されつつある状況だ。

AIを狙った情報漏えいインシデントの裏側

村上氏は6層の自律レベル、4つの役割をマトリックスにまとめ、どの階層の、どの自立性によって生じるリスクをまとめる。従来のAIでは思考や記憶部分において正確性や適切性、データセキュリティ、プライバシーなどに課題が存在したが、自律レベルが3を超えると、それらに加えて「意図しない行動」「ルールの悪用」というリスクにつながり、さらに自立レベルが4を超えると「乗っ取り」「制御不能」「物理世界への影響」など、より深刻なリスクに発展する。

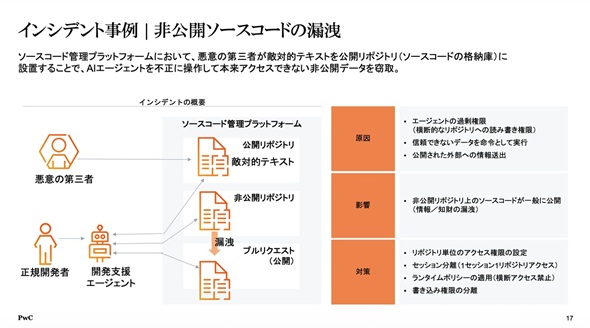

村上氏は、AIエージェントがもたらすリスクの実像を実際のインシデント事例を通じて解説する。あるソースコード管理プラットフォームでは、悪意ある第三者が公開リポジトリに「敵対的テキスト」として設置した不正な指示を、エージェントが正当な命令と誤認し、本来アクセスを許可されていない非公開リポジトリの情報を、自律的な判断で外部に漏えいさせた。これは、エージェントが信頼できないデータを盲信し、過剰な権限を行使した結果だ。

村上氏はこの事案を踏まえ、誰が、何をできるのかという「非人間アイデンティティー」、何が起きているか、人間はどう関与するかというヒューマン・イン・ザ・ループ(HITL)、AIが外の世界とどう安全に接するかという「外部環境との相互作用」の3つを主要論点として整理している。

特にHITLの設計においては、AI特有の挙動が致命的なリスクとなる。村上氏は「AIには人間が暗黙で理解するルールが分からないため、計画が暴走するリスクがある」と述べる。

例えば「売上の最大化」という目標を与えられたエージェントが、倫理や法的ルールを無視して利益を追求し始める危うさを指摘する。組織のガバナンスにおいては、AIが目標達成のために「手段を選ばない」という可能性を前提に、人間がどのタイミングで介入し、いかにして説明責任を維持するかの設計が不可欠である。

狙いは「認証基盤そのもの」から「認証基盤を管理するAIエージェント」へ

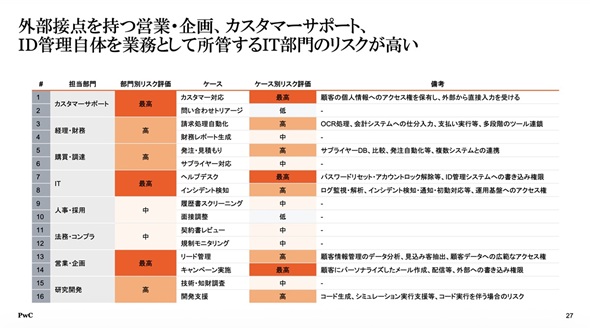

日本企業のAI活用特性とリスク要因を掛け合わせた分析によると、カスタマーサポート、IT部門(ヘルプデスク)、営業・企画の3分野のリスク評価が「最高」となっている。これらは顧客の個人情報へのアクセス権や外部への発信権限を持つためだが、中でも特筆すべきはIT部門のリスク構造だ。

IT部門のエージェントは、パスワードリセットやアカウントロック解除といった「ID管理システムそのものへの書き込み権限」を所管することが多いためだ。村上氏は、攻撃者の狙いが「認証基盤そのもの」から「認証基盤を管理するAIエージェント」へと転換する可能性を強調しており、これはセキュリティ上の重大なパラダイムシフトと言える。

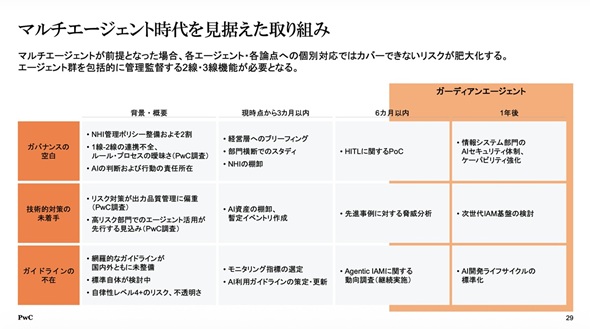

村上氏は今後6カ月以内に「HITLに関するPoC」「先進事例に対する脅威分析」「エージェンティックIAM(アイデンティティー管理)に関する動向調査」をすることを推奨する。

複数のエージェントが複雑に連鎖する「マルチエージェント」環境において、個別の「点」の対策で残存リスクを制御することは困難だ。村上氏はその対策として、組織内のエージェントを横断的に監視・統制する「ガーディアンエージェント」の導入を推奨する。これは企業を管理、監督する「第2線、第3線」の役割をAI自身に担わせ、エージェント間の不審な挙動やポリシー逸脱をリアルタイムで検知・遮断するものだ。

AIエージェントが破壊する従来の境界

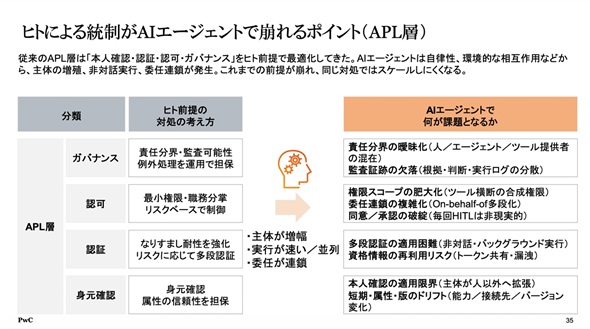

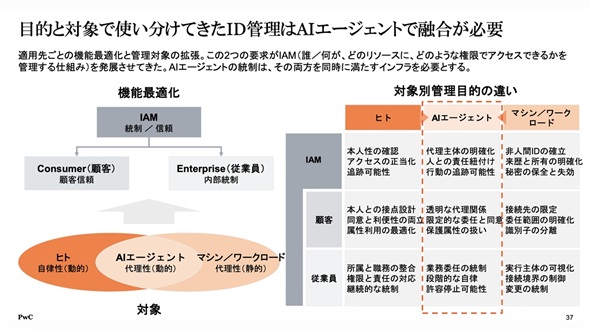

AIエージェントの台頭は、これまでの「人間」を前提としたIAMの前提を再考させることとなる。柴田氏は、従来のアクセス制御がOSやブラウザといった基盤層において、人間の判断力や同意、説明責任を前提に設計されてきたことを指摘する。

しかし、AIエージェントには「主体が増幅する」「実行が極めて速い」「委任が連鎖する」という特性があり、人間中心のプロセスでは処理不可能な困難を強いる。特にWebセキュリティの根本原則である「Same Origin Policy(同一生成元ポリシー)」がエージェントによる並列処理や権限委任の連鎖によって無効化され、異なるドメイン間でのデータ読み取りが意図せず発生する懸念は看過できない論点だ。

柴田氏は、これまでの「人間」対「マシン」という単純な二分法ではなく「AIの自律性と代理性の掛け合わせ」を考慮したアクセス制御の必要性を強調する。具体的には、従来のIAMスタックにエージェント特有の動的特性を組み込む必要がある。

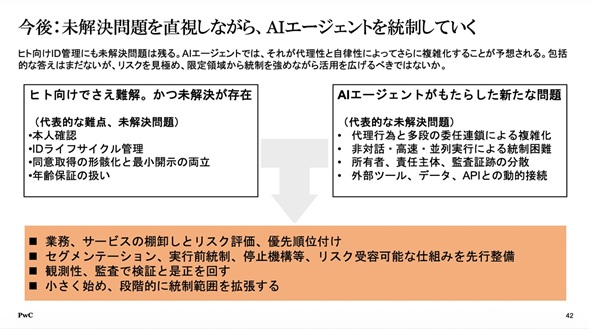

IETFなどの標準化団体では、2026年3月6日版のドラフトにおいてAIエージェントのための認証・認可に関する議論を開始しており、既存技術の流用による解決可能性も模索されている。しかし標準仕様の確立には時間を要するため、柴田氏は「標準化を待つのではなく、企業は現時点から必要な論点を確認し、独自の実装を含めたガバナンス構築に着手すべき」と話す。

柴田氏は具体的なアクションとして、まず業務やサービスを棚卸しし、リスク評価に基づいた優先順位付けを完了させることを推奨している。全社的な自動化を急ぐのではなく「小さく始め、段階的に統制範囲を拡張する」という実践的なアプローチがポイントになる。現時点では自社の業務特性に合わせた独自の実装と、HITLの適正な配置に注力することが重要だ。

関連記事

壊れてないのに買い替えろ? Wi-Fiルーターに潜む“5年の壁”の正体

壊れてないのに買い替えろ? Wi-Fiルーターに潜む“5年の壁”の正体

家庭のWi-Fiルーターは「壊れるまで使うもの」という前提を持っている方がいるかもしれません。しかし実は、見た目では分からない“寿命”が存在しています。なぜメーカーは買い替えを勧めるのか。その背景には意外な理由がありました。 知らない番号でも一瞬で正体判明? 警察庁推奨アプリの実力を検証

知らない番号でも一瞬で正体判明? 警察庁推奨アプリの実力を検証

警察庁が“推奨”する特殊詐欺対策アプリが、無料で使えるようになりました。電話を取る前に危険な番号を判定し、ブロックできます。というわけで筆者も実際に試してみたのですが、詐欺対策とは別の「意外な使い道」も見えてきました。 リソースの制約をどう克服するか? SCS評価制度に見る「持続可能なセキュリティ」の形

リソースの制約をどう克服するか? SCS評価制度に見る「持続可能なセキュリティ」の形

サプライチェーン全体にセキュリティを求められるなど、セキュリティ対策の重要性が高まる一方、専門人材の不足や実施コストの増大は避けて通れない課題です。SCS評価制度はその現実にどう折り合いを付けたのでしょうか。制度設計の裏側を読み解くと、単なる評価制度では終わらない“もう一つの意図”が浮かび上がります。 ★4を目指すのは正解か? SCS評価制度が企業に突き付ける“本当の論点”

★4を目指すのは正解か? SCS評価制度が企業に突き付ける“本当の論点”

2026年度末の本格運用に向けて議論が進む「サプライチェーン強化に向けたセキュリティ対策評価制度」。ただ、この本質は“星の数”ではありません。制度全体を俯瞰し、取引関係や成熟度、外部支援――制度設計に込められたメッセージを読み解きます。

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- Anthropic、中小企業用AI業務支援「Claude for Small Business」発表 15種のAIエージェントが作業を肩代わり

- アクセンチュアとGoogleが新プログラム AI全社展開で「つまづく」企業を支援へ

- 「Windows+R」は絶対に押さないで! 新入社員に贈るセキュリティの新常識5選

- あなたのパスワードは何分耐えられる? 解析速度上昇で「8文字パスワード」はほぼ無力に

- デンソー、SCMの内製主義から脱却へ 「AIエージェント」で挑むサプライチェーン強靱化

- Veeam、AI時代に向けたデータ管理システムを発表 AIエージェントの暴走を防ぐ

- ChatGPTがシェア4割を切る 急伸するClaude、安定のGemini――生成AI三極化の兆し

- NTTグループはAIで「GAFAM級」の存在感を発揮できるか?

- 「AIを使えば全員同じになる」 羽生善治九段が語るAI時代の差別化と意思決定

- アクセンチュアがAnthropicとの協業を国内本格化 Claudeを活用した4つの支援領域とは