Google、「Gemma 4」を発表――高度な推論とエージェント機能を備える4種のモデル:AIニュースピックアップ

Googleは「Gemma 4」を公開した。4サイズで推論、コード生成、画像理解に対応し、小型は端末動作、大型は高性能を担う。少ない計算資源で高い性能を狙う設計だ。

この記事は会員限定です。会員登録すると全てご覧いただけます。

Googleは2026年4月2日(現地時間)、オープンモデル群「Gemma 4」を発表した。高度な推論とエージェント処理を主眼に据えた新世代モデルで、Apache 2.0ライセンスの下で公開する。Gemmaシリーズは初代公開後、累計4億回超のダウンロードと10万超の派生モデルを生み出しており、今回のGemma 4は、その流れを受けた新たな主力モデル群となる。

E2Bから31Bまで、用途別に分かれるGemma 4

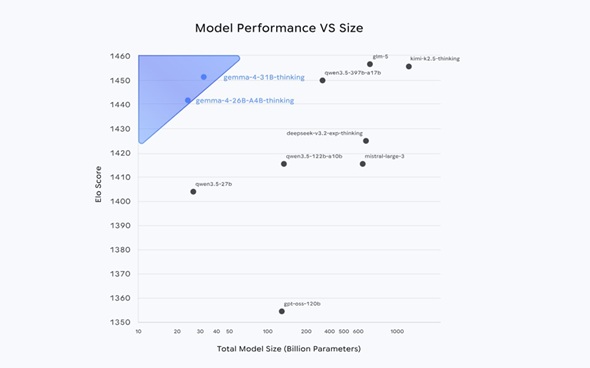

今回の発表において、性能とモデル規模の関係が大きな焦点となる。掲載図ではGemma 4 31BはEloスコアで1450前後を記録しており、26B MoEとともに、より大規模なオープンモデル群と肩を並べる高い性能を示している。Googleは、少ないパラメーター量で高い性能を引き出す設計をGemma 4の中核価値に据える。

モデルは4種類で、E2B、E4B、26B MoE、31Bをそろえる。E2BとE4Bの「E」はeffective parametersを示し、端末実装時の効率を重視した小型モデルだ。26B MoEはMixture-of-Experts構成を採用している。31BはDense構成の大型モデルで、品質の最大化を狙う。

用途ごとの棲み分けも明確だ。E2BとE4BはスマートフォンやIoT機器、ノートPCなどでのローカル実行を想定し、メインメモリ消費や電力効率、低遅延を重視する。E2Bは実効2.3B、E4Bは実効4.5Bで、いずれも128Kコンテキストに対応する。26B MoEは総パラメーター25.2B、推論時の有効パラメーター3.8Bで、速度面に強みを持つ。31Bは30.7Bで、256Kコンテキストを備える。

機能面では推論モード、コード生成、関数呼び出し、構造化JSON出力、システムプロンプト対応を実装し、エージェント処理に必要な基本機能をそろえた。全モデルがテキストと画像を扱い、E2BとE4Bは音声入力にも対応する。動画理解、OCR、文書やPDFの解析、UI理解、図表読解、手書き認識なども主要な能力に含まれる。多言語対応は事前学習で140超の言語におよぶ。

ベンチマークでも大型モデルが高い数値を示した。MMLU Proは31Bが85.2%、26B MoEが82.6%、AIME 2026は89.2%と88.3%、LiveCodeBench v6は80.0%と77.1%、GPQA Diamondは84.3%と82.3%だった。視覚系ではMMMU Proで76.9%と73.8%、MATH-Visionで85.6%と82.4%を記録した。長文評価MRCR v2 8 needle 128kでは31Bが66.4%、26B MoEが44.1%だった。

Googleは、26Bと31Bの非量子化bfloat16重みが単一の80GB NVIDIA H100 GPUに収まり、量子化版はコンシューマー用GPUでも動かせると説明する。小型モデル群はGoogle Pixel、Qualcomm Technologies、MediaTekとの連携を通じ、スマートフォンやRaspberry Pi、NVIDIA Jetson Orin Nanoなどでオフライン動作を狙う。Gemma 4は、端末から開発用ワークステーションまで幅広い計算環境にまたがるオープンモデル群として展開される。

関連記事

米2強が狙う“AI社員”の普及 Anthropicは「業務代行」、OpenAIは「運用プラットフォーム」

米2強が狙う“AI社員”の普及 Anthropicは「業務代行」、OpenAIは「運用プラットフォーム」

AnthropicのCoworkとOpenAIのFrontierは、AIが実務をこなす時代の到来を象徴している。ビジネスの現場はどう変わるのだろうか。 Microsoftがまたもや値上げ M365サブスク料金を最大33%増の「言い分」

Microsoftがまたもや値上げ M365サブスク料金を最大33%増の「言い分」

Microsoftは、2025年11月の大口顧客向けのディスカウント廃止に続き、2026年7月からMicrosoft 365の複数プランを値上げする。最大で33%の値上げを実施する理由を同社はどう説明しているのか。 内製化拡大で2桁成長 それでも「ノーコードツール」の先行きが暗い理由

内製化拡大で2桁成長 それでも「ノーコードツール」の先行きが暗い理由

国内のローコード/ノーコード開発ツール市場が1000億円規模に迫る急拡大を続けている。しかしITRは、「将来的にこの市場の一部の需要は将来的に失われる」と指摘する。なぜ内製化が広まる中で、将来一部の需要が失われるのか。 品川区とSHIFTが生成AI実証実験 電話対応自動化で行政サービス向上図る

品川区とSHIFTが生成AI実証実験 電話対応自動化で行政サービス向上図る

SHIFTと品川区は、生成AIを活用した電話対応自動化の実証実験を開始した。AWSの各種サービスを使い、戸籍住民課の問い合わせ対応を高度化する。庁内で精度を検証し、2026年前半の住民公開を目指す。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- Google検索、25年ぶりの大刷新 「ググる」から「AIエージェントに任せる」へ

- 2027年からの「IT資格大アプデ」は改良か、改悪か?

- 「AIでAIと戦う」時代の幕開け Google CloudとWizが目指す自律防御の世界

- アクセンチュアらが「エージェント型工場」を開発 製造現場の計画外停止の削減図る

- まずは「重要資産の棚卸し」を NISTが示す「個人事業主」レベルの防衛ライン

- Cloudflareが明かす「Mythos Preview」の実力 AIが脆弱性発見から攻撃実証まで自律実行

- Anthropic、中小企業用AI業務支援「Claude for Small Business」発表 15種のAIエージェントが作業を肩代わり

- なぜ高度なAIを導入しても成果が出ない? 日本企業が陥る「デジタルフリクション」の罠

- 中小企業の約65%が「情シス不在」 デジタル化でも残る課題との関連は?

- 「Windows+R」は絶対に押さないで! 新入社員に贈るセキュリティの新常識5選