人型ロボに3D映像を合成 NTTの「バーチャルヒューマノイド」

NTTグループの展示会「コミュニケーションEXPO」(東京国際フォーラム、12月20日〜22日)で、人型ロボットと映像を合成する「バーチャルヒューマノイド」を体験できる。シースルーのヘッドマウントディスプレイ(HMD)を通して人型ロボットを見ると、ロボットに人間の3DCG映像を重ねて表示。ロボットの動きに合わせて映像も変化する。まるで本物の人間がそこにいるかのような感覚を味わってもらう狙いだ。

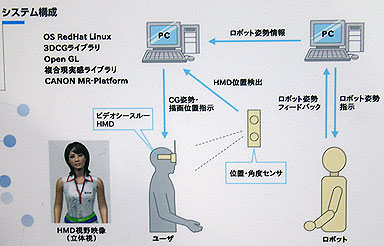

センサーで検知したHMDの位置や角度と、ロボットの姿勢とを組み合わせ、自然に見える角度・大きさの人間の3DCG映像をHMDに表示する。映像はモーションキャプチャーを活用し、なめらかに動くようにした。

実際にHMDを着けてロボットに触ってみると、肩や腕がゴツゴツしていたり、頭が柔らかすぎたりして“すぐ目の前にリアルな人がいる感覚”には少し遠い。ディスプレイは表示が少々荒く、背景とのバランスもやや不自然だ。

今後は画像チューニングを行ったり、相手の動きに合わせてロボットが動きを変えられるようにするなど改良を続け、目の前に人がいる感覚に近づけていく。

体感ゲームや映画プロモーション利用などを想定する。例えば、人型の投球ロボットにプロ野球選手の映像を重ねて“有名選手が投球するバッティングゲーム”を作ったり、ロボットに俳優の映像を重ね合わせ、映画のワンシーンを体感できるアトラクションを作る――などといった応用を考えている。

ちょっぴりアダルトな使い方もできそうだが、「そういう方向に行かないよう、(健全な)活用法をこちらからどんどん提案していきたい」と説明員。将来は、離れた場所に住む家族や友人の映像をロボットに重ね合わせ、彼らがまるで側にいるようにコミュニケーションできるサービスの実現を目指す。

“バーチャルコスプレ”は博物館やイベントで人気

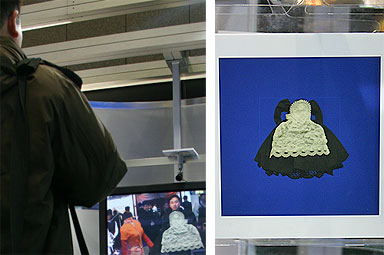

3Dの“バーチャルコスプレ”が楽しめるブースもある。自分を映しているカメラに向かって眼鏡っ子の画像カードをかざせば、自分の顔だけを眼鏡っ子に変えたり、ドレスのカードをかざせば、3Dドレスを着用してみたりできる(関連記事参照)。

カメラがカードの画像を読み取り、対応する画像をデータベースから抽出。画像の周囲に描かれた四角い枠の大きさと傾きを検知してカードとの距離や位置を算出し、対応する3D画像を背景に合成して表示する仕組みだ。

3D画像合成技術の応用法として考えついたサービスで、すでに科学館や博物館への導入が決まっているほか、テレビ局のイベントでも利用されるなど、引き合いは強まっているという。

関連記事

イチロー、「香り通信」に驚く

イチロー、「香り通信」に驚く

NTTグループのイベントにイチロー選手が登場。「香り通信」を体験し、「これが僕の必要としているにおい!?」と驚いていた。 “変身ディスプレイ”にアキバ系専用SNS――東京コンテンツマーケット

“変身ディスプレイ”にアキバ系専用SNS――東京コンテンツマーケット

IT系新技術からアキバ系新サービスまで、多様な出展が楽しめる「東京コンテンツマーケット 2005」が20日まで開かれている。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR

右ディスプレイに映っているのが、HMD上の映像。HMDを付けている人が感じる世界は左ディスプレイのようになる

右ディスプレイに映っているのが、HMD上の映像。HMDを付けている人が感じる世界は左ディスプレイのようになる システムの仕組み

システムの仕組み カード付き眼鏡を身につけてカメラの前に立つと、顔の部分がカードの中の絵に変わる

カード付き眼鏡を身につけてカメラの前に立つと、顔の部分がカードの中の絵に変わる メイド服を“着る”男性も

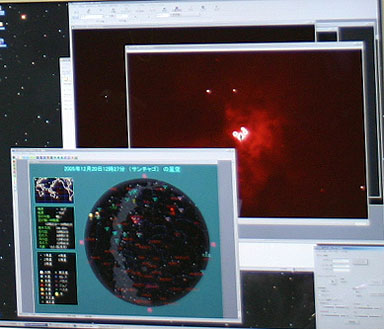

メイド服を“着る”男性も チリの天文台ネット経由で遠隔操作し、撮影した天文画像をリアルタイム受信するデモも

チリの天文台ネット経由で遠隔操作し、撮影した天文画像をリアルタイム受信するデモも チリの銅山のリアルタイム映像を受信中。21日からは、この会場から銅山の掘削機を遠隔操作する掘削体験ができる

チリの銅山のリアルタイム映像を受信中。21日からは、この会場から銅山の掘削機を遠隔操作する掘削体験ができる