米AMD、AIモデル「Instella」シリーズ公開 パラメータ数30億の小規模サイズ 同社製GPUを利用

米AMDは3月5日(現地時間)、AIモデル「Instella」シリーズを公開した。同社のGPU「AMD Instinct MI300X」を使いトレーニングしたのが特徴。パラメータ数30億の「Instella-3B」は、他社が公開する同等サイズのAIモデルと比べて、おおむね性能を上回っているとしている。

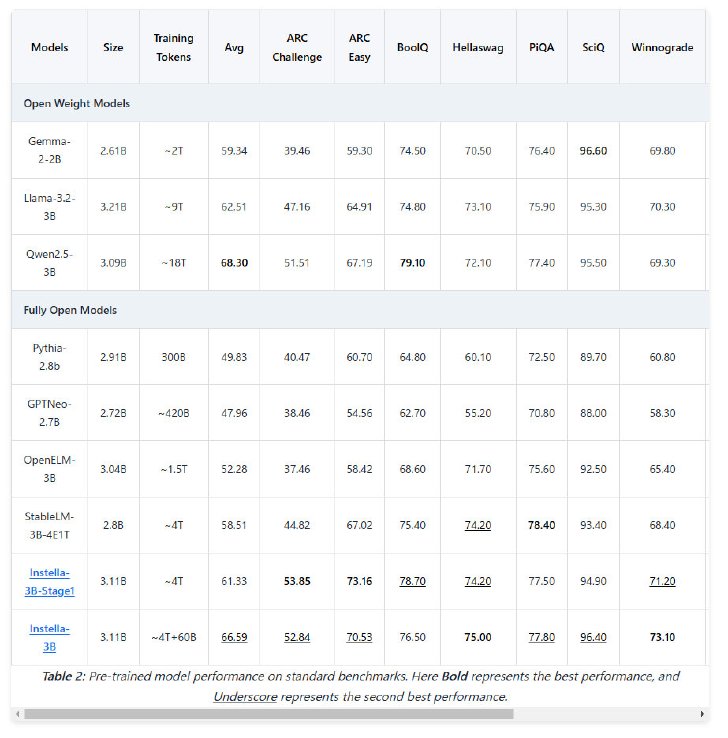

今回公開したAIモデルは、4065兆トークンで1段階だけ事前トレーニングをした「Instella-3B-Stage1」、さらに575億7500万トークンで事前トレーニングを重ねたInstella-3Bなど。いずれのAIモデルも、Llama-3.2-3BやGemma-2-2Bと同等か、それを上回る性能を記録し、Qwen-2.5-3Bに迫る性能を記録したという。

他にも、Instella-3Bの指示学習済みAIモデルとして「Instella-3B-SFT」「Instella-3B-Instruct」も公開中だ。

AMDは「Instellaのリリースは、オープンソースAIの進歩と、大規模な言語モデルトレーニングにおけるAMDハードウェアの能力を実証する上で、大きな一歩を示している」と説明。AIモデルを公開した理由については「透明性、再現性、アクセシビリティーがAI研究開発の進歩の重要な原動力であると考えているため」などと述べている。

Copyright © ITmedia, Inc. All Rights Reserved.

この記事の著者

関連記事

こんなメディアも見られています

ITmedia AI+に関連する情報をお探しであれば、こちらのメディアもお役に立てるかもしれません。

SpecialPR

よく見られているカテゴリー

アクセスランキング

-

1

2年間で「1万時間」削減 「1円の誤りも許されない」ソニー経理が“まず試してみる”DX集団に化けたワケ

-

2

Google Chromeの新機能「Skills」 AIプロンプトの“毎回手打ち”を不要に

-

3

東大松尾研が「LLM講座 基礎編」の講義資料を無料公開 期間限定で

-

4

AIコスト高騰で中国DeepSeekへの“乗り換え”続出か 米国決済サービスの支出調査で明らかに

-

5

ローカルLLMは本当に手元で動くのか? ハードウェアとモデルの現実的な選び方【2026年春】

-

6

「家庭教師のトライ」が学力診断にAI活用 20問解くだけで弱点を推定 生徒と講師の負担減らす

-

7

人型ロボブームを“先駆者ホンダ”はどう見る? 「悔しさもあるが……」 次の一手を聞いた

-

8

なぜ一部のAIモデルは「日本文化」に執着するのか? 「4o-mini」などの出力が日本に偏る実態、欧州チームが研究発表

-

9

検図から積算まで支援する図面解析AI、工数を最大60%削減

-

10

Claude Opus 4.8は忖度(そんたく)しません “正直すぎる”のも善しあし?

SpecialPR

ITmedia AI+ SNS

インフォメーション

注目情報をチェック

ITmedia AI+をフォロー

あなたにおすすめの記事PR

@itm_aiplusをフォロー

@itm_aiplusをフォロー