2026年はAGIが“一部実現” AIの革新を乗りこなすための6つの予測:エンタープライズAI 導入実務の勘所

2026年の生成AIはどう進化するのか。AIエージェントの一般化やAGIの誕生、フィジカルAIまで、技術革新のロードマップを予測。激変するビジネス環境で企業が生き残るための重要キーワードと活用戦略を整理する。

この記事は会員限定です。会員登録すると全てご覧いただけます。

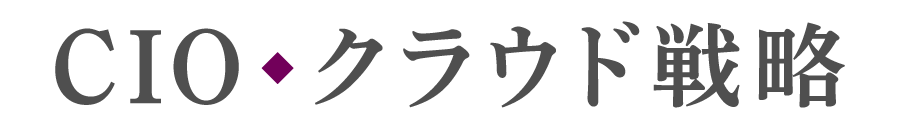

企業における生成AI活用の実践的なアプローチを解説する本連載。2026年1回目の本稿では、2026年に起こり得る生成AIの技術革新のキーワードを予測し、ロードマップとして整理しました。

企業の生成AI推進担当者は、このロードマップに記載されているキーワードを把握しておくことで、引き続き変化が激しい2026年を乗り切れるかもしれません。以降では、各キーワードについて解説していきます。

筆者プロフィール

内田 匠(Takumi Uchida)

インキュデータ株式会社 R&D室、筑波大学 非常勤講師

京都大学総合人間学部(学士)、筑波大学社会人大学院(博士、システムズ・マネジメント)。情報処理学会、人工知能学会などに論文採録実績。Web広告代理店にて広告設計と効果改善業務。リクルートにてデータサイエンティスト、エンジニアとしてAIアルゴリズムを開発。2021年よりインキュデータに参加し、新規事業開発を担当。

大手メディアにおける広告効果の可視化BIツール開発、結婚情報誌に掲載されている画像の解析アルゴリズム、アルバイトのシフトを自動配置するアルゴリズム開発を担った他、深層学習を使った競馬の着順・回収率予測やChatGPT3.5を使った競馬の予測コメント自動生成で実績。インキュデータではデータクリーンルームを使った分析手法の開発や生成AIを使った新規事業/業務効率化の検討に従事する。

予測1:企業におけるAIエージェント活用の一般化

ここでは、「AIエージェント」「AI駆動」「MCP」(Model Context Protocol)、「データのAI-Ready化」などのキーワードについて解説します。

これらのキーワードは、「人間の監督の下、業務をAIエージェントに任せる」というテーマに関わるものです。中心となるキーワードは「AIエージェント」であり、AIエージェントを使った新しい業務スタイルを「AI駆動」と呼び、AIエージェントに業務に必要なデータやツールを連携する技術が「MCP」です(注1、2)。MCPはModel Context Protocolの略で、日本語に訳すと「大規模言語モデル(LLM)に文脈情報を提供する通信方式」となります。AIエージェントの業務性能を高めるために、データをAIが扱いやすい形に整備することを「データのAI-Ready化」と呼びます。

AIエージェントは2025年にも注目され、既に主要な業務プラットフォームがAIエージェント機能を提供し始めています。以下に、その具体例を幾つか挙げます。

- 汎用業務ツール、コミュニケーションツール

- 「Microsoft 365 Copilot」「Gemini for Google Workspace」: 電子メールやスケジュール、ドキュメント、リモート会議などを横断的にAIが支援

- 「Slack」「Zoom」: チャットや会議の要約、検索、タスク化を支援

- CRM、業務管理ツール

- 「Salesforce」の「Einstein Copilot」など: 営業活動や顧客サポートにおいて、顧客向けのメッセージや次のアクション提案を支援

- 「ServiceNow」の「Now Assist」など: ITSMやESMにおいてチケット対応やナレッジ活用を支援

- 「Atlassian Intelligence」「Notion AI」など: ノートの要約、課題整理、文章生成などの支援

- 開発業務

- 「GitHub Copilot」「Devin」など: 実装やレビュー補助、テスト生成、リファクタ提案などを支援

生成AI推進担当者は、これらのツールを比較検討し導入することが求められます。この際、既存の業務フローを再設計し、AIエージェントに任せるタスクと人間が担う責任を定義する必要があり、このようなプロセスを「既存業務のAI駆動化」や「AI-BPR」「AI-DX」などと呼びます。

また、AIエージェントが対応できるタスクを増やすために、外部データやツールを連携する必要があり、これは「RAG」や「ReAct」という技術で実現できます。ただし、RAGだけでは情報漏えいリスクや性能、運用性に限界がありました。例えば、AIエージェントは、そのエージェントを操作する従業員が利用を許可されているデータやツールしか使えないようにする必要があります。前述したMCPはこのような連携も可能にします。

AIエージェントがデータを正しく理解し、適切に活用できるようにするために、データの品質や形式を整備する必要もあります。例えば、生成AIはプレゼンテーションファイルのような図表中心の資料も参照できますが、プレーンテキストと比較すると読み取りの精度が落ちる可能性があります。テキストファイルへの変換などのAI向けのドキュメント管理が望まれます。このような管理業務を「データのAI-Ready化」と呼びます。「AI向けナレッジマネジメント」とも表現できそうです。

なお、「AI-Ready」はデータだけに関わるものではなく、組織体制やセキュリティ・ガバナンスの整備を含む、広い投資テーマです(注3、4)。

予測2:AGIの事例が創出され始める

ここでは、「AGI」(Artificial General Intelligence:汎用人工知能)、「常時推論」「GraphRAG/AI用オントロジー」(注5)などのキーワードについて解説します。

これらのキーワードは、「AIが自律的に365日24時間、企業内の情報を観測し続け、必要に応じて知識の更新とタスクを自律実行する」テーマに関わるものです。AGIは「人間のように広範囲のタスクを実行でき、自律的に情報を収集して学習し、タスクを設計できるAI」です。長年、AGIの実現はAI研究の目標でしたが、NVIDIAとPalantir Technologiesが発表した「常時推論」と「AI用オントロジー」は、部分的にAGIを実現した例と考えられます(注6)。

Palantir Technologiesはこの常時推論用オントロジーのサービスを既にリリースしており(注7)、これを活用したAGIの導入事例が、特定の業界や業務領域で生まれる可能性があります。現時点では、システムや設備の保守、物流、金融、医療などの分野での活用が想定されているようです。

オントロジーと常時推論で実現する“人間不在”の業務フロー

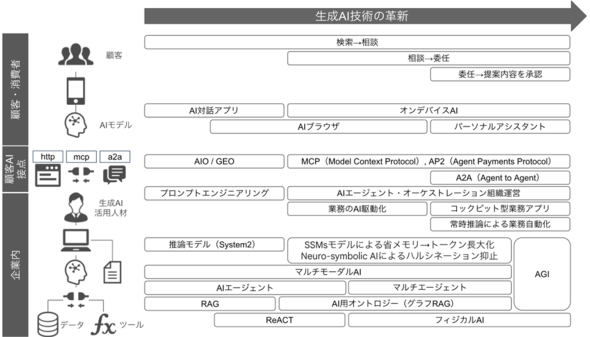

不動産情報の検索Webサービスを例に、「会員ユーザーの物件閲覧イベントを起点にして、常時推論で物件レコメンドダイレクトメールを自動送付する」というシナリオを考えてみましょう。このシナリオを実現するアルゴリズムは以下の図の通りです。

オントロジー(あるいはGraphRAG)とは、上図の上部にあるような、「物件item」「user」「メールアドレス」などのキーワードを繋げたネットワーク構造のことです。例えば、「user1が過去に閲覧した物件itemのリスト」であれば、「MATCH ({user:01})-[:VIEWED]->(i:Item) RETURN i」のようなクエリで取得できます。

重要なのは、AIエージェントに「データ取得」だけでなく「情報の追加」も許可していることです。上図でも「user1が新たに物件item3にアクセスした」というイベントを認識したAIが、オントロジーに「({user1})-[:VIEWED]->({item3})」を追加しています。つまり、AIがイベントに応じて自身の知識を更新しているのです。これが、オントロジーを使ったAIによる自律的な知識更新の仕組みです。

常時推論するAIは、人間が明示的にスイッチを押さなくても起動します。上図では、user1が物件item3を閲覧したイベントログがトリガーとなり、オントロジーに「user1がitem3を閲覧した」という情報を追加し、更新されたオントロジーからuser1の行動履歴を取得して次の行動を思考し、item3に似た物件をレコメンドするメールを生成し、user1のメールアドレスに送信しています。これにより、人間が介在せずにAIが主体となってマーケティング施策を実行します。

予測3:AIエージェント・オーケストレーション組織

AIエージェントが業務の“実行者”として普及し、AGIがイベントに応じて知識を更新し、タスクを継続的に自律実行するようになると、「人間の部下と同等の能力を持ったAIエージェントをどのようにマネジメントするか」が新たな課題になります。これは既存のマネジメント理論とは根本的に異なるでしょう。

少なくとも、労働時間やメンタルヘルスの管理は不要です。粘り強い傾聴姿勢によるコーチングスキルも、おそらく無用です。代わりにトークン料金の最適化やAIの問題行動監視などが必要になります。この課題は徐々に認識され始めていますが、まだ正式な名称はありません。ここでは便宜的に「AIエージェント・オーケストレーション組織」と呼ぶことにします。

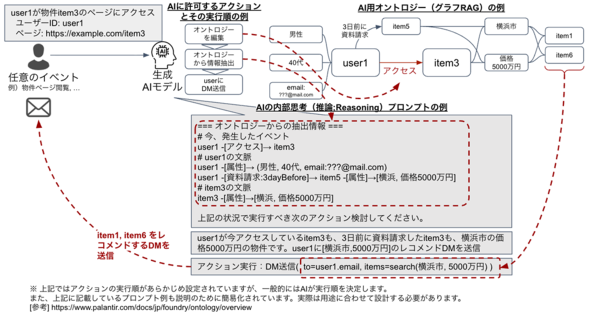

この課題を解決するために必要なツールは「AIエージェントマネジャー用の管理ツール」です。 これは、“人のマネジメント”で使われたタレントマネジメントツールやタスク管理ツールのAIエージェント版です。自分が管理すべきAIエージェントが、何を実行し、それがどのような結果になったのかを一覧できるツールです。その例として、ここでは「Vibe Kanban」を紹介します。

Vibe Kanbanは、システム開発業務のためのAIエージェント管理ツールです(注8)。システム開発業務は、AIエージェント活用が最も進んでいる分野の一つであり、そのための管理ツールも早期に登場しました。Vibe Kanbanを使えば、AIエージェントが設計した業務タスクごとに進捗を可視化し、その完了結果の確認と人間による承認が可能になります。「AIが設計し、AIが実行し、人間が監督する」というAI駆動型業務マネジメントの典型的な例と言えます。

予測4:社外の取引先との接点のAI化

ここでは、「AIO/GEO」(AI Optimization/Generative Engine Optimization)、「A2A」(Agent to Agent)、「AP2」(Agent Payments Protocol)、「AIブラウザ」「オンデバイスAI」「パーソナルアシスタント」などのキーワードについて解説します。

予測1〜3が主に社内の業務を対象としていた一方、今回の予測は顧客やパートナー企業などの社外の取引先との接点が、AIを前提に再設計される、というものです。

既に一部のユーザーの購買行動は「Google検索」から「ChatGPT」への相談に変わりつつあります。企業のマーケティング担当者は自社の商品とサービスを検索エンジンに最適化するだけでなく、生成AIエンジンにも最適化する必要が出ています。

OpenAIのAIブラウザ「ChatGPT Atlas」が示唆するように、ユーザーがWebブラウザの操作をAIに代行させる機会も増えるかもしれません。「Google Chrome」のAIエージェント機能が一部地域でリリースされたことも象徴的です(注9)。ただし、2026年にこういった顧客行動が一般化する可能性は低いと私は考えています。快適な顧客体験を実現するためには、ブラウザに常駐するAIエージェントの高速化が必要なるからです。

スマートフォンにAIが搭載(オンデバイスAI)され、クレジットカードなどの個人情報と決済機能、AIがAP2のようなプロトコルを介して連携することで、顧客の購買行動を代行するAI(パーソナルアシスタント)を実現することが技術的には可能になりました。AppleやGoogleなどのプラットフォーマーはこの分野での投資を進めています。その動向に注目すべきでしょう。

企業は、顧客や社外パートナーとの接点最適化だけではなく、彼らのAIエージェントとの接点最適化に備える時期かもしれません。自社のAIエージェントを外部公開する必要もあるかもしれません。AIエージェント同士がWebで対話する新しい通信規格A2Aについても導入を検討するべきでしょう。

“AIが注文し、AIが応答する”世界はもうそこまで来ている

社外の取引先との接点のAI化を示す例を幾つか紹介しましょう。

生成AIによるspeech-to-speech技術の発展により、入力した音声に対してリアルタイムで返答音声を生成できるようになりました。これにより、顧客からの電話問い合わせに対して、AIが自動応答できます。

Gen-AXの「X-Boost」というツールは、あらかじめ自社の商品やサービスの内容を登録しておくことで、AIは顧客からの音声質問に対して、登録した情報を基に回答します。導入時にはGen-AXが用途に合わせた専門的なチューニング(調整)を実施し、回答の精度を高めます。

顧客がChatGPTや「Gemini」で購入手続きを完了させる技術も実用化段階に入りました。例えば、Eコマースの運営会社はGoogleのUCP(Universal Commerce Protocol)への対応を進めることで(注10)、Geminiで購買手続きを完結できるようになります。自社商品やサービスをGeminiにリコメンドさせやすくするための施策(AIO/GEO)についても検討を進めるべきでしょう。

社外のパートナー企業に対して、自社が開発したAIエージェント機能を開放することも可能になっています。例えば、販売を委託している小売企業の従業員が、業務アプリケーションとしてChatGPTを使っているとします。このパートナー企業が利用しているChatGPTに自社のデータベースを連携し、在庫確認や発注処理、納期回答、新商品の案内などをさせたい場合は、自社のMCPサーバを開発し、そのMCPサーバに自社のAIエージェントを配置します。

ただし、セキュリティやガバナンスについて慎重に検討する必要があります。弊社でも技術検証を実施しましたが、本稿執筆時点(2026年1月13日)ではセキュリティ対策の追加開発が必要でした。

予測5:生成AIモデルの成長速度は停滞するのか?

ここでは、「SSM(State Space Model)」「学習テキスト枯渇問題」「半導体/電力の限界問題」などのキーワードについて解説します。

生成AIモデルの成長速度が2026年以降は停滞するのではないか、という予測をする人も一部います。 この背景には、LLMに学習させるテキストデータの枯渇問題と、モデルの巨大化に伴う半導体性能と電力消費の限界という、2つの問題があります。

筆者の個人的な見解としては、この2つの問題を根拠に「生成AIモデルの成長速度が停滞する」と結論づけるのは、まだ早計ではないかと考えています。

まず、この2つの問題は、既存の生成AIモデルが「Transformer」をベースにしていることに起因しています。Transformerは、Googleが2017年に発表したモデルです。簡潔に説明すると、このモデルは膨大なテキストデータを処理させればさせるほど性能が上がり続ける、という特徴があります。この技術を基に、これまでのLLMは世の中の論理的な文章を可能な限り集めて学習させ発展してきました。その結果、これ以上学習すべきテキストデータが存在しない、という問題が懸念されているわけです。

とはいえ、この枯渇問題はもっと前から指摘されてきましたし、この問題の対処方法として推論モデル(Reasoning model/Thinking mode《内部思考生成》)が提案され、また一段と性能が向上しています。OpenAIの「gpt-o1」がその代表例です。加えて、昨今の生成AIモデルの進化はテキスト学習だけでなく、画像や音声、動画などのマルチモーダル学習が進んでおり、AIが考慮できる文脈情報が多次元、非構造化しています。したがって、データ枯渇問題の影響は限定的であると私は考えます。

本質的な問題は、Transformerの巨大化に伴う半導体性能と電力消費の限界です。Transformerは入力テキストの長さに対して、計算量が二次関数的に増加します。さらに、内部思考テキストの生成・再入力により、処理すべきテキストが再帰的に長大化しました。これにより、モデルの消費電力と必要メモリと生成速度が大幅に悪化したことが、生成AIの性能限界の本質的な原因であると私は考えます。

この問題に対処するために、ポストTransformerとして「SSM」(状態空間モデル)が注目されています(注11)。このモデルはテキストが長大化しても、計算量の増加が二次関数的ではなく一次関数的なので、劇的に効率化できます。物理的な解決策として、Googleの「TPU」など、より推論処理に特化した半導体の開発なども検討されています。

このようなAIの性能問題は常に指摘されてきましたが、その都度、新しい解決法が提案され、生成AIモデルの成長は続いています。現在の問題もどのように解決されるのか、あるいは性能限界を迎え、現場での最適化フェーズに入るのか、引き続き注目していきたいです。

予測6:フィジカルAIの検討がスタート

ここでは「フィジカルAI」を中心に、「デジタルツイン」「世界基盤モデル」(World Foundation Models)、「VLAモデル」(Vision-Language-Actionモデル)などのキーワードについて解説します。

フィジカルAIはまさに今、始まろうとしている潮流であり、現時点で体系的な解説は難しい状態です。とはいえ、全く根拠のない潮流ではなく、技術的ブレイクスルーは実際に起きています。少し意外かもしれませんが、そのブレイクスルーは動画生成AIでした。動画生成AIで現実(物理)世界のシミュレーションが可能になったのです。

フィジカルAIの一形態である自動運転は、走行中の車両カメラ動画が入力データ(の一部)です。自動運転AIは「ハンドルを右/左に回す」「アクセル/ブレーキを踏む/離す」などのアクションを選択します。この際、どのアクションを取ると事故が起きるかをAIが予測する必要があります。今まではそれが難しかったのですが、動画生成AIに(運転中の動画を入力しながら)「ハンドルを右に回した場合の10秒後までの動画を生成してください」とプロンプトすることで、AIが未来の状況を動画生成してシミュレーションできるようになりました。この物理演算も考慮できる動画生成AIを「デジタルツイン」や「世界基盤モデル」と呼びます。具体的なモデルとしては、NVIDIAの「Cosmos」(注12)やGoogle DeepMindの「Genie 3」(注13)などが挙げられます。

このように機械の操作をリアルタイムで自律実行するAIモデルは、既存のチャットインターフェースに特化したAIモデルとは異なる学習が必要です。このフィジカルAIに特化したモデルを「VLAモデル」(Vision-Language-Actionモデル)と呼びます。このモデルは、視覚と言語、操作を処理することに特化したロボット向けのAIモデルです。カメラ映像と機械への音声指示を入力し、AIは内部思考(Reasoning)で実行すべき操作アクションを検討し、それを実行します。Googleの「Gemini Robotics-ER」や「Gemini Robotics」(注14)などがその例です。

重要キーワードを把握して“楽しく”AI活用

本稿では、2026年に起こり得る生成AIの技術革新ロードマップと、それぞれのキーワードについて解説しました。今回紹介したキーワードを把握しておけば、企業の生成AI推進担当者としては、安心して2026年に挑めるかもしれません。

各社の担当者から「生成AIは進化のスピードが速過ぎて不安になります」という声をよく聞きます。何事も「分からないから面白くない」ものですが、「分かればわりと楽しめる」ものです。本稿が皆さまの2026年の生成AI活用の一助になれば幸いです。

参考文献

(注1)Model Context Protocol(Anthropic)

(注2)Model Context Protocol(公式リポジトリ)]

(注3)Transforming our data culture with AI-ready data(Microsoft)

(注4)Levels in the generative AI maturity model(AWS)

(注5)GraphRAG: New tool for complex data discovery now on GitHub(Microsoft)

(注6)Palantir and NVIDIA Team Up to Accelerate AI Deployment for Enterprises(NVIDIA)

(注7)Palantir Foundry Ontology Overview(Palantir Technologies)

(注8)Vibe Kanban

(注10)Universal Commerce Protocol(UCP)(Google)

(注11)Mamba: Linear-Time Sequence Modeling with Selective State Spaces(arXiv)

(注12)NVIDIA Cosmos Documentation(NVIDIA)

(注13)Genie 3: A new frontier for world models(Google DeepMind)

(注14)Gemini Robotics-ER と Gemini Robotics(Google)

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- はてな、マネフォ、そしてLinuxの脆弱性「Copy Fail」を読み解く “見えている落とし穴”を避けるには

- あなたのパスワードは何分耐えられる? 解析速度上昇で「8文字パスワード」はほぼ無力に

- ChatGPTがシェア4割を切る 急伸するClaude、安定のGemini――生成AI三極化の兆し

- M365 Copilotの定着に万全なサポートは逆効果? 社内利用率95%の企業が実践する5つの鉄則

- 中堅・中小企業に最も人気のAIエージェントは? Google Agentspaceは2位

- 「不可能な賭け」から13年 Googleが独自AIチップ「TPU」を開発し続ける理由

- NTTグループはAIで「GAFAM級」の存在感を発揮できるか?

- 管理ソフトに保存するパスワード数が減少傾向 NordPassの2026年調査

- Microsoft、Copilotのアップデートを発表 ExcelでPlanモードやPython連携が可能に

- 富士通とNECの業績見通しから探る「2026年度国内IT需要の行方」