専用カメラなしで自由視点映像を合成、深層学習で カーネギーメロン大学「Open4D」開発:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

米カーネギーメロン大学の研究チームが開発した「4D Visualization of Dynamic Events from Unconstrained Multi-View Videos」(Open4D)は、複数のカメラで撮影した映像からCNN(Convolutional Neural Network)を用いて後で視点を変えられる3次元動画を合成する手法だ。LightStageなど大がかりな撮影システムを使わずに同様のことができる。

3次元映像の動的再構成を行う手法としては、数十台から数百台のカメラを同期させたLightStageなどのキャプチャースタジオで撮影した画像を合成するのがこれまでの主流だったが、大規模な設備が必要であり、屋内に限定されるという弱点がある。

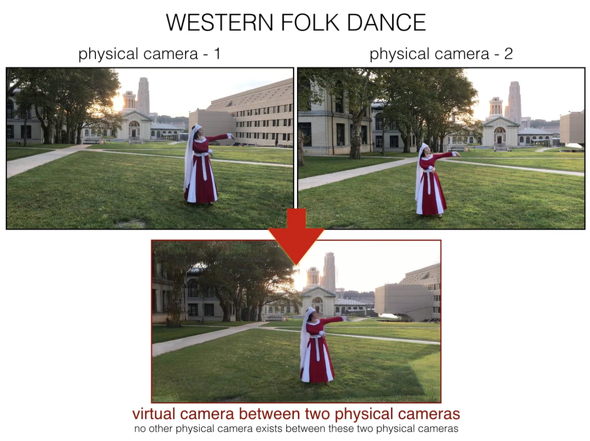

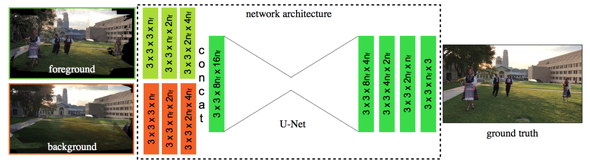

今回の手法では、一般的なカメラで撮影した映像とCNNベースの画像合成で、3次元再構成を行うため、屋外での収録も可能。異なる視点の複数シーンを入力すると、CNNによって前景画像と背景画像を抽出し、バーチャルカメラ視点の画像を合成する。

実験では、最大15台のモバイルカメラを使用して、さまざまな環境下で撮影したマルチビュー映像から3次元動画を生成できた。チラつきや部分欠如などが確認できるものの、おおむね再現できている。

生成された3次元動画は、シーンの視点や時間を編集でき、例えば特定の人物を消去して背後に隠れた部分を見えるようにするなど、さまざまな加工が行える。

関連記事

語学シャドーイングでミスを検知し難易度調整 東大とソニーCSL、自動補助システム「WithYou」開発

語学シャドーイングでミスを検知し難易度調整 東大とソニーCSL、自動補助システム「WithYou」開発

語学学習によく使われるシャドーイング。自分の習熟度に合わせてコントロールしてくれるトレーナーがいれば最強だ。 唇の動きを読み取ってその人らしく音声合成 インド工科大「Lip2Wav」開発

唇の動きを読み取ってその人らしく音声合成 インド工科大「Lip2Wav」開発

音声が不完全もしくはない状態でも、映像さえあればリアルな話し言葉に変換できる。 深層学習で着せ替えも簡単に 画像の一部だけを入れ替え合成する技術「SMIS」

深層学習で着せ替えも簡単に 画像の一部だけを入れ替え合成する技術「SMIS」

着せ替えなども簡単にできる合成システム。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR