ChatGPT(3.5)に匹敵する「Llama 2」をローカルPCで動かしてみた(3/3 ページ)

Llama 2を導入する

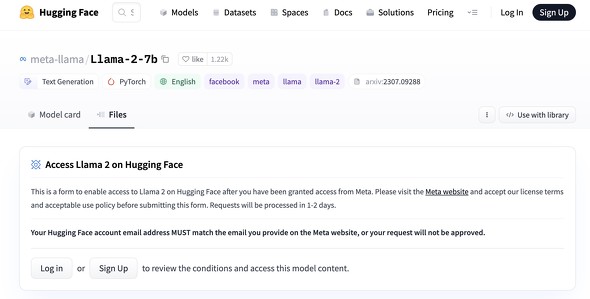

では本丸のLlama2に進みましょう。Llama 2もHugging Faceからダウンロードできますが、ライセンス条項への同意と使用許可ポリシーへの同意が必要です。MetaのWebサイトでの登録のほか、同じメールアドレスでHugging Faceにログインする必要があります。数日以内に確認が終わり、Metaからメールが来たら、モデルがダウンロードできるようになります。

公式Llama 2 についてはText Generation web UIのダウンロードボタンからではうまくダウンロードできなかったので、Hugging Faceから直接ダウンロードして「models」フォルダ内に「Llama2」フォルダを作って格納してみました。しかし残念ながらこの方法ではうまくモデルを認識できないようで、ロードに失敗してしまいます。

そこでLlama 2をベースにしたモデルを導入してみることにします。Llamaは学術利用のみでしたが、Llama 2は商用利用も可能だということで、早くもハッカーたちがカスタマイズを行っており、複数のチューニングされたモデルがHugging Faceにもアップロードされています。

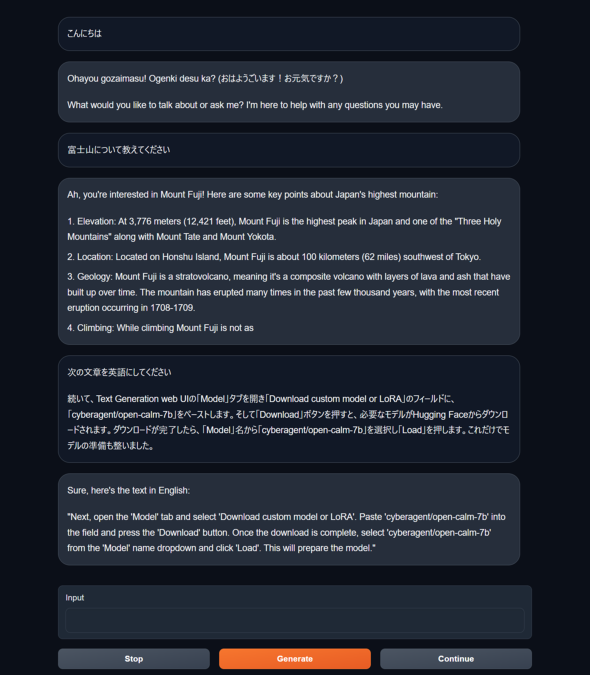

今回はその中でもトム・ジョビンス氏(TheBloke)による「TheBloke/Llama-2-13B-chat-GGML」を選択しました。こちらは認証が不要なので、Text Generation web UIの「Download custom model or LoRA」のフィールドにブランチ名を入力してダウンロードすれば、そのまま利用できます。

Llama-2-13B-chat-GGMLは、サイズは13Bとかなり小さいのですが、それでもちゃんと対話が成り立っています。ところどころに日本語が登場しているのも、なかなかです。

GGML版はGPUを使わずとも推論できるように改変したモデルなので、GPU負荷もほとんどありません。続いて4bit量子化を行いサイズを縮小したLlama-2-13B-chat-GPTQも試してみました。こちらは生成時にGPUを100%使って回答してくれます。VRAMは14.1GBを使用していました。とはいえ、CPUにCore i9を搭載したDAIV FX-A9G90では、CPU処理とGPU処理の速度の違いは感じませんでした。

手元でLLMが動く時代

わずか1年前には、人間と見過うほどの会話を実現するソフトウェアが登場するとは、夢にしか感じませんでした。ところが2022年11月のChatGPTの登場以降、すべてのベースが変わってしまいました。今や、コンピュータが流暢に言葉を操るのは当たり前のことで、試験問題を読んでそれに正しい解答を出すことさえ普通にこなします。

16年、東大合格を目指したAIプロジェクト「東ロボくん」は、「AIが試験問題をまるで解いているように見えるので、AIには知能があると一般人に誤解されていた」といわれましたが、今となっては「そもそも知能とは何なのか」を改めて議論する段階に来ているのかもしれません。

そして今起きているのは、ChatGPT並のLLMが手元のPCで動き始めているという革新です。規模の違いもあり、クオリティではまだだまChatGPTにかないませんが、登場当初のChatGPTに相当するものがローカルPCで動くのには驚愕です。

そして、Stable Diffusionが画像生成AIにおいて、ユーザーに自由をもたらしたのと同じように、Llama 2に代表されるオープンソース系LLMは、チャットAIにおける民主化のきっかけになるのではないでしょうか。

関連記事

無料で商用可、ChatGPT(3.5)に匹敵する生成AI「Llama 2」 Metaが発表、Microsoftと優先連携

無料で商用可、ChatGPT(3.5)に匹敵する生成AI「Llama 2」 Metaが発表、Microsoftと優先連携

米Metaは7月18日(現地時間)、大規模言語モデル「Llama 2」を発表した。利用は無料で商用利用も可能としている。最大サイズの70億パラメーターモデルは「ChatGPT(の3月1日版)と互角」(同社)という。 Stable Diffusionを手元で動かしたい! 画像生成AIを動かすならどんなPCを選んだらいい?

Stable Diffusionを手元で動かしたい! 画像生成AIを動かすならどんなPCを選んだらいい?

どんなPCがあれば、Stable Diffusionのような画像生成AIを動かせるのか? 画像生成用にPCを選ぶなら、何に注意したらいいのか? そんなことを、マウスコンピューターに聞いた。 百花繚乱の大規模言語モデル その現状まとめ【2023年4月末版】

百花繚乱の大規模言語モデル その現状まとめ【2023年4月末版】

米OpenAIが独占的に提供する大規模言語モデル(LLM)に対し、さまざまなLLMが登場している。特に注目はオープンで自由な大規模言語モデル「Dolly-v2」だ。さながら現在は「不自由な大規模言語モデルと自由な大規模言語モデルの小競り合い」が起きている状態だ。 機械に話しかけて設定できる時代が来る? なぜ“小規模”なLLMが求められるのか

機械に話しかけて設定できる時代が来る? なぜ“小規模”なLLMが求められるのか

LLMにおいて、学習パラメータ数は性能に直結する。一方で、注目を集めているのがLLaMaのような小規模なモデルだ。それはなぜか。 MetaとQualcomm、生成AI「Llama 2」をスマートフォンやHMDで実行可能に

MetaとQualcomm、生成AI「Llama 2」をスマートフォンやHMDで実行可能に

Qualcommは、Metaの新生成AI「Llama 2」を、Snapdragon搭載のスマートフォンやVRヘッドセットで実行可能にすると発表した。2024年以降に実現する計画。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR