2030年までに、1兆パラメータを持つLLMの推論コストが90%以上削減される ガートナー予想

この記事は新野淳一氏のブログ「Publickey」に掲載された「マイクロソフト、Claude CodeやGitHub Copilotに「このアプリをデプロイせよ」と指示すればAIが最適なインフラ構成やサービスでデプロイしてくれる「Azure Skills Plugin」公開」(2026年3月25日掲載)を、ITmedia NEWS編集部で一部編集し、転載したものです。

米調査会社のガートナーは、2025年と比較した場合の大規模言語モデルにおける推論実行のコストが、1兆個のパラメータを持つモデルでは2030年までに90%以上削減されるとの予想を発表しました。

この大きなコスト削減効果は、半導体およびインフラにおける処理効率の向上、モデル設計の革新、チップ利用率の向上、推論特化シリコンの利用増加、特定のユースケースに向けたエッジデバイスの応用などの複数の技術改善を組み合わせたことで実現されると、同社のウィル・ソマー氏(シニアディレクター兼アナリスト)は述べています。

この予想は2つのシナリオに分かれています。

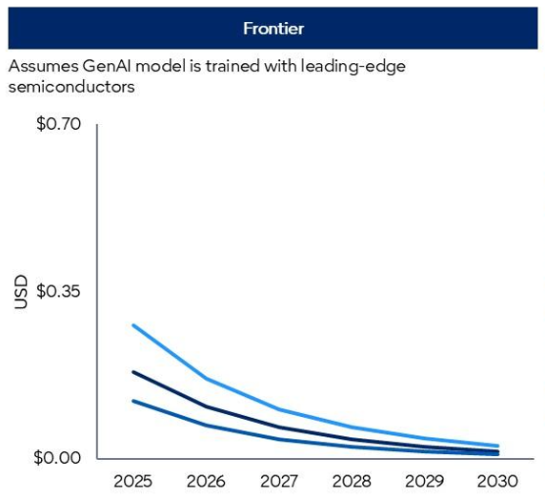

1つは、最先端のチップ技術を前提とした「フロンティアシナリオ」(最前線シナリオ)です。

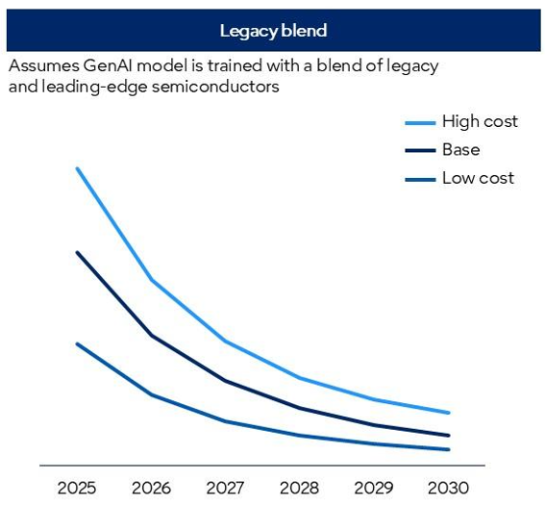

そしてもう1つは、既存の半導体の代表的なベンチマークを基にした「レガシーブレンドシナリオ」です。

いずれのシナリオでも処理コストは大きく削減されると予想されていますが、「レガシーブレンドシナリオ」は処理能力を低く想定しているケースにおいて、その絶対的コストは「フロンティア」シナリオよりもかなり高くなっています。

処理コストの削減がそのまま利用コストに結びつかない

ただし、こうしたLLMの処理コスト削減が、そのまま利用する企業側におけるAIのコスト削減には結びつかないとガートナーは警告しています。

それは一般的な生成AIのチャットbotの利用に比べて5倍から30倍のトークンが処理されるAIエージェントの利用が企業で広まることで、全体としてはより多くのトークンを処理することになり、それがトークンあたりの処理コスト削減の効果を打ち消してしまうからだと説明されています。

今後企業がコスト面で効率的に生成AIを活用するには、日常的で高頻度なタスクについては安価な小規模かつドメイン固有の言語モデルで処理し、高度で複雑な処理のみ高コストが想定される本格的に大規模な言語モデルで処理すべきだとガートナーはアドバイスしています。

関連記事

Claude Codeに「このアプリをデプロイせよ」と指示→AIが最適なインフラ構成やサービスでデプロイする「Azure Skills Plugin」 Microsoftが公開

Claude Codeに「このアプリをデプロイせよ」と指示→AIが最適なインフラ構成やサービスでデプロイする「Azure Skills Plugin」 Microsoftが公開

米Microsoftが、Claude CodeやGitHubCopilotに自律的なインフラ構成とデプロイの能力を与える「Azure Skills Plugin」を公開しています。 Claude CodeにAWSのアーキテクチャ設計、コスト見積もり、構成コード生成、デプロイ実行などの能力を組み込む「Agent Plugins for AWS」公開

Claude CodeにAWSのアーキテクチャ設計、コスト見積もり、構成コード生成、デプロイ実行などの能力を組み込む「Agent Plugins for AWS」公開

米Amazon Web Services(AWS)は、Claude CodeとCursorに対してAWSのデプロイに関するアーキテクチャの設計、コストの見積もり、Infrastructure as Codeのコード生成、そしてデプロイの実行という一連の能力を AzureについてCopilotが何でも教えてくれる「GitHub Copilot for Azure」登場 操作方法からプログラミング、デプロイの方法まで

AzureについてCopilotが何でも教えてくれる「GitHub Copilot for Azure」登場 操作方法からプログラミング、デプロイの方法まで

米Microsoftは日本時間5月22日から開催中のイベント「Microsoft Build 2024」で、生成AIがソフトウェアエンジニアを支援してくれる「GitHub Copilot」の拡張機能として、Microsoft Azureについて生成AIが質問に答える「GitHub Copilot for Azure」を発表しました。 VSCodeのCopilotがAzureの料金から開発まで何でも教えてくれる「GitHub Copilot for Azure」プレビュー公開

VSCodeのCopilotがAzureの料金から開発まで何でも教えてくれる「GitHub Copilot for Azure」プレビュー公開

米MicrosoftはVisual Studio Code(以下VSCode)の拡張機能として、Microsoft Azureに関するさまざまな質問についてGitHub Copilotが答えてくれる「GitHub Copilot for Azure」のプレビュー公開を発表しました。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR