「笑い」や「興奮」も分かるコンピュータ:こばやしゆたか(1/2 ページ)

日本SGIとAGIとの共同開発による「ST(Sensibility Technology = 感性制御技術) Ver 2.0」が発表された。

STについては、この記事やこの記事でも、過去に取り上げた。けんかするコンピュータのあれだ。

もちろん、けんかするのが目的なわけじゃない。コンピュータに人間の「感情」を理解させようというプロジェクトである。開発しているAGIではこのための技術をST、それを使ったユーザーインタフェースをSUIと呼んでいる。

発表会では、まず日本SGI新規事業推進オペレーション統括の大塚寛さんが、その「新規事業推進」というのはなにかということから話をはじめた。要するに、SGIのなかでもいわゆる“コンピュータ”っぽくない事業であり、例えばロボットの「POSY」だったり、レスキューロボットだったり、あるいはゼンリンと組んでの3Dマップだったりするものだ。そしてその中の一つにSTもあるというわけ。

続いて大塚さんは、AGIの光吉俊二社長の「人となり」を紹介する(*1)。

それによれば光吉さんはもともと彫刻家だったのだ(例えば、このページを参照)。その彼が、自分の作品を発表するためにパソコンというものに接した。そしてキーボードとマウスをいじって「なんだこの使いにくいものは」といってしまう。

それでも、ちゃんと使えるようになって、こんどは3Dソフトで粘土細工みたいなことをしようとしたとき、また「なんだこりゃ」になっちゃう。かゆいところに手が届かないようなもどかしさがあったらしい。

そこで、声で制御できるようにならないのかって考える(ここで、マウスじゃない“粘土細工デバイス”を作るってほうには行かなかったのだ)。最初はしゃべった言葉の「単語」を認識するという音声認識を試してみる。でも、これには限界がある。

ここで、いよいよ光吉俊二社長登場。

音声認識をするためには認識のデーターベースである「辞書」が必要だ。でも、その辞書にない言葉は絶対に認識できない。かといって、辞書を大きくすれば、今度はマッチングに膨大な時間がかかるようになる。

光吉さんは、ここで音声認識を見限っちゃった(*2)。もっと違う方法でやろうと考える。

そこで目をつけたのがことばの「リズム」である(ここで言う「リズム」はドラムで刻むようなものだけではなく、イントネーションを含んだ概念のようだ)。

人間が発する言葉は、まず音声であり、そこにはリズムがあり、受け手はそれによって大きな情報を得ている。例えば同じ「ばかやろう」だって、リズムによって、罵声から愛の言葉までいろいろな「感情」を感じられる。リズムによって感情を理解しているからだ。これをコンピュータにやらせようというのがSTだ。

STでの感情認識は、辞書とマッチングを取るようなものではない。膨大な(どこからとってきたのか、どのくらいの量なのかは教えてくれなかった)サンプルをもとに、リズムから感情を検出する関数を探し出したのだ。この関数に音声信号を入れれば、出力として認識された感情が出てくるというわけ。

この方式のメリットは2点ある。

*1 名前は似ているけど、SGIとAGIとは全く関係がない。なんてったってAGIとは「Animation Game Idol」の頭文字なのだ。

*2 地道に音声認識を研究している人には申し訳ないが、光吉さんの場合は、見限っちゃったところから先に進めたわけだ。

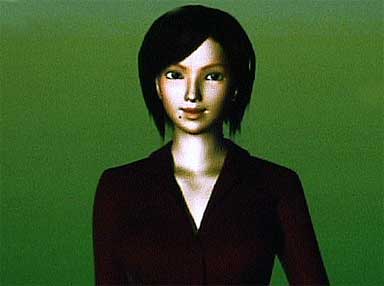

*3 実は、私はこのシステムを見ていて、なんだか腹が立ってきた。受付嬢の発声があまりに平坦だからだと思う。「感情をもってしゃべらせる」というのは、またさらに難しい挑戦だろうが、これにも期待する(とくにゲームの分野で!)

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR

けんかの動画は

けんかの動画は 受付嬢システム。これは、応対が終わって担当者がやってくるまでの時間つなぎをしているところ(

受付嬢システム。これは、応対が終わって担当者がやってくるまでの時間つなぎをしているところ(