「Google翻訳」アプリ、ディープラーニング採用で画像読み取りに20カ国語追加

米Googleは7月29日(現地時間)、モバイル版(AndroidおよびiOS)「Google翻訳」をアップデートし、1月に追加したカメラで読み込んだ画像内のテキストの翻訳機能に対応する言語を20増やして27カ国語対応にしたと発表した。また、音声による同時通訳機能を高速化した。

残念ながら日本語はまだ対応していないが、ブルガリア語、カタロニア語、クロアチア語、チェコ語、デンマーク語、オランダ語、フィリピン語、フィンランド語、ハンガリー語、インドネシア語、リトアニア語、ノルウェー語、ポーランド語、ルーマニア語、スロバキア語、スウェーデン語、トルコ語、ウクライナ語が読み取り/書き出しに対応し、ヒンディー語とタイ語が書き出しにのみ対応した。

Googleによると、この機能は昨年5月に買収した米Quest Visualのディープニューラルネットワーク(DNN)技術に基づくという。DNNは画像や音声の特徴量の機械学習の新たな手法として注目を集めている技術。ノイズの多いデータから有用な特徴量を抽出することができる。

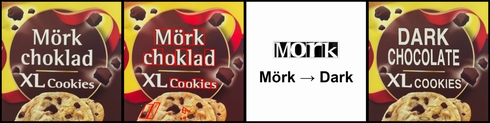

Googleは、Google翻訳アプリが画像から文字を抽出して翻訳する過程をおおまかに説明している。それによると、Google翻訳アプリはまず画像から同じ色のかたまりを文字として抽出し、そのかたまり同士が近くにあれば単語として認識し、辞書データと照らし合わせてそれぞれの単語を翻訳。結果の文字列を画像の対応する位置に置き換える。

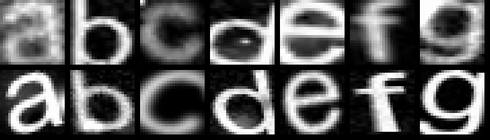

文字を正確に認識できるようにするために、Quest Visualの「畳み込みニューラルネット」技術を使い、文字と文字ではないものとの違いを学習させた。学習用データは、既存の文字画像に人工的な汚れや歪み、傾きなどを追加した画像を使った。

さらに、非常に小さなニューラルネットを開発することで、このプロセスをオフラインで利用できるようにした。ユーザーはコンパクト(最大でも約2Mバイト)な各国語辞書をダウンロードするだけでネットにつながらない環境でもアプリを利用できる。

関連記事

Google、Android/iOS版翻訳アプリの画像と会話の“同時通訳”機能を正式発表

Google、Android/iOS版翻訳アプリの画像と会話の“同時通訳”機能を正式発表

AndroidおよびiOS版のGoogle翻訳に、Microsoftが昨年発表したSkypeの同時通訳機能と同じような音声翻訳機能と、カメラに写した看板のテキストなどをそのまま希望する言語に変換する機能が追加される。 Google翻訳に誰でも参加できる品質向上コミュニティー「Translate Community」

Google翻訳に誰でも参加できる品質向上コミュニティー「Translate Community」

GoogleのTranslate Communityは、ユーザーの言語知識をクラウドソースとして役立てるGoogle翻訳の品質向上を目的とした新コミュニティーだ。 Google、カメラ利用の翻訳アプリ「Word Lens」のメーカーを買収

Google、カメラ利用の翻訳アプリ「Word Lens」のメーカーを買収

Googleが、Android、iOS、Google Glassのビデオカメラで写したテキストを翻訳するアプリ「Word Lens」を手掛けるQuest Visualを買収した。 Google翻訳のAndroid版がオフラインとカメラでの縦書入力に対応

Google翻訳のAndroid版がオフラインとカメラでの縦書入力に対応

Android版Google翻訳で、あらかじめオフライン用辞書をダウンロードしておくと、ネットに接続できなくても翻訳できるようになった。また、カメラ入力で縦書の日本語、中国語、韓国語が翻訳可能になった。 Android版Google翻訳が原文のカメラ入力に対応

Android版Google翻訳が原文のカメラ入力に対応

英語やロシア語、フランス語など一部の言語を、端末のカメラで撮影することで読み込んで翻訳できるようになったほか、英語やスペイン語では国を指定することで“方言”に対処できるようになった。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR