ITmedia NEWS >

STUDIO >

AI研究の「倫理」どうする? 人工知能学会、倫理綱領を策定へ

» 2016年06月08日 11時07分 公開

[ITmedia]

人工知能(AI)は、さまざまな分野で人類に貢献する可能性を秘めている一方、開発者の意図に反して差別的な発言をするなど、人類に害を及ぼす危険性も秘めている。

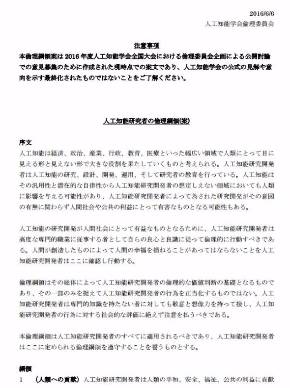

AI研究の倫理はどうあるべきか――人工知能学会はこのほど、AIの研究者・開発者が守るべき倫理綱領の素案を公表(PDF)し、6月6日に開かれた公開討論会で議論した。今後議論を深め、年内にも綱領としてまとめる。

案は、序文で、「人工知能は、その汎用性と自律性から開発者の想定しえない領域でも人類に影響を与える可能性があり、人間社会や公共の利益にとって有害なものとなる可能性もある」とした上で、人工知能の研究・開発者が守るべき綱領を、10項目にわたって示した。

10項目には、人類の平和や安全に貢献し、人類の安全への脅威を排除すること、差別を行わないこと、人工知能の潜在的な危険性について警鐘を鳴らすこと、法規制を順守し、現行の法規制が技術に整合していないと判断する場合は、行為の結果に責任を持つこと、他者の情報や財産に危害を加えず、許可無く他者のシステムやデータにアクセスしないこと、他者のプライバシーを尊重すること――などを盛り込んでいる。

関連記事

Microsoftの人工知能Tay、悪い言葉を覚えて休眠中

Microsoftの人工知能Tay、悪い言葉を覚えて休眠中

Microsoftが会話理解研究のために公開した人工知能botの「Tay」が、Twitterでのデビュー数時間後に停止した。ユーザーに教えこまれた人種差別などの問題のある単語をツイートするようになったためとみられる。 「人類を滅亡させるわ」 人工知能ロボットがインタビューで宣言

「人類を滅亡させるわ」 人工知能ロボットがインタビューで宣言

米企業のAI搭載ロボット・Sophiaが「人類を滅亡させるわ」と発言して注目を集めている。 ついに明かされる「りんな」の“脳内” マイクロソフト、「女子高生AI」の自然言語処理アルゴリズムを公開

ついに明かされる「りんな」の“脳内” マイクロソフト、「女子高生AI」の自然言語処理アルゴリズムを公開

日本マイクロソフトは「de:code 2016」で、“女子高生AI”「りんな」の自然言語処理アルゴリズムについて詳細を語った。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR