ITmedia NEWS >

速報 >

DeepMindのAI、読唇でも人間のプロに勝つ

» 2016年11月25日 14時27分 公開

[佐藤由紀子,ITmedia]

米Google傘下のDeepMindと英オックスフォード大学エンジニアリング科学学部は11月16日、「Lip Reading Sentences in the Wild」と題す論文を公開(リンク先はPDF)した。

人間が何を話しているかを、口の動きだけで読み取る「読唇(lip readinig)」ための、ディープラーニングベースの人工知能(AI)開発に関する論文だ。

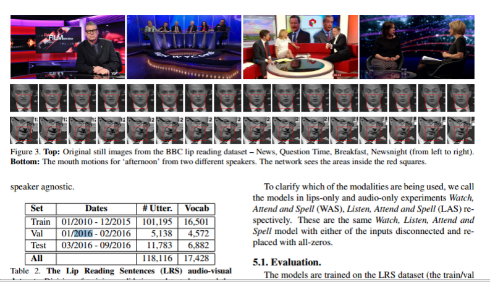

このプロジェクトでは、英国営放送BBCで2010年1月〜2015年12月に放映した5000時間以上の番組をAIに“見せ”ることで訓練した。これらの動画には11万8000以上のセンテンス(文章)が含まれている。

こうして育てた結果、未見のBBC番組でテストしたところ、読唇のプロの人間が12.4%読み取ったところ、AIは46.8%読み取れたという。しかも、ミスのほとんどは、複数形を表す語尾の「s」を抜かすといった小さなミスだったとしている。

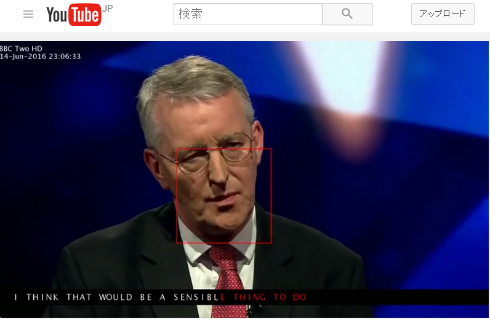

プロジェクトチームのジョーン・ソン・チャン教授が公開した動画(記事末に転載)を見ると、動画に合わせてAIが字幕をほぼリアルタイムで表示している。

プロジェクトチームは、トレーニングリソースとしてBBCのデータセットを公開する計画だ。

関連記事

Google、人工知能DeepMindでデータセンターの大幅省エネに成功

Google、人工知能DeepMindでデータセンターの大幅省エネに成功

Googleが、ニューラルネットワークを手掛ける系列企業DeepMindの技術により、自社データセンターでの冷却電力を40%削減したと発表した。 Google傘下のDeepMind、眼の疾病早期発見AIアルゴリズム開発で英病院と提携

Google傘下のDeepMind、眼の疾病早期発見AIアルゴリズム開発で英病院と提携

Google傘下の人工知能企業DeepMindは、大手眼科病院と協力し、病院の1万人以上の匿名化された眼のスキャンデータを使って眼の疾病を早期発見するための機械学習アルゴリズムを構築する。 Googleのディープラーニング「AlphaGo」がプロ棋士に完勝

Googleのディープラーニング「AlphaGo」がプロ棋士に完勝

コンピュータがついに囲碁で人間のプロに勝利した。Googleのディープラーニングシステム「AlphaGo」がプロ棋士に5戦5勝した。AlphaGoは3月には国際棋戦で10勝以上している李世ドル氏と対戦する。 Google、機械学習システム「TensorFlow」をオープンソースで公開

Google、機械学習システム「TensorFlow」をオープンソースで公開

人工知能に注力するGoogleが、自社開発した機械学習システム「TensorFlow」をApache 2.0ライセンスでオープンソース化した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR