ITmedia NEWS >

STUDIO >

真っ暗な写真に「目では見えない画像」合成、視認性向上 AI活用で

» 2017年06月05日 15時37分 公開

[ITmedia]

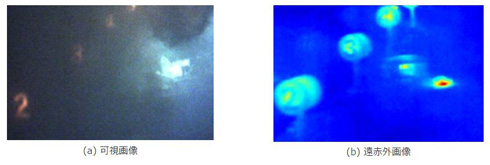

真っ暗な写真や、映りの悪い写真に、同じ角度からサーモカメラなどが撮影した非可視光画像を人工知能(AI)が自動合成して見やすくする――そんな「マルチモーダル画像融合技術」を開発したと、NECと東京工業大学が6月5日に発表した。それぞれの画像単体では捉えにくかった状況も見やすくなるという。

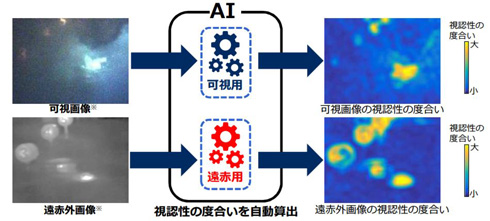

サーモカメラやX線カメラといったカメラの種類、明るさや障害物の有無といった撮影環境に応じ、AIが画像内の部分ごとに「視認性の度合い」を評価。一般的なカメラで撮影した可視光画像を含む複数枚の画像から、視認性が高い部分を抽出し、1枚の写真に合成する仕組みだ。

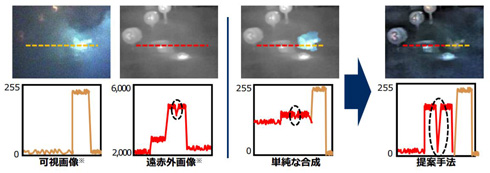

非可視光画像の中から異常や危険物などのわずかな特徴を捉え、白とびや黒潰れなどが生じないように強調度合いを自動調整。視認性の高いマルチモーダル(可視-非可視)融合画像を自動生成するという。

新技術を使えば、夜間や濃霧などの環境下で施設を監視したり、まぶしいヘッドライトを向けられても対向車を認識できる自動運転車を開発したりと、悪条件でも素早く正確な状況判断が可能になるとしている。

関連記事

「すごすぎる」――地方のパン屋が“AIレジ”で超絶進化 足かけ10年、たった20人の開発会社の苦労の物語

「すごすぎる」――地方のパン屋が“AIレジ”で超絶進化 足かけ10年、たった20人の開発会社の苦労の物語

焼きたての手づくりパンをレジに持っていくと、画像認識で瞬時に会計……そんな“AIレジ”が地方のパン屋にじわりと浸透している。その裏側にはシステム開発会社の苦闘の歴史があった。 「研究室が沸き立った」――AIが作詞、アイドル新曲ができるまで 電通大教授に聞く

「研究室が沸き立った」――AIが作詞、アイドル新曲ができるまで 電通大教授に聞く

アイドルグループ「仮面女子」の新曲「電☆アドベンチャー」は、人工知能(AI)が作詞。「にこにこうぱうぱブルーベリー」という不思議な歌詞も飛び出し、出来栄えに「開発した研究室が沸き立った」。制作の裏側を、電気通信大学の坂本教授に聞いた。 人工知能を使ってどんなことができるの? 「東京サマーランド」も導入した監視カメラ画像解析サービスを見てきた

人工知能を使ってどんなことができるの? 「東京サマーランド」も導入した監視カメラ画像解析サービスを見てきた

これまでに勉強した「顔認識API」と「感情認識API」を使って実際にサービスを提供している企業におじゃましてきました。 AIが彩色した映像、NHKが放送 昭和の白黒番組をカラーに

AIが彩色した映像、NHKが放送 昭和の白黒番組をカラーに

1941年に放送した大相撲夏場所の白黒映像をカラー化した作品を、NHKが放送した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR