音声合成はアナウンサーや声優の仕事を奪うのか?:特集・音声言語インタフェース最前線(1/2 ページ)

コンピュータが文章を読み上げる音声合成の進化が著しい。

NHKのニュース番組「ニュースチェック11」では、“AIアナウンサー”の3D CGキャラクター「ニュースのヨミ子」さんが、音声合成でニュースを読み上げている。

ラジオ放送では、エフエム和歌山(和歌山市)が2017年7月から米Amazon.comのテキスト読み上げ機能「Amazon Polly」を使ったAIアナウンサーを活用して話題になった。

特別な訓練を受けたプロフェッショナルによる職業というイメージが強いアナウンサーや声優の仕事を、音声合成で代替できるようになってきた。

NTTテクノクロスで音声合成サービスを開発する鳥居崇マネージャー(メディアイノベーション事業部 第二ビジネスユニット)は、「AIアナウンサーは今後確実に増えていく」と話す。

「地方のローカル局ではアナウンサーが足りていない所もある。働き方改革の取り組みとして、深夜の地震速報などを機械で代替したいという需要はある」(鳥居マネージャー)

同社は、声優の梶裕貴さんの声も再現。梶さんの声を音声合成のデータベースとして構築し、艶のある渋い声の特徴を忠実に再現したとしている。

かつての電話やカーナビゲーションの自動音声ガイダンスはいかにも機械っぽい音声だったが、ここ数年は深層学習(以下、DNN:ディープニューラルネットワーク)の登場で飛躍的な進化を遂げた。

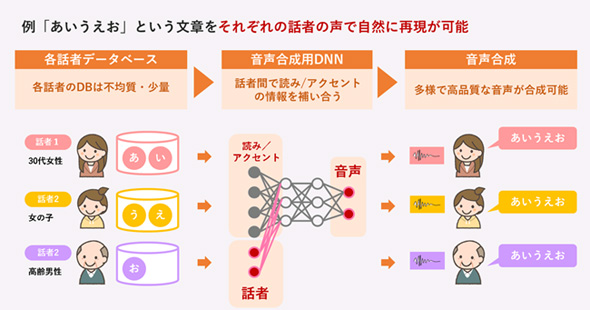

NTTの長年の研究開発により大量に蓄積された音声データベースを活用することで、少量の音声データから人の声と遜色ない肉声感や、明瞭感のある自然な音声を作成できるようになった。

AIアナウンサーや声優の音声合成でもこれらの技術が使われている。では、声を使う職業は機械にそのまま代替されてしまうのか。一部の領域はカバーできるものの、今の音声合成には弱点と課題が残るという。

音声合成の弱点と課題

DNNで著しい進化を遂げた音声合成だが、弱点もある。

音声合成は、(1)テキスト入力→(2)テキスト解析(読み、間の位置と長さ、アクセントを付ける)→(3)韻律生成(読みの長さや高さなどのイントネーションを決める)→(4)波形生成(韻律生成した情報から音声波形を生成する)という流れで音声を作るため、テキストで認識しにくい笑い声や叫び声など感情表現も苦手だ。

「例えば、『ふふっ』という笑い声1つ取っても、いろんな笑い方がありますよね。その場合はパターン1、パターン2など分類する必要がある。日本語は平仮名、片仮名、漢字が混ざるので、英語などと比べてもともと言語解析が難しい」(鳥居マネージャー)

鳥居マネージャーは、「より自然な音声合成にするには、テキストの内容を理解してしゃべることが大事」と話す。悲しいニュースのときに悲しさを意識してニュースを読めるようになれば、アナウンサーの仕事をより広くカバーできるようになるだろう。それには、音声合成だけでなく自然言語処理技術との組み合わせも重要になる。

また、「自然な音声」の客観的な基準がなく、あくまで主観の評価になってしまうのも悩み所だ。ここでいう自然な音声とは、「ある人がしゃべった言葉を音声合成し、スピーカーで聞いたときに違和感を覚えないくらいのもの」で、「それを聞いて心地いいかどうかが重要」という(鳥居マネージャー)

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR

NTTテクノクロスは声優の梶裕貴さんの声を

NTTテクノクロスは声優の梶裕貴さんの声を