「データが足りません、つらい戦いです」――ドコモ、手の動きから食べ物を推定 機械学習に課題も

NTTドコモは、11月17〜18日にドコモR&Dセンタで開催中の「DOCOMO R&D Open House 2016」で、手首に装着したウェアラブルデバイスで食事の内容を推定する技術(開発中)を公開している。

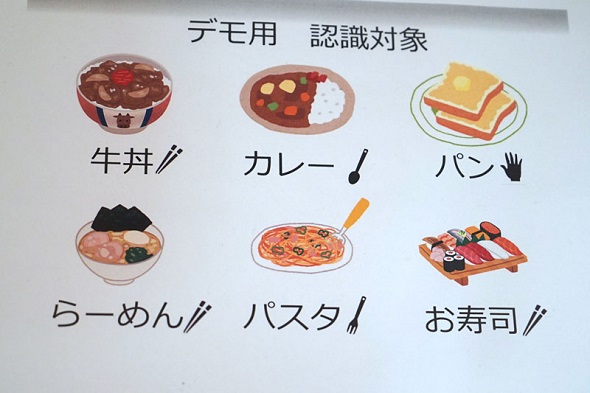

手首に装着したウェアラブルデバイスの加速度センサーなどで「ラーメンをすする」「パスタをフォークで回す」「カレーをすくう」「すしをしょうゆにつける」といった、品目によって異なる「食べる動作」を解析。摂取した食事の種類を推定する。ヘルスケアアプリなどを使った食事管理をしやすくするのが狙いだ。

会場で実際に試してみると、パスタのようなフォークを回転させる特有の動きがあるものは比較的当てられるが、寿司やパンといった、動きの差別化が難しい食べ物の推定はうまくいかなかった。

この技術は、センサーで人間の行動を推定する「行動センシング技術」の一種。手首の動きや、動かした回数、時間といった統計的なデータから、それぞれの特徴を抽出し、膨大なデータの中から近い動作を分類して食事内容を推定する。だが、現時点では精度に関する問題点も多いという。

データがまだ「ビッグデータ」ではない

推定に機械学習を用いた手法を採用しているため、膨大な「食事内容に対応する腕の動作データ」が必要となる。しかし、これに合うデータが世の中に出回っておらず、現在はチームメンバーによるデータで賄っている状態だ。推定できる品目は現時点で10品目弱。精度は3回に1回、正しい結果が表示されればいいほうだという。

さらに、同じ丼ものであっても、それが牛丼か海鮮丼かでカロリーが大きく異なるなど、ヘルスケア用途での課題も多い。会場の担当者は「ユーザーがいるお店を位置情報から特定したり、時間帯に応じてメニューを絞るなど、あらゆる面で精度を上げられないか検討している」と話す。

「食事の内容から、健康アドバイスを行うサービスが一般化してきた。しかし、ユーザーから『何を食べたか』という情報を得るのが難しい」(担当者)

既存のヘルスケアサービスは食事の写真を撮影したり、食事内容を手入力するものが一般的だが、ユーザーが一度入力を忘れてしまうと、その後も続かなくなってしまう傾向があるという。新技術では確実な推定はできなくても、「○○を食べましたか?」といった候補が表示されるだけで、大きく使い勝手が変わる可能性もある。

関連記事

LTEでどこまでも飛ぶドローン、ドコモが実証実験 その実機を見てきた

LTEでどこまでも飛ぶドローン、ドコモが実証実験 その実機を見てきた

携帯電話と同じ、LTEネットワークを使ったドローン制御の実証実験をドコモが行っている。通信キャリアとして重要なのは、地上のLTE網に与える影響だ。 “巻き取れるディスプレイ”に画面がついてくる――ドコモの新技術はすごかった(動画あり)

“巻き取れるディスプレイ”に画面がついてくる――ドコモの新技術はすごかった(動画あり)

折りたたんだり曲げたりできるディスプレイにあわせて、表示レイアウトをスムーズに変更できるコンセプトデバイスをドコモが公開した。 飲めるウェアラブル ウイスキーの米Jim Beamが“Apple Watch”を発表 3時間で完売

飲めるウェアラブル ウイスキーの米Jim Beamが“Apple Watch”を発表 3時間で完売

ウイスキーブランドの米Jim Beamが、どこかで聞いたことのある“Apple Watch”を発売。変形機構を備えたその正体は……ショットグラス!? 「Apple Watch SERIES 2」発表 水深50m防水、50%高速化、GPS搭載

「Apple Watch SERIES 2」発表 水深50m防水、50%高速化、GPS搭載

米Appleがウェアラブルデバイスの新モデル「Apple Watch SERIES 2」を発表した。 「AI利き酒師」に日本酒を選んでもらった お味はいかに?

「AI利き酒師」に日本酒を選んでもらった お味はいかに?

人工知能が好みの日本酒を選んでくれるというサービスが伊勢丹新宿本店でスタート。さっそく味見に行ってきた。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR